Desde hace años, la idea de soberanía tecnológica ocupa un lugar importante en las discusiones sobre gestión de datos, infraestructura y formas de compartir información. Para las organizaciones de la sociedad civil que trabajan en la defensa de los derechos humanos en un entorno digital cada vez más hostil, resulta un asunto de gran relevancia. Tener control sobre sus operaciones tecnológicas se vuelve urgente en un contexto digital atravesado por la vigilancia, la extracción masiva de datos y la concentración del poder en pocas empresas. No se trata solamente de eficiencia organizacional: es, ante todo, una cuestión política a atender.

Autonomía tecnológica como construcción organizacional

Hablar de soberanía tecnológica implica mirar con atención todo el recorrido que hacen los datos, incluso una acción aparentemente simple, como la carga de un archivo local hacia una nube propia, involucra múltiples capas de decisiones técnicas. Por eso, antes de afirmar que se tiene control o agencia sobre información, es necesario preguntarse por los distintos componentes que intervienen este proceso. Entre ellos están las herramientas que se utilizan, la infraestructura donde se alojan los datos (data centers) o las redes de telecomunicaciones que se usan. Analizar estas dimensiones no es un ejercicio teórico, sino una forma concreta de ejercer el poder institucional.

Conocer y saber cómo se guarda la información, quién puede acceder a ella, bajo qué condiciones legales y técnicas, y qué capacidades tiene quien la gestiona, son preguntas fundamentales. Para las organizaciones que trabajan con datos sensibles, por ejemplo información relacionada a víctimas, defensoras de derechos humanos y activistas, este control de la información puede marcar la diferencia entre la protección y el riesgo a la exposición.

En este sentido, adoptar prácticas como el cifrado de extremo a extremo, recomendado constantemente desde Derechos Digitales y promovido por organizaciones como la Electronic Frontier Foundation (EFF) y Access Now, contribuye a reducir riesgos en el acceso y la transferencia de información. Lo mismo ocurre con el uso de redes de anonimización como Tor, desarrollada y mantenida por The Tor Project, que permiten dificultar el rastreo del origen de las comunicaciones.

Si bien el cifrado de extremo a extremo no garantiza comunicaciones completamente seguras, su correcta gestión impide que personas no autorizadas puedan leer archivos o cadenas de datos sin las llaves necesarias. Estas medidas pueden aplicarse en diferentes momentos: desde la creación de los archivos hasta su almacenamiento. Si a esta práctica se le suman redes como Tor -que envían las cadenas de datos cifradas y de diferentes países-, se logra evitar aún más la posibilidad de seguimiento o identificación.

Empresas proveedoras, ética y políticas

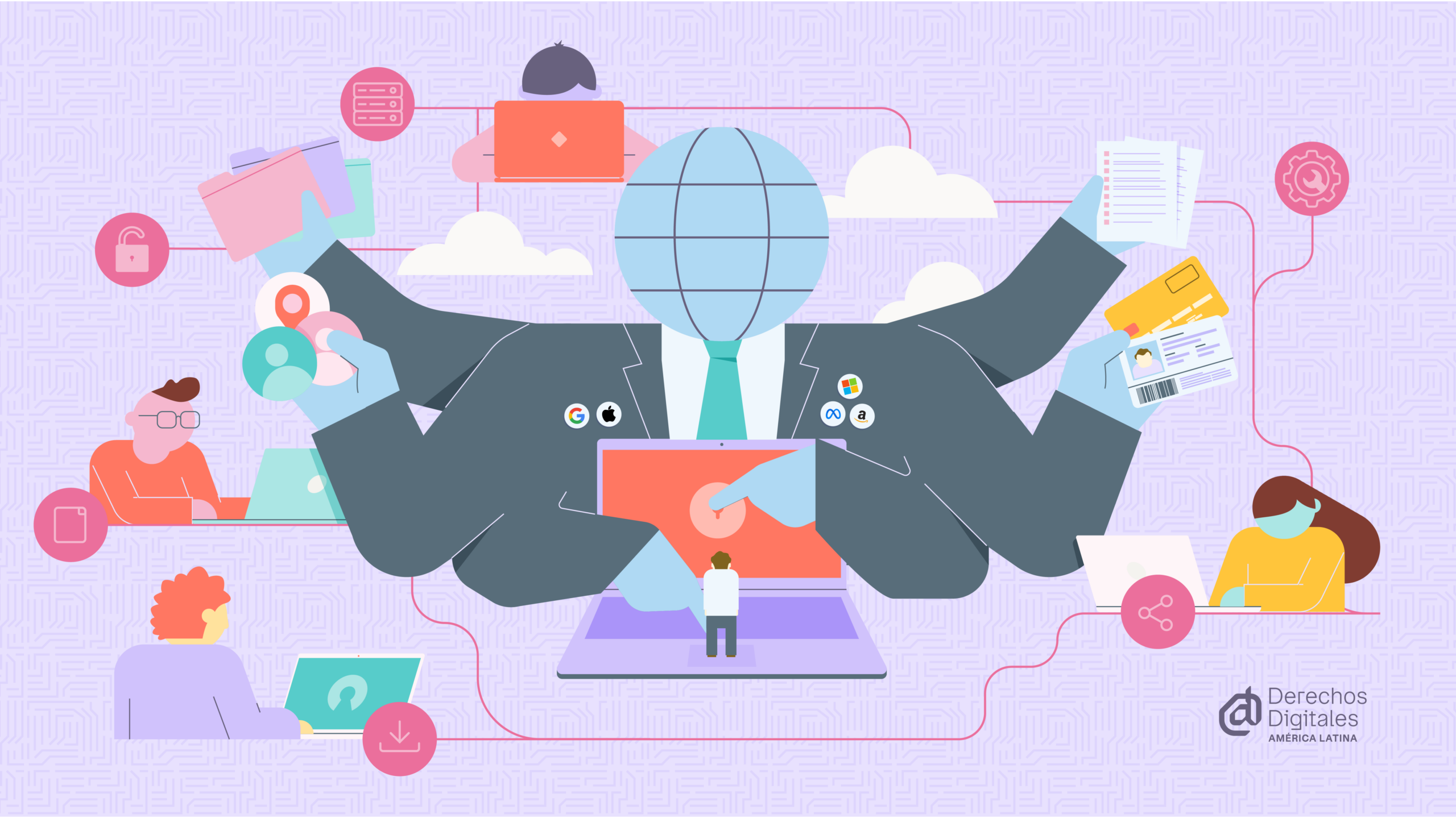

Para responder a la demanda de servicios tecnológicos, las grandes compañías suelen ofrecer soluciones simples, escalables y de rápida implementación. Empresas como Amazon, Google o Microsoft concentran buena parte del mercado global de servicios de correo electrónico, almacenamiento o alojamiento en la nube, gestionando la mayoría del tráfico y de los datos del mundo.

Según el informe de la Cloud Infrastructure Services Providers in Europe (CISPE) y reportes de la industria del mercado global de la nube, esta concentración limita las posibilidades reales de gestionar infraestructuras de forma autónoma y, a su vez, mantiene el desarrollo de aquellos modelos centralizados que no se corresponden a las necesidades o a los valores de las organizaciones de derechos humanos. Sin embargo, este no es el único camino posible. Existen proveedores comerciales alternativos como cooperativas tecnológicas, o empresas con valor ético incluso, los cuales ofrecen servicios de alojamiento con políticas de privacidad más exigentes y compromisos para reducir el impacto sobre el medio ambiente, resguardando principios de sostenibilidad y responsabilidad social.

Pensar la infraestructura desde una perspectiva de derechos también implica considerar su huella ecológica. Algunos proveedores de infraestructuras destacan por su ética y su capacidad de ser sostenibles. Tal es el caso de OVHcloud, por citar uno de los más reconocidos, que ofrece el llamado hosting verde: data centers diseñados para minimizar el consumo de energía, utilizando fuentes renovables y mecanismos de eficiencia que contribuyen a disminuir la huella de carbono que genera el alojamiento web. Otro muy utilizado por su red de distribución de contenidos y su nivel de protección ante ataques es Cloudflare, que también se encuentra entre los servicios hosts eco-friendly con menor huella de energía del mundo.

Además, existen alternativas más especializadas y orientadas a la privacidad y sostenibilidad, como por ejemplo Greenhost y OrangeWebsite. Se caracterizan por sus niveles de compromiso con la protección de datos y el uso de energías renovables: algunos incluso permiten opciones de pago mediante criptomonedas, así como compatibilidad con servicios de redes de anonimato como Tor.

A ellas se suman proveedores de hosting ecológico como GreenGeeks, SiteGround o HostPapa, que utilizan energía renovable junto a -o bien a través de- estrategias de compensación de carbono, combinando rendimiento, sostenibilidad y valores. Este tipo de herramientas, además, permiten a las organizaciones desarrollar infraestructuras que no solamente protegen los datos, sino que, a la vez, van en concordancia con el compromiso de una internet más justa y sostenible.

Dificultades y casos de éxito

Optar por infraestructura propia o autogestionada presenta sus dificultades. La gestión de servidores, nombres de dominio, certificados de seguridad y sistemas de respaldo conlleva una carga de inversión económica y, sobre todo, técnica. Por un lado, es necesario contar con los equipamientos, y por otro, construir alianzas estables que permitan garantizar mantenimiento, actualizaciones y respuesta ante incidentes. Sin embargo, esta inversión permite, en un mismo momento, desplegar un número importante de aplicaciones en un entorno controlado, dividir servicios mediante máquinas virtuales o contenedores, y gestionar pruebas de distintos niveles de usuario mediante un mismo servidor. Son prácticas comunes ya en comunidades de software libre y en experiencias de administración de sistemas que demuestran que la autogestión es posible.

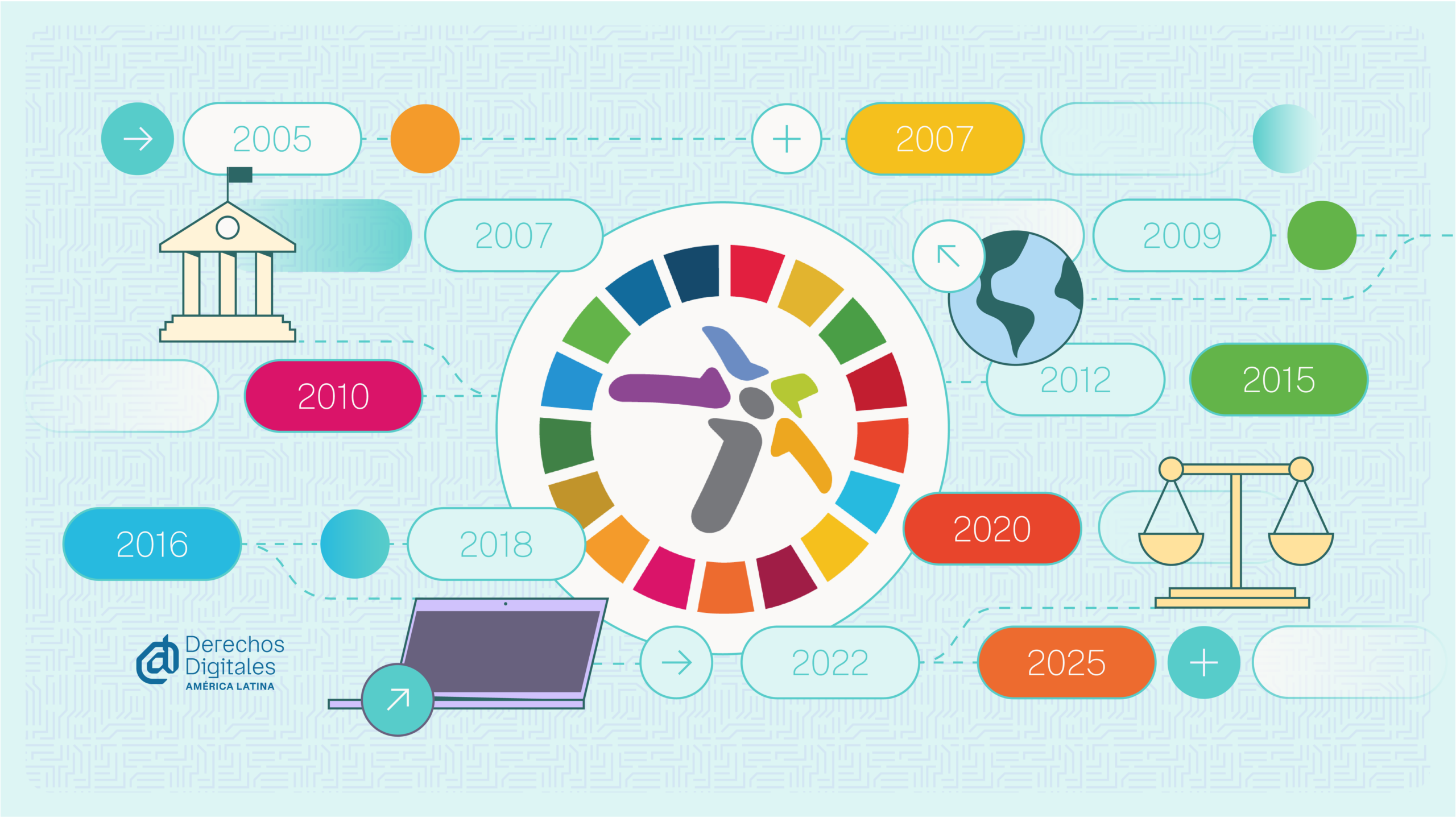

Ante esta situación, algunas organizaciones de la sociedad civil ya vienen explorando estos caminos. Derechos Digitales, por ejemplo, viene impulsando análisis críticos y observatorios sobre el uso de tecnologías en políticas públicas, promoviendo mayor transparencia y trabajando en red con otras organizaciones de la región. Fundación Karisma, por su parte, incentiva la adopción de tecnologías de código abierto y defensivas en redes internacionales, y fomenta capacidades internas para identificar y responder a amenazas digitales.

Otras organizaciones como SocialTIC, combinan la capacitación y el acompañamiento estratégico en tecnologías seguras para agentes de cambio social, amplificando el uso de herramientas libres y métodos de protección digital entre colectivos y organizaciones de México y la región. Por otra parte, las iniciativas que provienen de las comunidades como Nodo50 en Europa, o los trabajos promovidos por la Open Knowledge Foundation fueron clave en el impulso de infraestructuras éticas y abiertas, con un fuerte compromiso en la autodeterminación tecnológica.

Un temor recurrente entre las organizaciones es que contar con infraestructura propia aumente su vulnerabilidad frente a ataques. Sin embargo, la experiencia de agrupaciones de seguridad informática y defensoras de derechos humanos señala que el nivel de vulnerabilidad no depende del lugar donde se aloja la información, sino de la matriz de riesgo de cada organización: su visibilidad pública, el marco político donde actúa, el tipo de información que trata, así como las medidas de protección que tiene adoptadas. Las infraestructuras organizacionales bien construidas, con protocolos claros de cuidado de los datos, actualizaciones constantes de los elementos, políticas de acceso restringido, entre otras características, podrían ser mucho más difíciles de vulnerar que aquellas soluciones externas mal construidas o utilizadas sin los criterios de seguridad necesarios.

Desde este punto de vista, la soberanía tecnológica no es una solución única ni un ideal abstracto. Es un proceso gradual, situado y profundamente político. Significa reconocer los límites, evaluar capacidades reales y tomar decisiones poniendo en el centro a las personas y a la información que sostienen las luchas por los derechos humanos en línea. En un ecosistema digital sumamente desigual, avanzar hacia mayores niveles de control y autonomía tecnológica es también una forma de coherencia institucional y de defensa activa de los derechos que se buscan proteger.