El Salvador es uno de los pocos países en la región que aún no cuenta con una legislación específica para la protección de los Datos Personales. A pesar de contar con algunas reglas dispersas, como un breve capítulo en la Ley de Acceso a la Información Pública (LAIP) y algunas normas en leyes sectoriales (Ley de Regulación de los Servicios de Información sobre el Historial de Créditos de las Personas, Ley de la Firma Electrónica, Ley de Partidos Políticos, por mencionar algunas), todavía no existe una ley general en la materia. El propio derecho de acceso a la información personal (Habeas Data) en el país constituye un destacado desarrollo de la jurisprudencia, formulado por la Sala de lo Constitucional de la Corte Suprema de Justicia.

Así las cosas, la necesidad de tener una legislación especializada y coherente con los estándares internacionales de derechos humanos, que abarque el ámbito público y privado, es primordial. No solamente por la necesidad de actualización frente al procesamiento manual de datos del pasado, sino por el crecimiento de la capacidad de procesamiento automatizado que atraviesa cada aspecto de la vida social, en el presente y el futuro, a nivel nacional y global. A pesar de la escasa protección en el ámbito preventivo, asistimos al uso cada vez más frecuente de herramientas tecnológicas, tanto en lo público como en lo privado, sobre las cuales pocas veces se reflexiona y sobre las que la ley tiene alcance limitado para proteger los derechos de las personas.

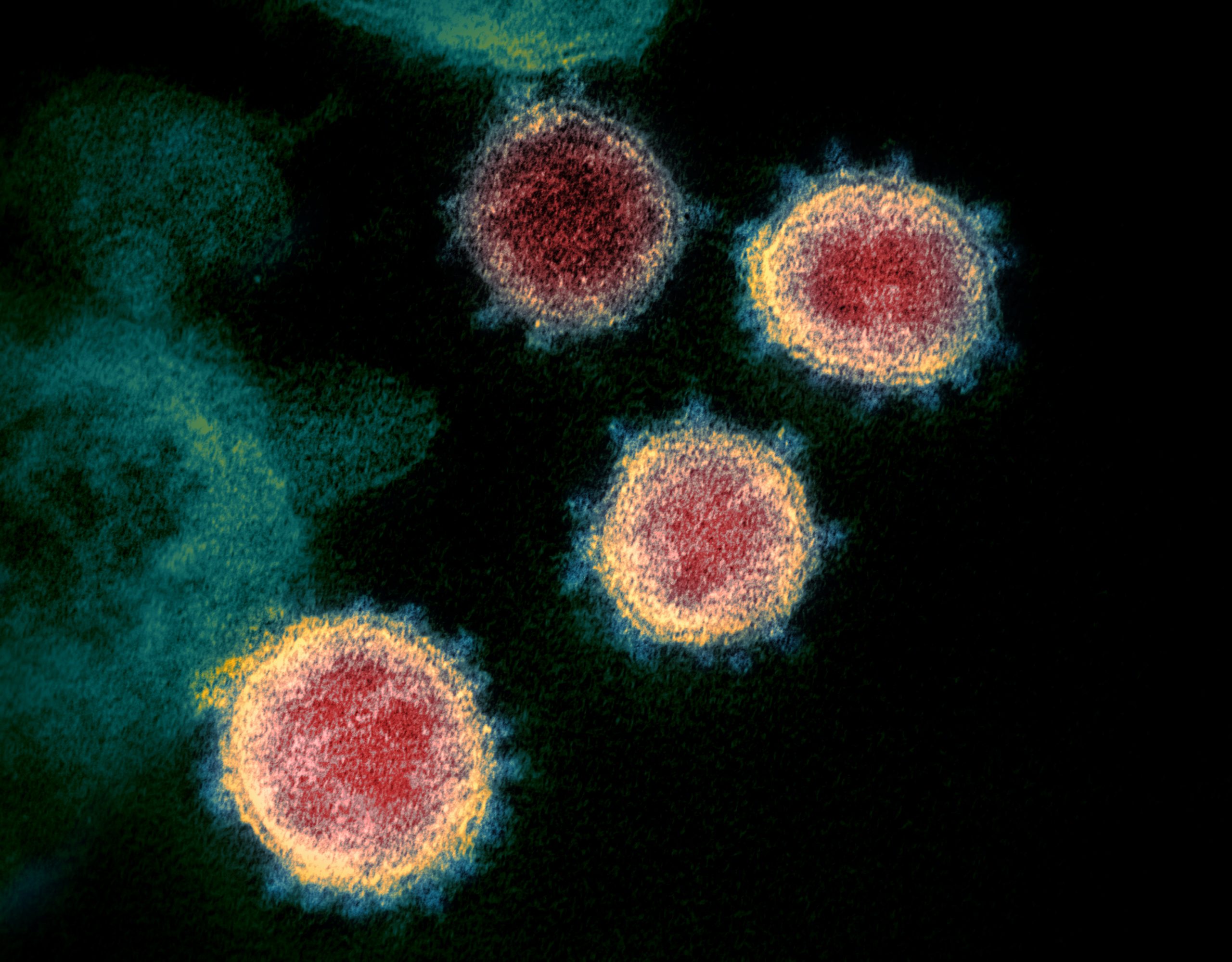

La ausencia de reglas expresas que permitan la protección de la información personal, tiene ejemplos concretos de riesgos, tanto de parte del Estado como de privados. Desde el año 2017 la Alcaldía del municipio de Santa Tecla ha desplegado cámaras con reconocimiento facial; en la misma línea, el gobierno central solicitó un préstamo para financiar su estrategia de combate a la delincuencia, en el que se incluía la compra de cámaras con tecnología de reconocimiento facial, la compra de drones para la Policía y para el Ejército, y la instalación de centros de monitoreo para ambas instituciones. La empresa privada no se queda atrás: en algunos centros comerciales, a raíz de la pandemia, se instalaron cámaras térmicas para medir la temperatura de los visitantes, sin que se sepa a ciencia cierta si están dotadas con tecnología para el reconocimiento facial o si se almacenan las imágenes captadas; todo sobre lo cual no se informa a los usuarios al ingresar.

En este contexto de uso de tecnologías susceptibles de almacenar datos personales como las descritas, se anunció la discusión en la Asamblea Legislativa de un proyecto de Ley de Protección de Datos Personales, lo que constituye en principio una excelente noticia. La propuesta se encuentra en discusión previa aprobación del articulado dentro de la Comisión de Economía donde, una vez obtenido dictamen favorable, el proyecto pasará a discusión en el Pleno Legislativo.

Si bien es cierto que tanto la información oficial como la de prensa dan cuenta de la participación de algunas instituciones de la sociedad civil en el proceso consultivo de las distintas propuestas de anteproyecto, no se tuvo una publicidad adecuada para que cualquier ciudadano pudiera expresar su opinión sobre la normativa y se produjera un debate más amplio en la sociedad acerca de aspectos que necesitan ser incorporados en esta regulación. Además, mucha de la discusión se dio en el marco de la emergencia por COVID-19, lo que distrajo naturalmente la atención de la ciudadanía. Sin embargo, por ser un tema de mucha importancia para el país, la discusión merece al menos una atención amplia, por lo determinante que resulta para el ejercicio de los derechos fundamentales de las y los salvadoreños. A continuación presentamos nuestra breves consideraciones geenerales sobre el Anteproyecto de Ley unificado, para contribuir a este debate, en la mira de involucrar a la ciudadanía con su atención a esta discusión.

Antecedentes sobre la protección de datos personales en El Salvador

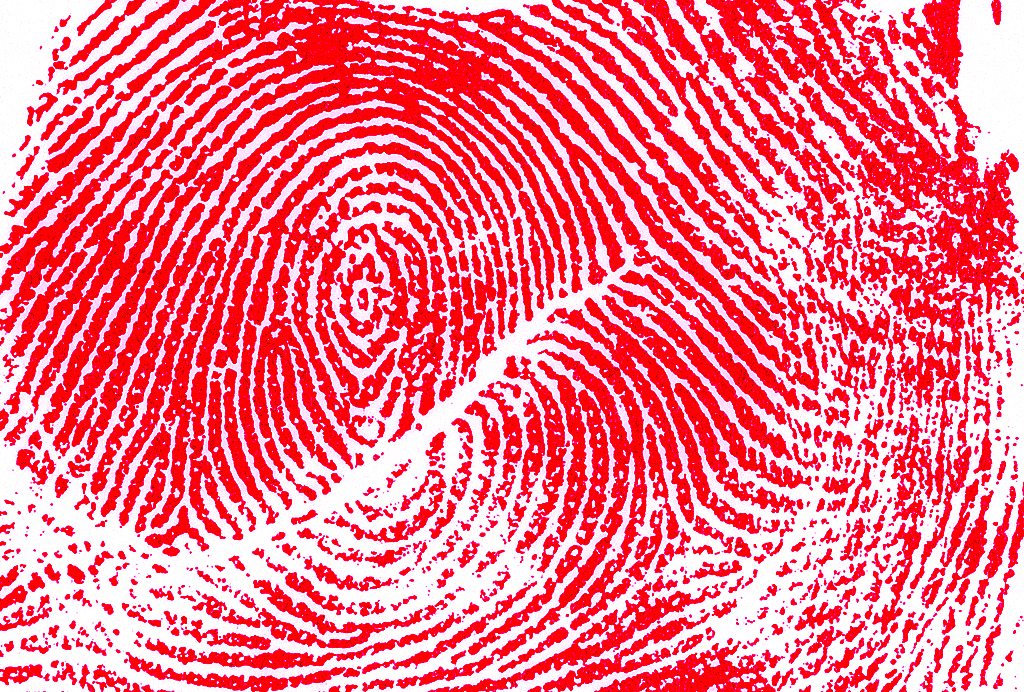

La protección de datos personales en El Salvador tiene su mejor expresión no en la ley, sino en la jurisprudencia. Desde la sentencia de Amparo 934-2007, la Sala de lo Constitucional sostuvo que “… el derecho a la autodeterminación informativa tiene por objeto preservar la información de las personas que se encuentra contenida en registros públicos o privados frente a su utilización arbitraria —especialmente la almacenada a través de medios informáticos—, sin que necesariamente se deba tratar de datos íntimos”.

En la sentencia de Amparo 142-2012, la Sala desarrolló el contenido del derecho a la autodeterminación; señaló que la faceta material de este derecho permite a las personas definir la intensidad con que desea que se conozcan y circulen tanto su identidad como otras circunstancias y datos personales; combatir las inexactitudes o falsedades que las alteren; y defenderse de cualquier utilización abusiva, arbitraria, desleal o ilegal que pretenda hacerse de esos datos; que, para conseguir estos fines, se cuenta con la técnica de protección de datos, que se encuentra integrada por un conjunto de derechos subjetivos, deberes, principios, procedimientos, instituciones y reglas objetivas. En esta sentencia se desarrollan los derechos de los usuarios, así como los principios de la protección de datos personales y algunas reglas para este fin.

Estas sentencias fueron el antecedente para la protección de datos personales. Algunas de estas consideraciones fueron incorporadas en la Ley de Acceso a la Información Pública (art. 31 a 39) y en los Lineamientos Generales para la Protección de Datos Personales en los Entes Obligados, emitidos por el Instituto de Acceso a la Información Pública (IAIP). Se trata de un reconocimiento todavía limitado, que el nuevo anteproyecto vendría a complementar.

El anteproyecto de ley de datos personales

La propuesta de Ley declara su objetivo en su artículo 1: la protección de los datos personales de las personas naturales “… para garantizar el derecho a la intimidad y el derecho a la autodeterminación informativa de las personas naturales”. Resulta muy positivo que se considere el derecho a la autodeterminación informativa como un derecho autónomo del derecho a la intimidad. Sin embargo, aunque en su articulado hay una lógica de interconectar la autodeterminación informativa con otros derechos como la libertad de expresión y el acceso a la información, hubiera sido provechoso dejar en claro esta relación en los considerandos o de manera más explícita en las disposiciones normativas.

El anteproyecto apunta a la regulación del tratamiento de datos personales en general. Sin embargo, al fijar su propio ámbito de aplicación, la propuesta contempla excepciones con algunos elementos que levantan alertas. Por ejemplo, se excluye de la aplicación de la ley a los datos del historial crediticio, hoy regulados en una normativa específica, impidiendo así parámetros comunes para la protección de datos. Por otro lado, excluye la recolección para fines familiares, referidos a los que carezcan de “utilización comercial”, dejando amplio margen de interpretación para excluir de la aplicación de la ley. Finalmente, se excluye el uso de datos con fines de “seguridad pública” o “seguridad del Estado”, sin suficiente precisión sobre el alcance de tales conceptos que permita prevenir las injerencias estatales arbitrarias en la esfera de la autodeterminación informativa, sobre todo mediante tecnologías de vigilancia. Se trata de exclusiones amplias, que restan protección a la información personal en una vasta cantidad de posibles usos por empresas y por el Estado.

Las definiciones del anteproyecto también muestran falta de claridad o precisión. Por ejemplo, el proyecto señala que, por el principio de legalidad, los datos “…deben ser procesados de manera legal”, una expresión circular que no conduce a nada. Por el contrario, la definición debería considerar que, por este principio, la información debe ser procesada en una base jurídica clara, con un propósito claro, y de una manera justa y transparente. Por otra parte, la redacción del principio de privacidad es confusa, mientras que la referida al principio de licitud está poco desarrollada. Y hay aun más ejemplos que demuestran la necesidad de un debate más robusto que auxilie a la redacción de la ley.

También merece atención la protección a una de las categorías especiales de información: los datos personales de niños, niñas y adolescentes. No basta con mencionar únicamente el interés superior de las personas menores de 18 años o las leyes y tratados internacionales pertinentes para considerar que se está prestando la atención requerida a esta categoría de datos. El tratamiento de estos datos debe ser lo más restrictivo posible y no puede permitirse su tratamiento libre, aunque estos sean de naturaleza pública. Esta carencia debe ser subsanada por la ley.

La propuesta de normativa desarrolla los derechos de las personas sobre los datos de los que son titulares, consagrando así los denominados derechos ARCO (acceso, rectificación, cancelación y oposición), siguiendo la tradición y la práctica de muchos países en la materia (Art. 6). Sin embargo, tanto la definición de estos derechos como su operatividad resultan problemáticos. Por un lado, el legislador está equiparando el derecho de cancelación o eliminación de datos con el “olvido”, y al derecho de oposición lo denomina derechamente “derecho al olvido”. Podría pensarse que es una confusión o que se trata de meros sinónimos, pero al momento de señalar las excepciones al derecho de supresión (art. 10), se incluye la hipótesis de que los datos sean necesarios para ejercer la libertad de expresión y prensa, algo que no podría ser congruente si se estuviera legislando sobre el derecho al olvido.

Por otra parte, las excepciones a los derechos ARCO (Art. 18) contienen disposiciones de interpretación muy amplia. Por ejemplo, puede negarse el ejercicio de los derechos en caso de lesiones a los derechos de un tercero, sin más desarrollo que permita saber cómo se acredita esa lesión o por quién; se menciona también la resolución de una “autoridad competente” sin especificar de qué autoridad se trata; finalmente, autoriza la denegación de los derechos de manera genérica en “los demás casos establecidos en la presente ley u otras leyes aplicables”, sin exigir el cumplimiento de estándares de legalidad, necesidad y proporcionalidad en la afectación del ejercicio de derechos fundamentales.

El artículo 56 autoriza el tratamiento de datos para la elaboración de perfiles con fines promocionales, comerciales o publicitarios. Aunque se señala que estos datos deben haber sido obtenidos con el consentimiento de los usuarios, más parece una “solución” para aquellos casos en los que las empresas recolectan datos sin que los usuarios lo sepan, que una obligación para cumplir con este requisito de consentimiento informado. Por otro lado, no se hacen exigencias adicionales para el consentimiento expreso para transferir a terceros los datos que ha recopilado de esta forma y para estos fines.

La necesidad de una autoridad de control

Como es habitual en las discusiones modernas sobre protección de datos personales, se intenta regular teniendo en mente la existencia de una autoridad de control de datos personales, es decir, un órgano estatal encargado de la fiscalización y la observancia de la ley. Esta discusión no está del todo zanjada en el proyecto de ley de datos personales, y es un debate legislativo complejo y con distintas posiciones dentro del país.

En las discusiones sobre la autoridad que debería encargarse de la protección de los datos personales, se han barajado al menos tres opciones: 1. Que asuma ese rol el Instituto de Acceso a la Información Pública, el ente que actualmente tiene bajo su competencia velar por el acceso a la información pública y la protección de los datos personales en el Estado; 2. Que la Dirección de Protección al Consumidor (DPC) tenga esa competencia; y, 3. Que se dé origen a un nuevo ente público. Los argumentos a favor de cada una de ellas varían entre la disponibilidad inmediata de personal capacitado en el IAIP, la visión más comercial de incluir a la DPC y la ventaja de formar desde cero un nuevo ente, autónomo, independiente, con capacidad técnica y con presupuesto propio. A esas opciones se suma una cuarta alternativa: la competencia en esta materia podría recaer sobre una Autoridad Nacional Digital, regulada por una ley especial bajo el mismo nombre, que, además, tendría atribuciones sobre el acceso universal a internet, el comercio electrónico, la economía del conocimiento, la firma electrónica y la ciberseguridad.

Consideramos que la multiplicidad de funciones puede generar controversias innecesarias cuando se trate, por ejemplo, de la protección de datos personales frente a injerencias de empresas que puedan ver esta protección como una limitante para el desarrollo de sus negocios en el ámbito del comercio electrónico. A la vez, la multiplicidad de funciones puede ser contraria a la especialidad técnica que la protección de datos personales requiere, en particular frente a los desafíos de la tecnología y a la creciente complejidad de los modelos de explotación de la información personal. La autoridad que proteja los datos personales debe estar disponible de manera especial para ese fin, con suficiente autonomía para garantizar una real independencia para aplicar la ley y velar por los intereses y derechos de los titulares de los datos personales, tanto a entes públicos como privados que colectan datos personales, con facultades fiscalizadoras y sancionatorias que hagan efectiva la protección.

Por cierto, no se trata de problemas insalvables. Pero creemos que partes relevantes de la capacidad operativa de la propia ley y el establecimiento de sus mecanismos de observancia no deberían ser dejados a una discusión posterior sobre la autoridad de control. Esta es la oportunidad de fijar no solamente los parámetros sustantivos para la protección de la autodeterminación informativa, sino también el marco para permitir su cumplimiento, tanto a petición de los titulares como por la intervención proactiva de una autoridad fuerte.

Próximos pasos hacia una ley de datos personales

Como Derechos Digitales, hemos acompañado varios procesos en la región para la discusión y desarrollo de normativa de protección de datos personales y nos ponemos a disposición de la discusión en El Salvador para poder aportar desde esa experiencia Latinoamericana. Sabemos que no es tarea fácil para los países que se ponen de cara a ese desafío, pero hemos visto cómo la participación de grupos amplios de sociedad civil con conocimiento técnico en la materia puede ser un aporte para perfeccionar la técnica legislativa, en una forma consciente de los desafíos y oportunidades de cada realidad nacional. Con los puntos aquí presentados buscamos llamar la atención sobre la necesidad de discutir en profundidad un tema que es de vital importancia para las y los salvadoreños: La recolección de datos se da en muchísimos ámbitos de nuestras vidas, desde acceder a un sitio web, caminar en una calle con cámaras de vigilancia, comprar en línea, usar aplicaciones bancarias, ingresar a centros comerciales, residenciales o sitios de entretenimiento. La tecnología avanza en la sociedad, y los derechos no pueden quedarse atrás. Esperamos que los legisladores salvadoreños asuman hoy la responsabilidad de modernizar la legislación de un modo sensible a las necesidades de protección de la ciudadanía sin pausa, pero sin prisa para un buen resultado de protección.