Internet ha implicado un cambio civilizatorio radical, que, si bien trae nuevos problemas, no omite aquellos prexistentes vinculados con la violencia basada en género y la desigualdad histórica entre varones y mujeres: discriminación, acoso, violencia, brechas de acceso. Pero también la web juega un papel central en esta oleada feminista que vivimos. La posibilidad de acceder a discursos sobre género y feminismos, descargar libros, hacer búsquedas ante cualquier interrogante sobre nuestros cuerpos, acceso a cursos, debates, videos, indignarnos con la educación sexual recibida en la adolescencia.

No solo hablamos del vital y decisivo acceso a la información. Nos referimos a todas las articulaciones que tienen los entornos virtuales como base y génesis de las articulaciones que conforma esa “vida real”. Hoy los grupos feministas en distintas plataformas se encuentran más activos que nunca. Se intercambian recorridos, se fijan puntos de encuentro, se comparten estrategias de autocuidado para marchar seguras.

Esta oleada feminista internacional, con un foco poderoso en América Latina, es incomprensible sin internet. Muchas integrantes de colectivas se conocieron a través de Twitter. Las “mercadas” feministas, los truques y redes solidarias colaboran en la sustentabilidad de la vida. Las redes de cuidado feministas, como las socorristas en red, acompañan a mujeres y personas gestantes en caso de decidir interrumpir un embarazo. Otras, colaboran en los casos de violencia y acoso digital. Muchas otras buscan a mujeres que se encuentran desaparecidas sin preocupación ni ocupación por parte de los Estados. También están las que, ante un caso de violencia doméstica, colaboran en juntar recursos para que quienes valientemente escapan de estas situaciones y encuentren un refugio seguro.

Las activistas por la cultura libre generan repositorios para que la forma de narrar nuestra realidad se encuentre disponible en forma libre. Están quienes pasaron días georreferenciando movilizaciones. Los medios de comunicación feministas en internet nos han mostrado las movilizaciones en nuestro continente, donde comprobamos año a año que somos un océano que desborda ciudades, desde las metrópolis hasta los pequeños pueblos. Comunicarse para avisar que llegamos sanas y salvas es un código de época.

Los miles de activismos y sus expresiones destacan el lado más virtuoso de esta jornada. Sin embargo, en los espacios laborales de tecnologías necesitamos seguir visibilizando las dificultades cotidianas. Los techos de cristal con sus respectivos suelos pegajosos, y los síndromes de la impostora siguen siendo repertorios eficaces para garantizar que los puestos gerenciales y de liderazgo sean excepcionales entre mujeres.

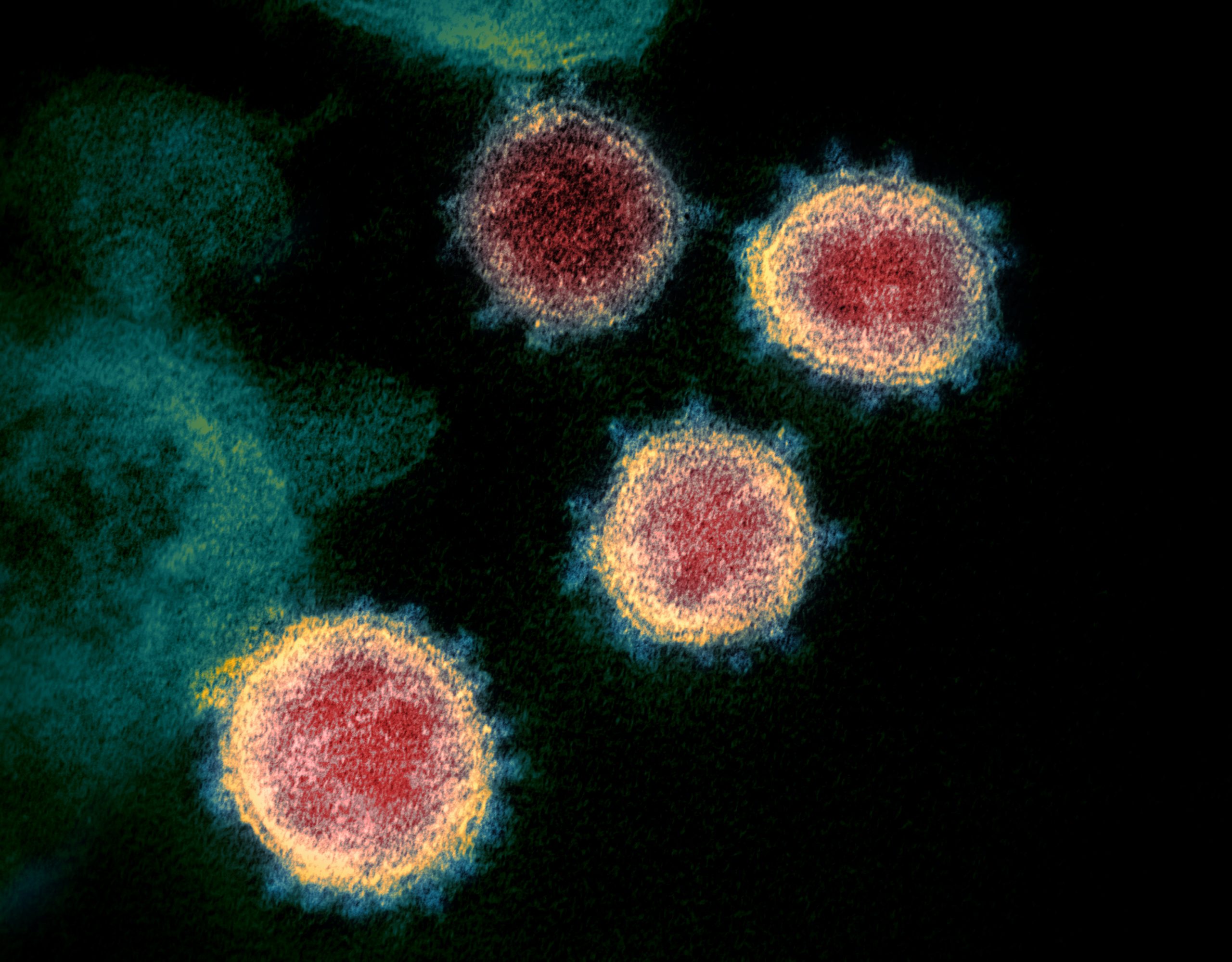

Persiste también una fuerte y sexista división del trabajo donde las tareas visibles y “relevantes” son realizadas por varones. La invisibilización y desvalorización de las tareas de cuidado de las personas dependientes y de las tareas domésticas perpetúan una desigualad cruel, que no reconoce su centralidad para la reproducción de la vida. Para la mitad de las mujeres latinoamericanas los cuidados son el motivo principal por el que no buscan trabajo, lo que afecta su autonomía económica e inserción laboral. Todas las vulnerabilidades se recrudecieron en pandemia: estudios del PNUD afirman que nuestra región ha retrocedido una década en el mercado laboral. Si no se interviene en forma activa, por más buenas que sean las intenciones, los resultados siempre estarán sesgados en la medida que no se contemplen las necesidades de —nada más y nada menos— la mitad de la población.

La provocación para este día es preguntarnos qué esfuerzos estamos realizando los sectores de la tecnología, en particular quienes la abordamos desde un punto de vista de derechos humanos. No hay organización social, política y cultural que no se encuentre lidiando, de alguna manera, con esta pregunta. Cierto es que se asume el desafío con mayores o menores grados, tanto de iniciativa como de convicción. Es un camino con muchos obstáculos pero que vale la pena recorrer.

Es cierto que es desgastante escucharlo una y otra vez, pero todas comprenderán que más desgastante es vivirlo. Incorporar una perspectiva de género que reconozca y comprenda las desigualdades estructurales de nuestras sociedades es un compromiso diario que, para que sea sincero, requiere iniciativa, creatividad y autorreflexión.