Libertades de expresión y prensa, garantizadas por el artículo 19 de la Declaración Universal de los Derechos Humanos y, sin embargo, tan frágiles en todo el orbe. Cuidar de que estos derechos puedan ejercerse es una tarea colectiva. Más todavía en el escenario en que nos encontramos, donde la expresión y la prensa no habitan los soportes tradicionales, sino que se trasladaron al campo virtual. Campo poco regulado y en que las grandes compañías tecnológicas lideran lo que fluye al interior y desde sus plataformas.

Esta edición de la Conferencia del Día Mundial de la Libertad de Prensa se enfocó en cómo enfrentar la crisis climática a la luz de fenómenos recientes y acelerados relacionados con los desórdenes informativos. Además, se dedicó tiempo a profundizar en cómo dichos desórdenes están proliferando en internet. La visión tradicional de “la prensa” como grandes conglomerados dedicados exclusivamente a producir y difundir información bajo estrictos (en el mejor de los casos) criterios periodísticos, ha quedó obsoleta ante el auge de las plataformas que ofrecen un soporte similar, pero sin ningún tipo de control.

Como señala esta columna de Patricia Peña, “la relación de los medios periodísticos digitales se vuelve incómoda con las plataformas digitales, tanto las de los motores de búsqueda como las de redes sociales (…) porque actualmente son su principal competidor” en cuanto a las ganancias recibidas por avisaje. Esta tensión no se resolverá sola, y probablemente tampoco por vías judiciales, camino por el que han optado algunas empresas editoriales.

Apostamos por la incorporación de todas las partes interesadas en estos debates, en los que necesariamente debemos hilar muy fino. La responsabilidad de las empresas, las garantías que los Estados y gobiernos deben ofrecer, los términos y condiciones bajo los que las personas usuarias operan en los entornos digitales, y mucho más, requieren la colaboración de voluntades en una relación mutuamente beneficiosa. Es decir, donde conviven diferentes entidades como una compañía y una organización de la sociedad civil que en un principio pueden parecer poco similares, pero que trabajan en conjunto para beneficiarse las unas a las otras, en lugar del parasitismo al que, lamentablemente estamos acostumbradas.

Lo importante es participar y hacer amigas

Uno de los grandes y constantes desafíos que hemos encontrado a lo largo de los casi veinte años de historia de la organización es la comunicación de procesos cerrados de discusión sobre materias regulatorias de internet que se ejecutan, a veces, en secreto; que reúnen a autoridades de alto nivel tanto de gobiernos como de empresas, y que suceden en los idiomas del poder y los negocios (inglés y francés, por lo general), a un público latinoamericano y con acceso restringido a estas instancias.

Muestra de ello es lo difícil que se nos hace traducir la palabra multistakeholder, puesto que las definiciones sobre qué es una “parte interesada” seguramente son distintas dependiendo del país en América Latina y ciertamente difiere mucho la idea que tiene el Norte Global de ella respecto de cómo la concebimos en el Sur. Esto no impidió que el multistakeholderism o la preocupación por la incorporación de todas las partes interesadas en los debates sobre libertad de expresión y regulación de plataformas fuera protagonista durante el WPFD.

Nuestra realidad digital contemporánea está compuesta por múltiples actores: gobiernos; empresas; sociedad civil; la comunidad técnica, y la academia. Todos ellos tienen un puesto asegurado en las mesas donde se decide, a niveles globales, cómo hacer de esta realidad un ecosistema en que la relación entre dichas partes sea positiva para todas. No obstante, lo que hay también pone a prueba los límites de este esquema de gobernanza, puesto que los retos a los que nos enfrentamos solo aumentan.

La información no tiene dueño

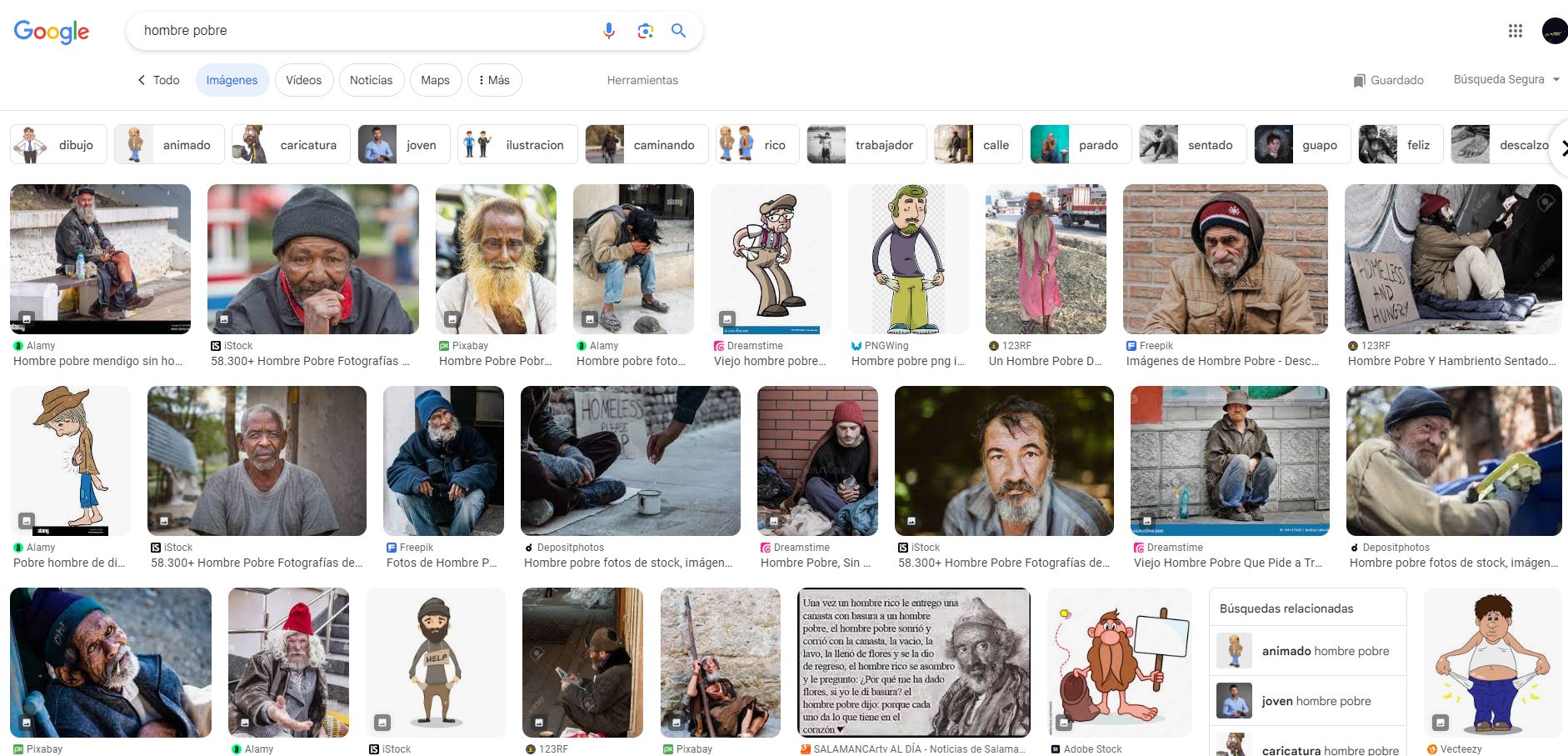

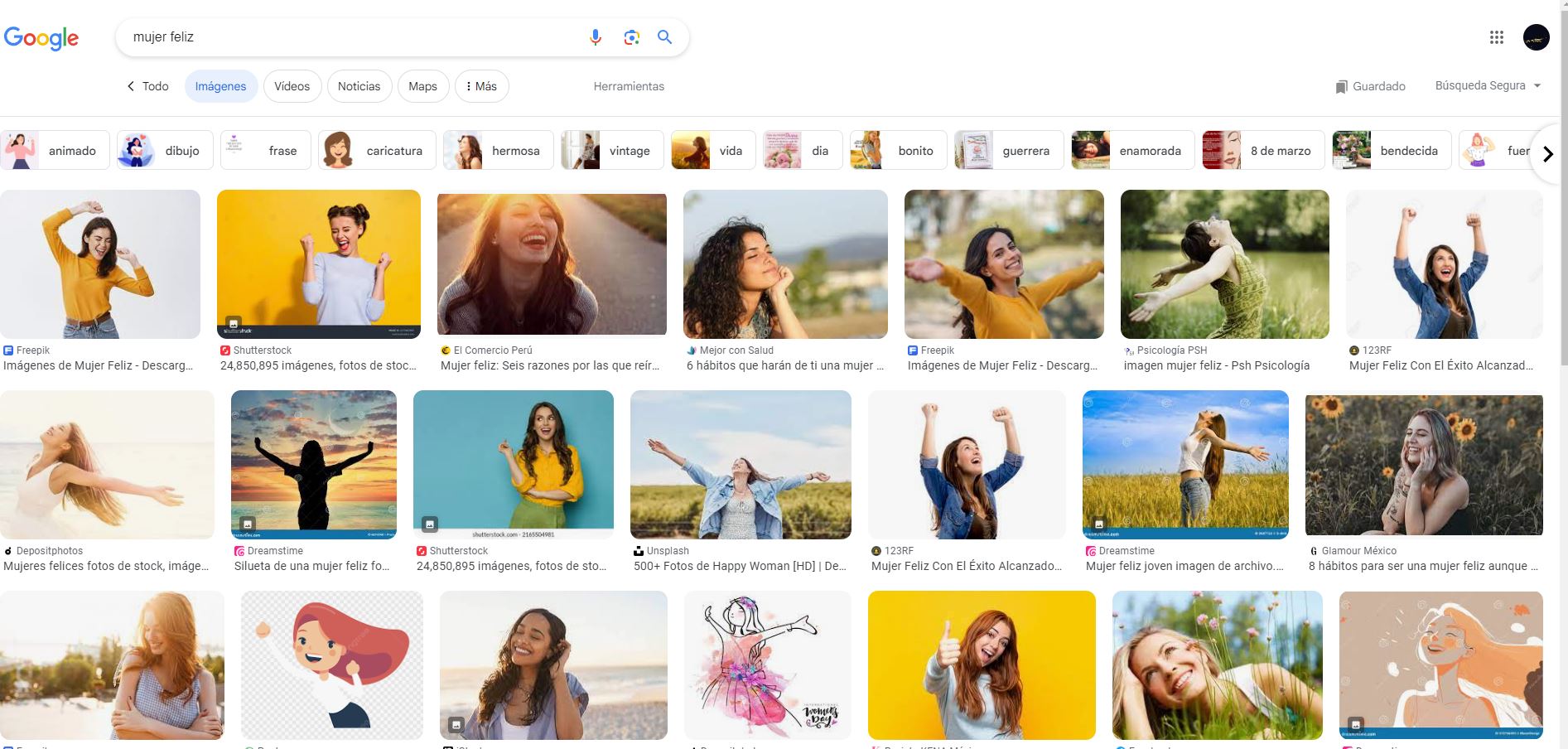

La desinformación, el discurso de odio y el abuso de la inteligencia artificial para la creación de noticias falsas son algunos de los problemas asociados con el ejercicio del periodismo y la prensa libre. Esta situación rompe la promesa de la democratización de la información y el acceso libre al conocimiento. En la era digital caracterizada por el capitalismo de plataformas, las famosas plataformas no solo facilitan y controlan las interacciones entre usuarios y entre servicios, sino que también monetizan dichas interacciones y transferencias masivas de datos, creando fortunas jamás vistas hasta ahora.

Esta forma de generar riqueza es un divorcio radical de los modos tradicionales de organización de la actividad económica. No es que los dueños de los medios de producción hayan desaparecido, por supuesto que no, sino que a la par de estos emergió, en un pestañeo, una nueva clase propietaria de la información; y la información es lo que más abunda por estos días: en tu teléfono, en la vía pública, en tu refrigerador. Este escenario, tan próspero para tan pocos, se sustenta a partir de la datificación de afectos y anhelos. Una vida es igual a un bit que, a su vez, es igual a mercancía.

Para atender la evidencia patente de que compañías y personas lucran con difusión de contenidos falsos y/o maliciosos en línea, junto al desorden regulatorio en esta materia producto del frenético avance de todas las tecnologías, para el que los marcos normativos existentes parecen no poder seguirle el ritmo, es que la UNESCO se propuso como misión, en 2021, la creación de directrices para la regulación de plataformas digitales.

Derechos Digitales ha realizado contribuciones a este proceso en cuatro ocasiones (1, 2, 3, 4) y en todas hemos recalcado que los dueños de las plataformas deben hacerse cargo de las eventuales violaciones a derechos fundamentales que ocurran en ellas, que su quehacer se rija bajo estándares internacionales de protección de derechos humanos, y que incorpore una perspectiva de género transversal a todas sus políticas. También abogamos por la inclusión explícita de derechos a las comunicaciones privadas y al uso de tecnologías de cifrado, especialmente en defensa de ataques y persecuciones por parte de Estados.

A pesar de nuestras sospechas iniciales, en este punto de la discusión podemos reconocer que el proceso ha dado lugar a sinergias interesantes que abren la puerta para alianzas claves para equilibrar, en parte, las asimetrías de poder propias de estos espacios. El futuro de los entornos digitales está lejos de ser una asamblea directa, no cabe ilusionarse. Sin embargo, hemos recogido aprendizajes sobre cómo aproximarnos a los desafíos mencionados desde distintos enfoques, de la mano de diferentes actores y actrices, en un contexto situado en América Latina.

Todas las manos

En la recién estrenada edición del reporte Global Information Society Watch, Renata Ávila toma el tema del multistakeholderism y levanta tempranamente las alertas correspondientes: hay falta de referencias para las comunidades que desean ser parte sobre cómo hacer de su contribución una participación significativa, lo que resulta en que procesos que son presentados y dirigidos para múltiples partes interesadas deriven en un ejercicio de blanqueo para quienes participan siempre a través de la tokenización de minorías incorporadas a la mesa precisamente con ese propósito, como para decir: “sí, somos inclusivos” y rendir la cuenta respectiva.

Otro aspecto que es subrayado a lo largo de nuestras contribuciones al proceso es el imperativo de idear maneras constructivas para fomentar la inclusión verdadera y un ejemplo es la creación de consultas regionales sobre los temas que plantea UNESCO. Plazos rígidos y poco tiempo para estudiar las versiones del documento de Directrices que no están en inglés y participación limitada en los debates sobre los contenidos del texto van en la dirección opuesta.

Pero, pese a que el tamaño de la mesa de la toma de decisiones es reducido y las sillas, incómodas, la infraestructura de internet somos todas. Las libertades de expresión y prensa también son fundamentales para hacer de la participación algo valioso y viceversa: la buena participación multisectorial garantiza que estos derechos se ejerzan de manera cabal y en todo lugar. Estas son parte de las reflexiones que pudimos entregar durante la Conferencia y que, por cierto, seguiremos trabajando de aquí en adelante.