La edad avanza y llegamos a un punto en la vida en que vemos con curiosidad que las cosas se repiten. Convivimos por décadas con un tecno-optimismo que nos hizo ciegas a la complejidad implicada en el desarrollo tecnológico. Discursos sobre el potencial de internet para facilitar el acceso a todo – la cultura, el conocimiento, la información, la educación, etc. – olvidaban que esas mismas tecnologías no se diseñan, ni se implementan en el vacío. Un escándalo tras la exposición de cómo las principales potencias mundiales utilizaban la misma infraestructura de internet para meterse en las comunicaciones privadas de todo el mundo – incluidos jefes de Estado – fue necesario para traernos de vuelta a la tierra. Sí, las tecnologías digitales pueden y han generado mayor democratización en algunos ámbitos de la vida y para algunas personas. Pero no, no se trata de una panacea que nos va a salvar de todos los males del mundo. Al contrario, puede exacerbar algunos de esos males.

Entra 2024 – 11 años desde las lecciones dejadas por las revelaciones de Snowden –, pero parece que retrocediéramos en el tiempo. Se reemplaza “internet” por “IA” y nuevamente se multiplican expectativas sobre los potenciales beneficios (en este caso, rara vez comprobados) de esta innovadora tecnología. Incluso, frente a críticas sobre su implementación y crecientes evidencias de sus impactos en el ejercicio de derechos, se apuesta a cómo nos ayudará a superar problemas históricos y estructurales que van desde la crisis climática hasta el acceso a salud de calidad y la inclusión de personas con discapacidad. Hay quienes dicen, incluso, que la IA ayudará a combatir la desinformación – quizás ignorando u olvidando que las decisiones algorítmicas automatizadas por detrás de la priorización de contenidos en las plataformas de redes sociales están entre las raíces del caos informativo en la esfera pública digital.

Una “inteligencia” socialmente construida

Lo que se conoce como IA hoy se refiere, en gran medida, a un conjunto de procesos y técnicas que permiten a un sistema computacional hacer cálculos estadísticos capaces de identificar patrones y a partir de ellos, predecir comportamientos. Podría parecer obvio, pero es importante resaltar que pese a la referencia a la inteligencia humana, este tipo de sistema está lejos de tener una capacidad crítica o empática, por ejemplo.

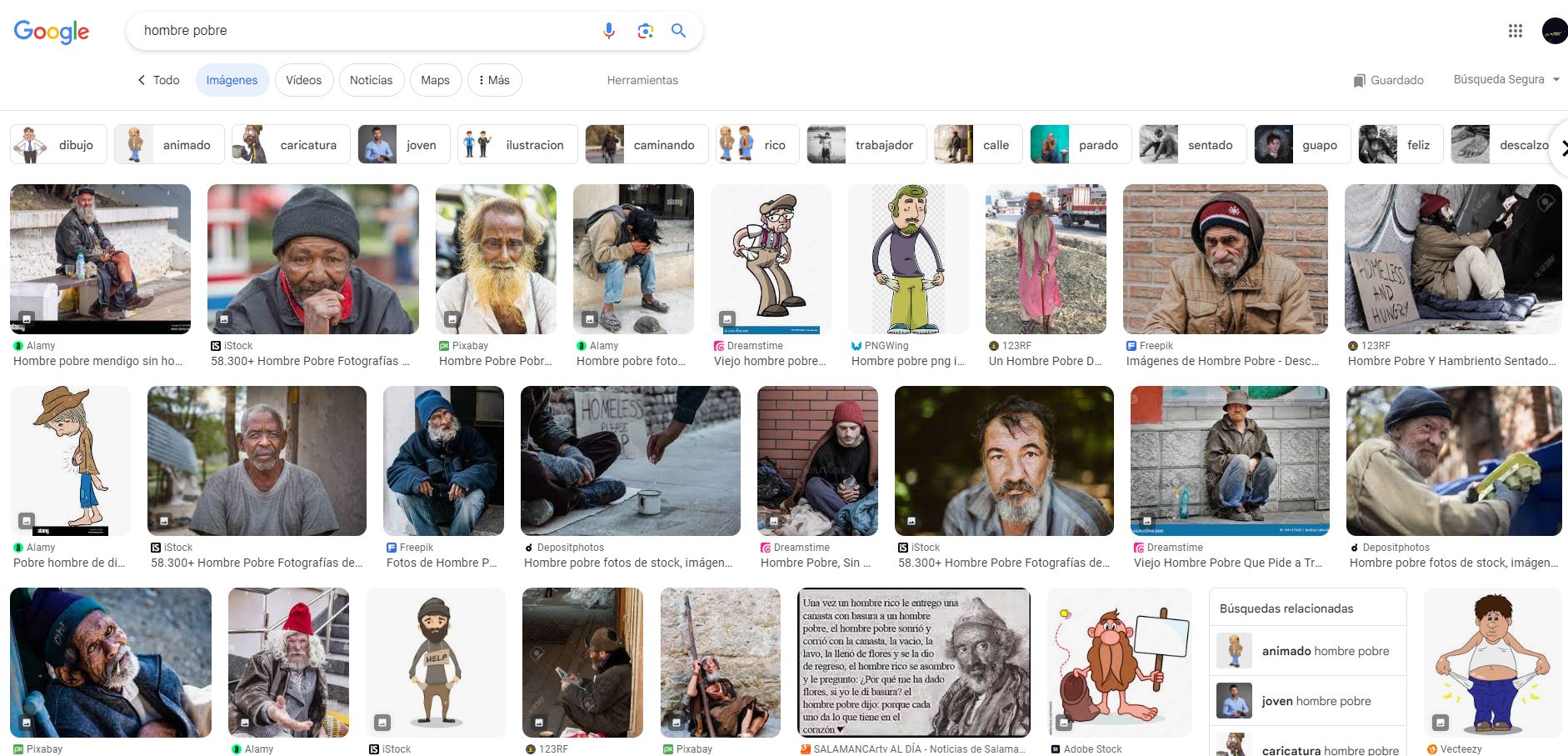

Ellos dependen de al menos (i) la disponibilidad de bases de datos que permitan “entrenar” determinados modelos matemáticos para sacar inferencias, (ii) la existencia de masas de trabajadoras clasificando y etiquetando estas bases de datos según diferentes criterios, (iii) el desarrollo de los modelos algorítmicos responsables de los cálculos, y (iv) una interfaz para la interacción con las usuarias finales o con otros sistemas. Para que la IA exista es necesaria también una infraestructura física, compuesta por cables de telecomunicación, satélites, centros de datos, súper computadoras con extrema capacidad de procesamiento, baterías, etc.

Más allá de la idea de automatización, cada uno de esos procesos implica un conjunto de decisiones humanas influidas por aspectos culturales, éticos, históricos y sociales y, en algunos casos, afectada por factores políticos y económicos. Como en el caso de cualquier tecnología, la IA no es neutral y tampoco fruto de cualquier tipo de magia.

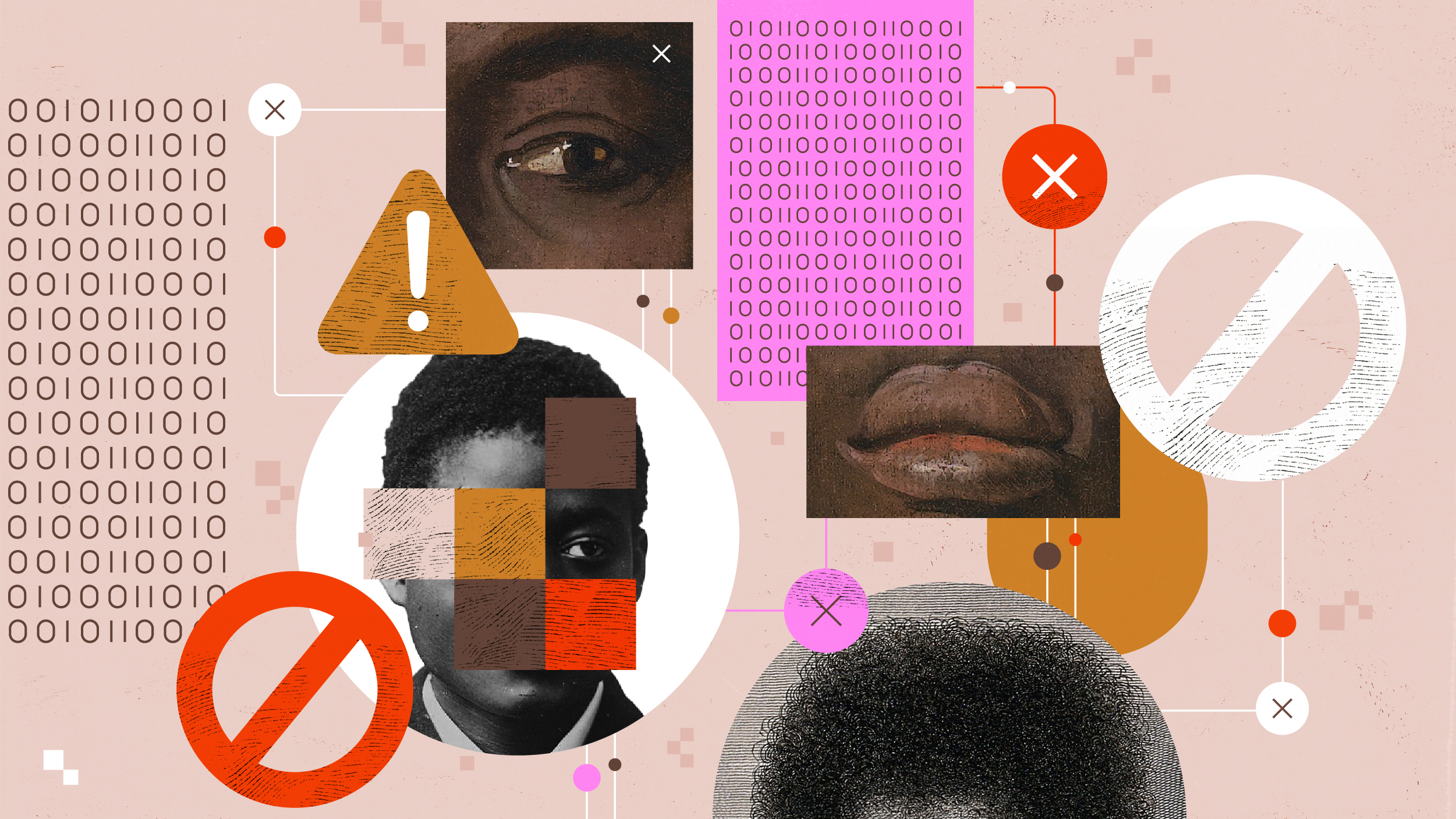

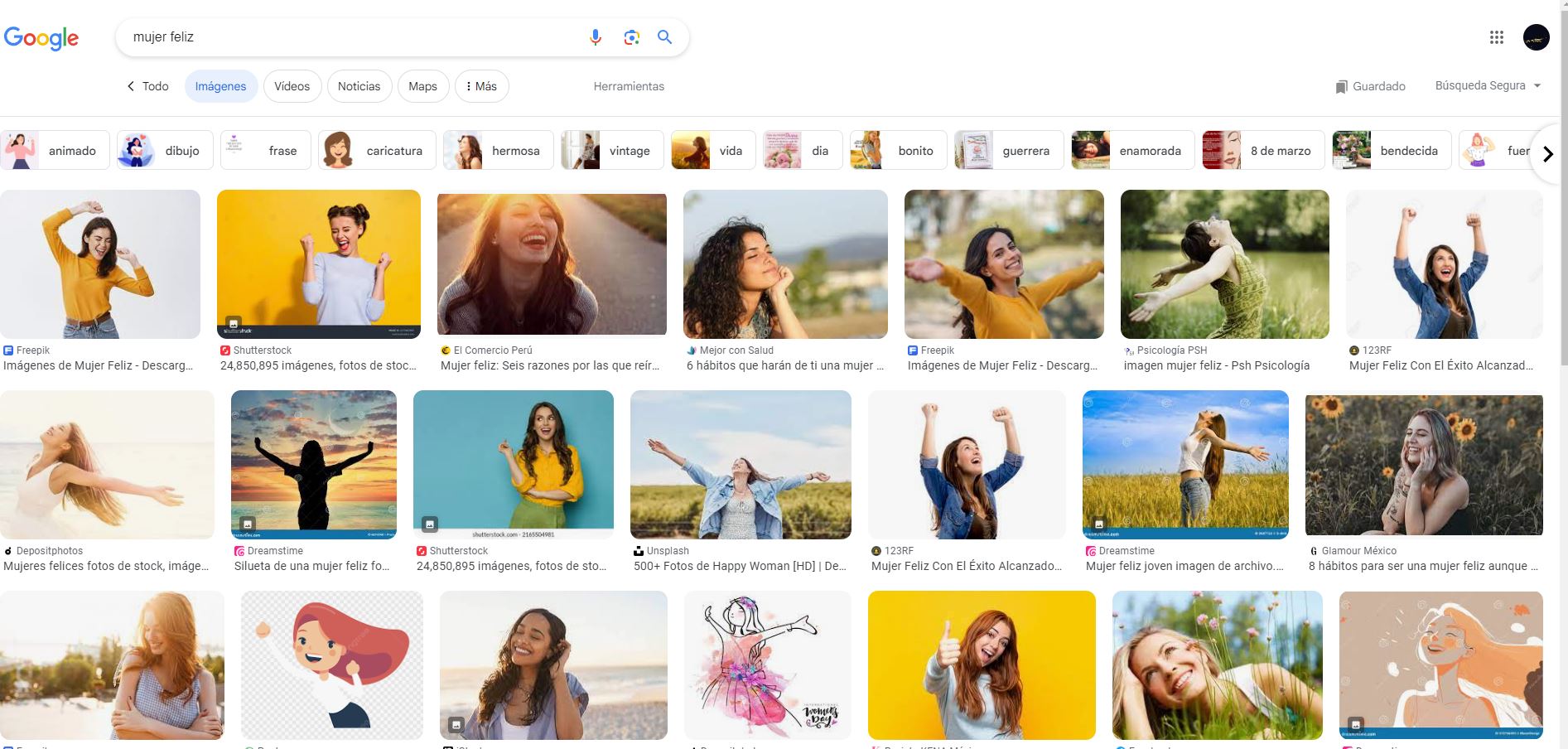

Como sintetiza el investigador de la Universidad de Edinburg, Ben Williamson: esos sistemas materializan formas particulares de percibir el mundo y a su vez pueden influenciar y modelar la manera como las personas actúan en el mundo. Académicas feministas hace mucho apuntan a ese aspecto. La australiana Judy Wajcman, por ejemplo, ha explorado ampliamente cómo las relaciones de género se encuentran materializadas en las tecnologías – que no solo incorporan nociones de masculinidad y femineidades socialmente construidas, sino que luego pasan a ser parte en la construcción del significado de tales conceptos. Y Ruha Benjamin, profesora en la Universidad de Princeton, a su vez, presenta la idea de diseño discriminatorio al identificar cómo las jerarquías raciales son normalizadas en la producción tecnológica.

Por otro lado, tal como el diseño y la implementación de las tecnologías y la IA son permeadas por factores culturales y sociales, también lo son sus usos. Aplicaciones y sistemas desarrollados para ciertos fines, pueden muy bien ser utilizados para otros y los ejemplos abundan. Al contrario de una idea determinista de que los sistemas producirían por sí mismos ciertos resultados – positivos o negativos – en la sociedad, se trata de pensar que los usos de las tecnologías son múltiples y que están en constante interacción con los contextos en que son implementadas.

IA: ¿para el bien, o para el mal?

No es posible, por lo tanto, hablar de una AI for good, o “IA para el bien”. Ese tipo de idea además de mostrar como los aprendizajes, aunque dolorosos, pueden no ser duraderos, refleja nociones deterministas y simplistas sobre las tecnologías que perjudican las importantes discusiones sobre su gobernanza.

El énfasis en el (supuesto) objetivo de determinado sistema – como si hubiera fines legítimos “para el bien” que justificaran el no cumplimiento de determinadas obligaciones –, opera como una cortina de humo que nos distrae de los procesos productivos por detrás de su desarrollo y despliegue. Antes de emprender la imposible tarea de enumerar despliegues positivos o negativos de IA, como si las mismas nociones de “bien” y “mal” fueran estáticas y universales, nuestros líderes deberían reforzar los principios acordados en el marco internacional de derechos humanos a todas las etapas de producción de IA.

Eso implica garantizar que las bases de entrenamiento cumplan con estándares de protección de datos; que las personas que trabajan en la cadena de producción de la IA – sea en la extracción de minerales usados para la creación de productos tecnológicos, sea en el etiquetado de datos – reciban una compensación justa por su trabajo y tengan observados sus derechos laborales; que los data centers obedezcan la legislación ambiental; que las personas indígenas sean consultadas de manera previa antes de intervenciones que puedan impactar sus derechos. Algunas de estas recomendaciones incluimos en el insumo de Derechos Digitales al reporte intermedio del Órgano Asesor sobre IA de la Organización de las Naciones Unidas.

No hay magia

Ningún “bien” puede derivar de la vulneración indebida de derechos garantizados. Adoptar una perspectiva de derechos humanos al enfrentar los desafíos de la gobernanza de IA significa avanzar en mecanismos para lidiar con situaciones complejas y concretas. Tal compromiso debe ir mucho más allá de la creación de principios éticos o declaraciones vacías, pero garantizar, por ejemplo, que las empresas y los Estados sean debidamente responsabilizados en el caso de abusos derivados del desarrollo o despliegue de IA.

El marco de legalidad, necesidad y proporcionalidad es una buena referencia tanto para la resolución de conflictos, como para guiar la digitalización de manera que dichos procesos no impliquen ni un incremento en el deterioro ambiental o reemplacen necesarias inversiones en infraestructura básica de educación, salud, entre otras. Además, resulta fundamental llevar a cabo estudios de impacto en derechos humanos con una participación amplia y diversa para guiar decisiones de diseño y despliegue.

El avance de los Objetivos de Desarrollo Sostenible, la “modernización”, “progreso” o la “participación en la economía digital” no pueden ser excusas para la promoción de tecnología de manera irresponsable. La transformación social y la superación de desigualdades siempre dependerá de compromisos sostenidos de los Estados y del apoyo y participación de las distintas partes interesadas. La realidad muestra y reitera que no existen las fórmulas mágicas.