Investigación que indaga en la implementación de distintos sistemas tecnológicos para controlar el acceso a la protección social en Venezuela y Bolivia.

Temática: Vigilancia

Desentrañando la vigilancia que llegó junto a la pandemia

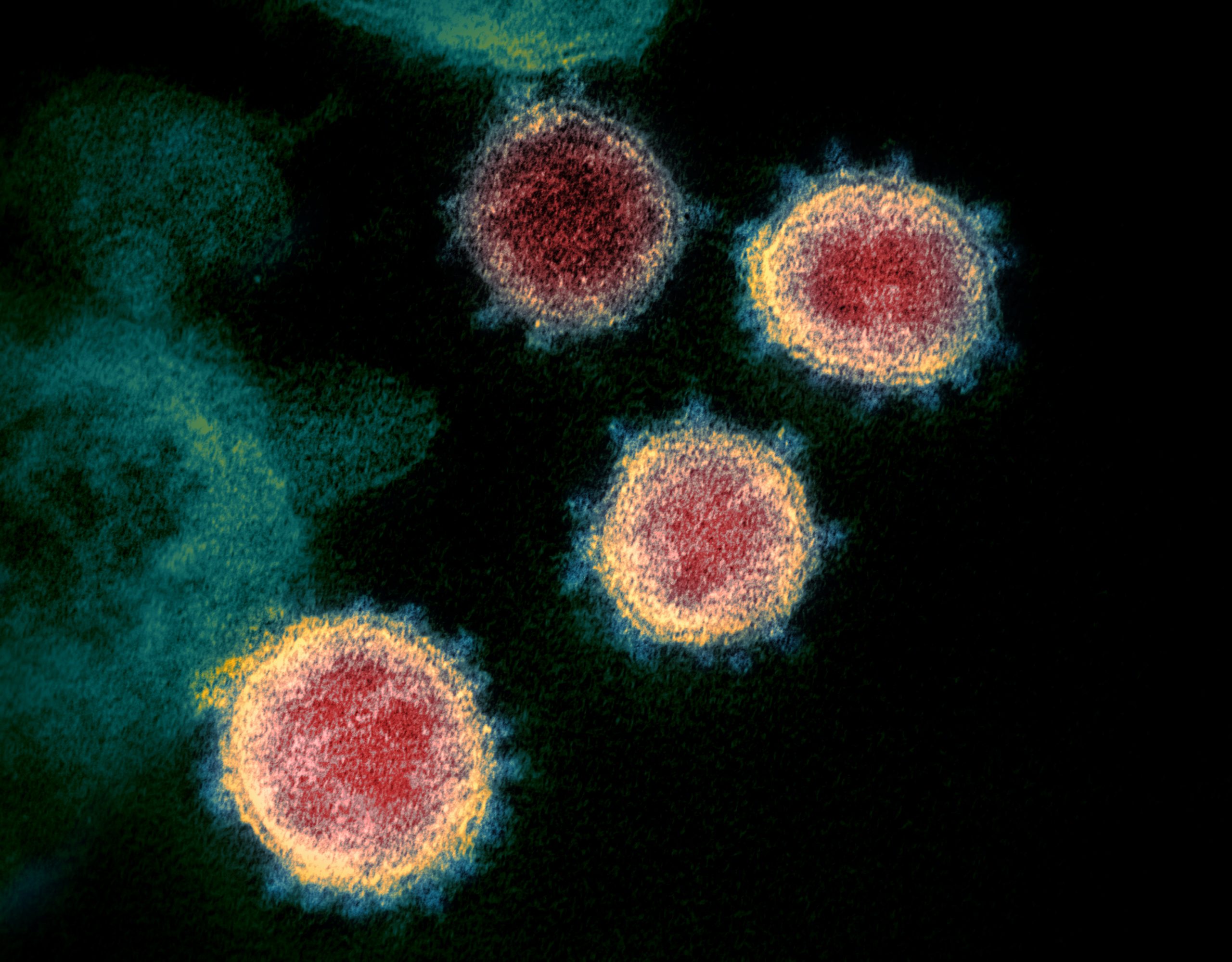

En marzo de 2020, en un par de semanas, varios países de América Latina confirmaron sus primeros casos de Covid-19 y adoptaron medidas para evitar la propagación. Luego de que la Organización Mundial de la Salud (OMS) declaró la pandemia del virus, comenzaron los esfuerzos de confinamiento obligatorio en la región, y también en Chile.

En el marco de la iniciativa “Sonríe #estamosvigilando”, coordinada por el Centro por la Justicia y el Derecho Internacional (CEJIL), el pasado 18 de marzo presentamos solicitudes de acceso a la información pública para conocer los aspectos asociados a las tecnologías utilizadas por el gobierno, CoronApp y el sitio web Comisaría virtual (comisariavirtual.cl). El objetivo es identificar las prácticas que busquen garantizar la transparencia y la protección de los derechos humanos frente a la ejecución de tecnologías de gestión de la información durante este periodo, además de saber cuánto se dirige a fines sanitarios, y cuánto a crear nuevas formas y mecanismos de vigilancia.

A medida que la pandemia ha avanzado, los Estados y los actores privados se han apresurado en implementar soluciones tecnológicas que prometen identificar y rastrear el virus para contenerlo. Pero, al mismo tiempo, estas soluciones recogen información que es útil para vigilar y seguir a las personas mediante datos telefónicos, reconocimiento facial, cámaras, georreferenciación, control de la temperatura y otros. En este proceso, las aplicaciones conservan datos personales y sensibles sin las suficientes garantías para su protección o tratamiento. Por esto, a raíz de los riesgos que presentan para los derechos humanos, resulta necesario saber las condiciones de diseño e implementación.

Tanto CoronaApp como el sitio web Comisaría virtual proponen varias funcionalidades sin dar a conocer cuál es su utilización real y, como Derechos Digitales ha destacado desde su activación, parecieran ser problemáticas. De acuerdo a la legislación vigente en Chile, los datos necesarios para activar la aplicación o para obtener permisos y salvoconductos en comunas con restricciones de movilidad, cada vez que dan cuenta del estado de salud o hábitos personales del usuario se trata de datos personales o datos personales sensibles.

Esto genera dudas respecto al uso de información recabada mediante CoronaApp, en tanto se solicitan datos que permiten identificar a las personas como el nombre, DNI y edad. Lo mismo sucede con la Comisaría Virtual, pues al no existir claridad acerca de sus condiciones de procesamiento, es posible que la herramienta administrativa se convierta en un mecanismo de perfilamiento y vigilancia. Asimismo, las políticas de privacidad de dichas tecnologías no precisan las medidas de seguridad y confidencialidad según las que serán guardados estos datos, y solo abordan de manera genérica las condiciones de almacenamiento, acceso y uso de la información recolectada. Tampoco se establecen con claridad las condiciones y periodos de almacenamiento de la información, ni un procedimiento para que los titulares puedan ejercer su derecho de acceso, rectificación, cancelación u oposición de esos datos de acuerdo a la Ley Nº 19.628.

A falta de mejores resguardos normativos, la transparencia sobre las condiciones de tratamiento de datos personales se hace más relevante. Por consiguiente, hemos solicitado a los distintos organismos involucrados tanto en la implementación de dichas plataformas, como en la fiscalización y promoción de las garantías fundamentales que podrían verse afectadas por estos sistemas de recolección y uso de datos personales. Además de una serie de requerimientos de información pública sobre el uso y el impacto de estas tecnologías, para garantizar que la vigilancia no viole otros derechos fundamentales, como la privacidad, el acceso a la información, la integridad personal, o los derechos a la igualdad y a la salud.

La información sobre las políticas de privacidad existentes no es suficiente y, del mismo modo, la forma en que los datos han sido manejados a lo largo del primer año de la pandemia se torna preocupante. Entre otras cosas, solicitamos información respecto a especificaciones técnicas de las tecnologías, las finalidades específicas de la recolección y tratamiento de las distintas categorías de datos recolectados, los mecanismos y plazos de almacenamiento, los datos que son objeto de transferencia y bajo qué condiciones, así como antecedentes y evaluaciones jurídicas que den cuenta de una evaluación previa a la puesta en marcha de los sistemas.

Cuando se despliegan herramientas tecnológicas con propósitos de interés público, las medidas adoptadas deben ser transparentes, y deben ser evaluadas para determinar su eficacia e impacto en los derechos fundamentales. Esto es importante, sobre todo cuando estamos frente a un patrón de adquisición o producción de tecnologías digitales susceptibles a convertirse en factores útiles para la vigilancia como parte de las funciones estatales.

La implementación de estas herramientas no puede llevarse a cabo afectando los derechos fundamentales. Cualquier persona debería tener derecho a acceder a toda la información relevante sobre las tecnologías de vigilancia desplegadas, incluyendo el alcance, el objetivo de los datos recogidos y los resultados.

Ley de datos personales: sin pausa, pero sin prisa y de cara a la sociedad

El Salvador es uno de los pocos países en la región que aún no cuenta con una legislación específica para la protección de los Datos Personales. A pesar de contar con algunas reglas dispersas, como un breve capítulo en la Ley de Acceso a la Información Pública (LAIP) y algunas normas en leyes sectoriales (Ley de Regulación de los Servicios de Información sobre el Historial de Créditos de las Personas, Ley de la Firma Electrónica, Ley de Partidos Políticos, por mencionar algunas), todavía no existe una ley general en la materia. El propio derecho de acceso a la información personal (Habeas Data) en el país constituye un destacado desarrollo de la jurisprudencia, formulado por la Sala de lo Constitucional de la Corte Suprema de Justicia.

Así las cosas, la necesidad de tener una legislación especializada y coherente con los estándares internacionales de derechos humanos, que abarque el ámbito público y privado, es primordial. No solamente por la necesidad de actualización frente al procesamiento manual de datos del pasado, sino por el crecimiento de la capacidad de procesamiento automatizado que atraviesa cada aspecto de la vida social, en el presente y el futuro, a nivel nacional y global. A pesar de la escasa protección en el ámbito preventivo, asistimos al uso cada vez más frecuente de herramientas tecnológicas, tanto en lo público como en lo privado, sobre las cuales pocas veces se reflexiona y sobre las que la ley tiene alcance limitado para proteger los derechos de las personas.

La ausencia de reglas expresas que permitan la protección de la información personal, tiene ejemplos concretos de riesgos, tanto de parte del Estado como de privados. Desde el año 2017 la Alcaldía del municipio de Santa Tecla ha desplegado cámaras con reconocimiento facial; en la misma línea, el gobierno central solicitó un préstamo para financiar su estrategia de combate a la delincuencia, en el que se incluía la compra de cámaras con tecnología de reconocimiento facial, la compra de drones para la Policía y para el Ejército, y la instalación de centros de monitoreo para ambas instituciones. La empresa privada no se queda atrás: en algunos centros comerciales, a raíz de la pandemia, se instalaron cámaras térmicas para medir la temperatura de los visitantes, sin que se sepa a ciencia cierta si están dotadas con tecnología para el reconocimiento facial o si se almacenan las imágenes captadas; todo sobre lo cual no se informa a los usuarios al ingresar.

En este contexto de uso de tecnologías susceptibles de almacenar datos personales como las descritas, se anunció la discusión en la Asamblea Legislativa de un proyecto de Ley de Protección de Datos Personales, lo que constituye en principio una excelente noticia. La propuesta se encuentra en discusión previa aprobación del articulado dentro de la Comisión de Economía donde, una vez obtenido dictamen favorable, el proyecto pasará a discusión en el Pleno Legislativo.

Si bien es cierto que tanto la información oficial como la de prensa dan cuenta de la participación de algunas instituciones de la sociedad civil en el proceso consultivo de las distintas propuestas de anteproyecto, no se tuvo una publicidad adecuada para que cualquier ciudadano pudiera expresar su opinión sobre la normativa y se produjera un debate más amplio en la sociedad acerca de aspectos que necesitan ser incorporados en esta regulación. Además, mucha de la discusión se dio en el marco de la emergencia por COVID-19, lo que distrajo naturalmente la atención de la ciudadanía. Sin embargo, por ser un tema de mucha importancia para el país, la discusión merece al menos una atención amplia, por lo determinante que resulta para el ejercicio de los derechos fundamentales de las y los salvadoreños. A continuación presentamos nuestra breves consideraciones geenerales sobre el Anteproyecto de Ley unificado, para contribuir a este debate, en la mira de involucrar a la ciudadanía con su atención a esta discusión.

Antecedentes sobre la protección de datos personales en El Salvador

La protección de datos personales en El Salvador tiene su mejor expresión no en la ley, sino en la jurisprudencia. Desde la sentencia de Amparo 934-2007, la Sala de lo Constitucional sostuvo que “… el derecho a la autodeterminación informativa tiene por objeto preservar la información de las personas que se encuentra contenida en registros públicos o privados frente a su utilización arbitraria —especialmente la almacenada a través de medios informáticos—, sin que necesariamente se deba tratar de datos íntimos”.

En la sentencia de Amparo 142-2012, la Sala desarrolló el contenido del derecho a la autodeterminación; señaló que la faceta material de este derecho permite a las personas definir la intensidad con que desea que se conozcan y circulen tanto su identidad como otras circunstancias y datos personales; combatir las inexactitudes o falsedades que las alteren; y defenderse de cualquier utilización abusiva, arbitraria, desleal o ilegal que pretenda hacerse de esos datos; que, para conseguir estos fines, se cuenta con la técnica de protección de datos, que se encuentra integrada por un conjunto de derechos subjetivos, deberes, principios, procedimientos, instituciones y reglas objetivas. En esta sentencia se desarrollan los derechos de los usuarios, así como los principios de la protección de datos personales y algunas reglas para este fin.

Estas sentencias fueron el antecedente para la protección de datos personales. Algunas de estas consideraciones fueron incorporadas en la Ley de Acceso a la Información Pública (art. 31 a 39) y en los Lineamientos Generales para la Protección de Datos Personales en los Entes Obligados, emitidos por el Instituto de Acceso a la Información Pública (IAIP). Se trata de un reconocimiento todavía limitado, que el nuevo anteproyecto vendría a complementar.

El anteproyecto de ley de datos personales

La propuesta de Ley declara su objetivo en su artículo 1: la protección de los datos personales de las personas naturales “… para garantizar el derecho a la intimidad y el derecho a la autodeterminación informativa de las personas naturales”. Resulta muy positivo que se considere el derecho a la autodeterminación informativa como un derecho autónomo del derecho a la intimidad. Sin embargo, aunque en su articulado hay una lógica de interconectar la autodeterminación informativa con otros derechos como la libertad de expresión y el acceso a la información, hubiera sido provechoso dejar en claro esta relación en los considerandos o de manera más explícita en las disposiciones normativas.

El anteproyecto apunta a la regulación del tratamiento de datos personales en general. Sin embargo, al fijar su propio ámbito de aplicación, la propuesta contempla excepciones con algunos elementos que levantan alertas. Por ejemplo, se excluye de la aplicación de la ley a los datos del historial crediticio, hoy regulados en una normativa específica, impidiendo así parámetros comunes para la protección de datos. Por otro lado, excluye la recolección para fines familiares, referidos a los que carezcan de “utilización comercial”, dejando amplio margen de interpretación para excluir de la aplicación de la ley. Finalmente, se excluye el uso de datos con fines de “seguridad pública” o “seguridad del Estado”, sin suficiente precisión sobre el alcance de tales conceptos que permita prevenir las injerencias estatales arbitrarias en la esfera de la autodeterminación informativa, sobre todo mediante tecnologías de vigilancia. Se trata de exclusiones amplias, que restan protección a la información personal en una vasta cantidad de posibles usos por empresas y por el Estado.

Las definiciones del anteproyecto también muestran falta de claridad o precisión. Por ejemplo, el proyecto señala que, por el principio de legalidad, los datos “…deben ser procesados de manera legal”, una expresión circular que no conduce a nada. Por el contrario, la definición debería considerar que, por este principio, la información debe ser procesada en una base jurídica clara, con un propósito claro, y de una manera justa y transparente. Por otra parte, la redacción del principio de privacidad es confusa, mientras que la referida al principio de licitud está poco desarrollada. Y hay aun más ejemplos que demuestran la necesidad de un debate más robusto que auxilie a la redacción de la ley.

También merece atención la protección a una de las categorías especiales de información: los datos personales de niños, niñas y adolescentes. No basta con mencionar únicamente el interés superior de las personas menores de 18 años o las leyes y tratados internacionales pertinentes para considerar que se está prestando la atención requerida a esta categoría de datos. El tratamiento de estos datos debe ser lo más restrictivo posible y no puede permitirse su tratamiento libre, aunque estos sean de naturaleza pública. Esta carencia debe ser subsanada por la ley.

La propuesta de normativa desarrolla los derechos de las personas sobre los datos de los que son titulares, consagrando así los denominados derechos ARCO (acceso, rectificación, cancelación y oposición), siguiendo la tradición y la práctica de muchos países en la materia (Art. 6). Sin embargo, tanto la definición de estos derechos como su operatividad resultan problemáticos. Por un lado, el legislador está equiparando el derecho de cancelación o eliminación de datos con el “olvido”, y al derecho de oposición lo denomina derechamente “derecho al olvido”. Podría pensarse que es una confusión o que se trata de meros sinónimos, pero al momento de señalar las excepciones al derecho de supresión (art. 10), se incluye la hipótesis de que los datos sean necesarios para ejercer la libertad de expresión y prensa, algo que no podría ser congruente si se estuviera legislando sobre el derecho al olvido.

Por otra parte, las excepciones a los derechos ARCO (Art. 18) contienen disposiciones de interpretación muy amplia. Por ejemplo, puede negarse el ejercicio de los derechos en caso de lesiones a los derechos de un tercero, sin más desarrollo que permita saber cómo se acredita esa lesión o por quién; se menciona también la resolución de una “autoridad competente” sin especificar de qué autoridad se trata; finalmente, autoriza la denegación de los derechos de manera genérica en “los demás casos establecidos en la presente ley u otras leyes aplicables”, sin exigir el cumplimiento de estándares de legalidad, necesidad y proporcionalidad en la afectación del ejercicio de derechos fundamentales.

El artículo 56 autoriza el tratamiento de datos para la elaboración de perfiles con fines promocionales, comerciales o publicitarios. Aunque se señala que estos datos deben haber sido obtenidos con el consentimiento de los usuarios, más parece una “solución” para aquellos casos en los que las empresas recolectan datos sin que los usuarios lo sepan, que una obligación para cumplir con este requisito de consentimiento informado. Por otro lado, no se hacen exigencias adicionales para el consentimiento expreso para transferir a terceros los datos que ha recopilado de esta forma y para estos fines.

La necesidad de una autoridad de control

Como es habitual en las discusiones modernas sobre protección de datos personales, se intenta regular teniendo en mente la existencia de una autoridad de control de datos personales, es decir, un órgano estatal encargado de la fiscalización y la observancia de la ley. Esta discusión no está del todo zanjada en el proyecto de ley de datos personales, y es un debate legislativo complejo y con distintas posiciones dentro del país.

En las discusiones sobre la autoridad que debería encargarse de la protección de los datos personales, se han barajado al menos tres opciones: 1. Que asuma ese rol el Instituto de Acceso a la Información Pública, el ente que actualmente tiene bajo su competencia velar por el acceso a la información pública y la protección de los datos personales en el Estado; 2. Que la Dirección de Protección al Consumidor (DPC) tenga esa competencia; y, 3. Que se dé origen a un nuevo ente público. Los argumentos a favor de cada una de ellas varían entre la disponibilidad inmediata de personal capacitado en el IAIP, la visión más comercial de incluir a la DPC y la ventaja de formar desde cero un nuevo ente, autónomo, independiente, con capacidad técnica y con presupuesto propio. A esas opciones se suma una cuarta alternativa: la competencia en esta materia podría recaer sobre una Autoridad Nacional Digital, regulada por una ley especial bajo el mismo nombre, que, además, tendría atribuciones sobre el acceso universal a internet, el comercio electrónico, la economía del conocimiento, la firma electrónica y la ciberseguridad.

Consideramos que la multiplicidad de funciones puede generar controversias innecesarias cuando se trate, por ejemplo, de la protección de datos personales frente a injerencias de empresas que puedan ver esta protección como una limitante para el desarrollo de sus negocios en el ámbito del comercio electrónico. A la vez, la multiplicidad de funciones puede ser contraria a la especialidad técnica que la protección de datos personales requiere, en particular frente a los desafíos de la tecnología y a la creciente complejidad de los modelos de explotación de la información personal. La autoridad que proteja los datos personales debe estar disponible de manera especial para ese fin, con suficiente autonomía para garantizar una real independencia para aplicar la ley y velar por los intereses y derechos de los titulares de los datos personales, tanto a entes públicos como privados que colectan datos personales, con facultades fiscalizadoras y sancionatorias que hagan efectiva la protección.

Por cierto, no se trata de problemas insalvables. Pero creemos que partes relevantes de la capacidad operativa de la propia ley y el establecimiento de sus mecanismos de observancia no deberían ser dejados a una discusión posterior sobre la autoridad de control. Esta es la oportunidad de fijar no solamente los parámetros sustantivos para la protección de la autodeterminación informativa, sino también el marco para permitir su cumplimiento, tanto a petición de los titulares como por la intervención proactiva de una autoridad fuerte.

Próximos pasos hacia una ley de datos personales

Como Derechos Digitales, hemos acompañado varios procesos en la región para la discusión y desarrollo de normativa de protección de datos personales y nos ponemos a disposición de la discusión en El Salvador para poder aportar desde esa experiencia Latinoamericana. Sabemos que no es tarea fácil para los países que se ponen de cara a ese desafío, pero hemos visto cómo la participación de grupos amplios de sociedad civil con conocimiento técnico en la materia puede ser un aporte para perfeccionar la técnica legislativa, en una forma consciente de los desafíos y oportunidades de cada realidad nacional. Con los puntos aquí presentados buscamos llamar la atención sobre la necesidad de discutir en profundidad un tema que es de vital importancia para las y los salvadoreños: La recolección de datos se da en muchísimos ámbitos de nuestras vidas, desde acceder a un sitio web, caminar en una calle con cámaras de vigilancia, comprar en línea, usar aplicaciones bancarias, ingresar a centros comerciales, residenciales o sitios de entretenimiento. La tecnología avanza en la sociedad, y los derechos no pueden quedarse atrás. Esperamos que los legisladores salvadoreños asuman hoy la responsabilidad de modernizar la legislación de un modo sensible a las necesidades de protección de la ciudadanía sin pausa, pero sin prisa para un buen resultado de protección.

Sucesos regulatorios en materias de privacidad e internet en Latinoamérica

Análisis de los cambios en materias legislativas y jurisprudenciales en materias como protección de datos personales, actividades de vigilancia e inteligencia, delitos contra la intimidad, reglas sobre retención de datos y normas sobre biometría

Sobre la (in)violabilidad de las comunicaciones

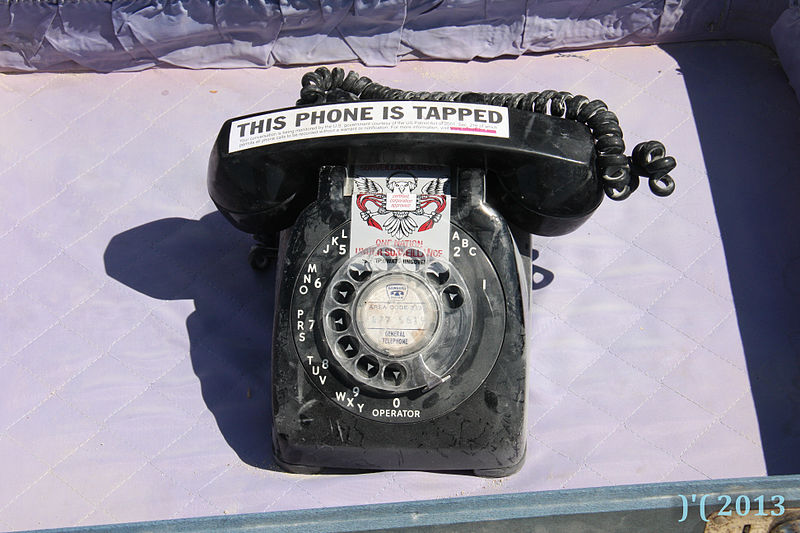

El derecho a la inviolabilidad de las comunicaciones privadas es un derecho fundamental contemplado en las principales convenciones internacionales sobre derechos humanos. En Latinoamérica, la mayoría de sus países reconoce a nivel constitucional la inviolabilidad de las comunicaciones como un derecho fundamental y que, por tanto, solo puede ser suspendido en casos excepcionales y bajo las condiciones establecidas en una ley. O, al menos, así debería ser.

Los estudios, sin embargo, muestran que el uso de medidas investigativas intrusivas de la privacidad de las personas, entre ellas, la interceptación de las comunicaciones, es una práctica que está lejos de ser excepcional.

Interceptación de las comunicaciones

Dado su carácter de derecho fundamental, la regla general es que el derecho a la inviolabilidad de las comunicaciones solo pueda ser limitado en los casos y bajo las circunstancias establecidas expresamente por ley, lo que se da, generalmente, en el marco de investigaciones penales o por motivos de seguridad del Estado.

Adicionalmente, estas medidas intrusivas suelen ir acompañadas por algunos mecanismos de control para evitar su principal riesgo: que terminen siendo ocupadas como herramientas de vigilancia estatal, especialmente en contra de ciudadanos y disidentes del gobierno de turno. Esto no es conspiranoia, la protección de las comunicaciones privadas frente a la vigilancia estatal se remonta a varios años en el pasado, siendo uno de los primeros antecedentes el caso de Giuseppe Mazzini, activista por la unificación italiana que descubrió que agentes estatales leían sus cartas.

Mecanismos de control de la vigilancia estatal

El principal mecanismo de control es la autorización judicial previa, pero algunos países han ido un poco más allá. Por ejemplo, en el caso de Brasil, una vez realizada la diligencia de interceptación, el juez debe decidir si los resultados son relevantes para la investigación. Otro caso interesante es el de Chile, cuya legislación exige, además de la autorización judicial previa, que la medida de interceptación sea notificada al afectado con posterioridad a su realización (artículo 224 del CPP). Sin embargo, la evidencia indica que los mecanismos de control existentes no son suficientes.

En el caso chileno, el mecanismo judicial ha mostrado ser mucho menos estricto de lo que debiera. De acuerdo a números recientes, se realizan alrededor de 66 interceptaciones diarias, por lo que es difícil que jueces estén analizando el mérito de las solicitudes. Estas solo debieran ser autorizadas bajo sospechas fundadas, basadas en hechos determinados, y para persecución de delitos que merezcan pena de crimen). En cuanto a la notificación del artículo 224, tampoco se cumple.

Actualmente el único mecanismo fiable de control que existe para comprobar cómo funcionan las interceptaciones del CPP es la entrega voluntaria que las principales empresas de telecomunicaciones realizan de datos anonimizados, lo que ha permitido evidenciar los problemas del sistema.

Pero el proyecto de ley sobre delitos informáticos pondría en riesgo este último mecanismo, al aumentar la sanción que arriesgan las empresas en caso de incumplir el deber secreto respecto de los requerimientos de interceptación que reciben. Con las nuevas reglas, bajo la amenaza de una sanción penal – hoy, multa administrativa-, difícilmente las empresas querrán colaborar con instancias de control ciudadano, como la encuesta Quién Defiende Tus Datos.

Una explicación posible para la falta de cumplimiento de esta obligación legal es la falta de capacidades técnicas para realizar las notificaciones exigidas por la ley. De ser este el caso, la dificultad podría ser fácilmente solucionada con la ayuda de las mismas empresas de telecomunicaciones que reciben las órdenes de interceptación.

Estas empresas fácilmente podrían comunicar a sus usuarios el hecho de haber sido objeto de escuchas telefónicas, una vez terminado el plazo de la investigación. Pero actualmente están impedidas de hacerlo. Esto, porque mientras no se formalice la investigación en su contra, el usuario afectado por una escucha telefónica no tiene calidad de interviniente en el proceso penal y, por tanto, el deber de secreto que pesa sobre las empresas de telecomunicaciones alcanza al propio usuario afectado. Esto último, por aplicación del secreto relativo del proceso penal chileno: las investigaciones del Ministerio Público sólo pueden ser conocidas por los intervinientes del proceso (artículo 182 CPP), es decir, fiscal, imputado, defensor, víctima y querellante (artículo 12 CPP).

¿Significa esto que las personas afectadas por interceptaciones no tienen derecho a saberlo? En ningún caso. El artículo 224 establece el deber de notificar al “afectado”, no al “interviniente”. Pero la falta de mecanismos de control eficaces y el desconocimiento de los afectados por esta clase de medidas permite que las mismas sean abusadas, llegando a usarse incluso para la creación de pruebas. Lo anterior es particularmente grave, considerando que ni siquiera el Congreso ha logrado que el Ministerio Público informe sobre el cumplimiento de sus obligaciones legales.

La solución

Dado que el Ministerio Público no está cumpliendo con el deber de notificación del artículo 224, y que se niega a entregar información al respecto, en una sesión reciente de la Cámara de Diputados de Chile, donde se discute el proyecto de ley sobre delitos informáticos, se propuso un mecanismo de control que pareciera ser una solución eficaz y eficiente: que sean las telcos las que cumplan con el referido deber de notificación.

Sin embargo, tanto los representantes del Ministerio del Interior y Seguridad Pública como del Ministerio Público se opusieron a la medida, sin ofrecer una alternativa, aún cuando durante la misma sesión admitieron no estar cumpliendo con la obligación legal de notificar al afectado.

Ante la falta de soluciones alternativas, lo razonable sería que se volviera a discutir la que, hasta ahora, pareciera ser la única solución efectiva.

Ni conspiranoia ni exageración. No necesitamos viajar cientos de años en el tiempo, recordando a Mazzini para justificar nuestra preocupación. Basta pensar en Edward Snowden, cuyo caso – lejos de ser el único- permitió develar la extensión de la vigilancia estatal.

La vigilancia por reconocimiento facial se extiende en la región

El fuerte impacto social y económico que la pandemia de COVID-19 ha tenido y seguirá teniendo en los países de América Latina se ha sentido también en la concepción que tenemos sobre el uso de tecnologías, en particular aquellas que permiten a las personas comunicarse a distancia. No obstante, la inclinación por soluciones tecnológicas y vigilantes a la emergencia sanitaria, no ha frenado la implementación de uno de los fetiches de la seguridad pública: el reconocimiento facial automatizado en el espacio público.

Aparece así una aparente paradoja, en tanto las medidas sanitarias a menudo exigen o recomiendan el confinamiento y, en caso de estar en la calle, el uso de mascarillas que limitan el reconocimiento. Sin embargo, al mismo tiempo se ha apostado por tecnologías de vigilancia biométrica como el reconocimiento facial, que además de ser presentada como extremedamante útil para cuestiones relativas a la seguridad pública, sería también necesaria para controlar la posibilidad de contagios en las ciudades, para fiscalizar el transito entre países (como si no se les identificara en los controles policiales), además de ser lo suficientemente avanzada como para aprender a reconocer a personas con barbijo. Y dado que las necesidades de seguridad se mantienen o aumentan (según sectores políticos, al menos), cabría seguir instalando tecnología de punta para observar a la población. A aquello que ya hemos sabido, se han sumado múltiples iniciativas para implementar la sospecha sobre la totalidad de las personas en el espacio público.

Más ojos sobre las ciudades

En Argentina, la Ciudad de Buenos Aires está usando un sistema de reconocimiento facial automatizado, el Sistema de Reconocimiento Facial de Prófugos (SFRP). Ese sistema, implementado en abril de 2019 y que la Asociación por los Derechos Civiles combate en tribunales por su inconstitucionalidad, llegó hasta las calles a pesar de su aparente falta de respaldo normativo. Esta imposición del gobierno de la Ciudad, en lugar de retroceder frente al rechazo de los grupos defensores de derechos humanos, fue fortalecida mediante un proyecto de ley para regular su funcionamiento como parte de los sistemas ya existentes de vigilancia. El rechazo de la sociedad civil no se hizo esperar.

El mismo mes de octubre en que se discutía el proyecto, Human Rights Watch acusó al gobierno federal de exponer información de niños, niñas y adolescentes, y al gobierno de la Ciudad de Buenos Aires de usar esa información en su propio SFRP, pese a la mala calidad de la información. A pesar de la escandalosa situación, la aprobación por la Legislatura de la Ciudad de la regulación legal del sistema, sirvió para validar su funcionamiento más que para restringirlo. Como acusaba la sociedad civil, se trató de una legitimación de un sistema ya implementado al margen de la legalidad, creando un estado de permanente sospecha sobre la ciudadanía en una de las ciudades más grandes de la región. En el resto del país también observan con interés la tecnología, omitiendo los peligros que involucra.

En México, varias localidades hacen sus propios esfuerzos por erigirse como defensores de la seguridad pública mediante la intrusión extrema en el espacio público. En Ecatepec, en el estado de México, el Proyecto Jaguar promete a la vez vigilancia de alta resolución y conectividad pública. No muy distinta es otra iniciativa en la Ciudad de México, enmarcada en contexto de pandemia (pero con antecedentes muy anteriores). En tanto, en el estado de Coahuila, se anunciaba que la reglamentación para un avanzado sistema de reconocimiento facial estaría lista, a pesar de que la tecnología misma ya estaba disponible. Es más, según relata Quinto Elemento, el sistema fue adquirido por compra directa a mediados de 2019, con la esperanza de desplegarlo a pesar de no contar ni con los datos necesarios para su eficacia, ni con la autorización legal suficiente. Una vez más, la tecnología aparece como un hecho consumado, aun cuando no puede operar, y su regulación como una formalidad secundaria.

En Uruguay, uno de los países más seguros en la región, igualmente avanza con fuerza el uso de reconocimiento facial con fines de seguridad en el espacio público. Ya en febrero de 2020, la misma empresa que mantiene cámaras en la entrada de recintos deportivos se adjudicó la licitación del Ministerio del Interior uruguayo para instalar cámaras con capacidad para el reconocimiento facial, 8 400 en todo el país. La autorización legal faltante, introducida después de esa compra mediante artículos en la Ley de Presupuesto Nacional, ha seguido avanzando recientemente en el Congreso, pese a la fuerte oposición de la sociedad civil.

Con el apoyo de decenas de organizaciones, el mensaje de rechazo a esta forma de vigilancia llegó a los legisladores. A pesar de que el mensaje ha sido también oído por miembros del Congreso, han avanzado medidas para el traspaso de bases de datos personales, facilitando así el funcionamiento técnico del sistema. Y ante la interpelación por los aspectos negativos del sistema, el gobierno ha respondido que las preocupaciones deberían haberse formulado antes del gasto de un millón de dólares en el software. Es decir, la tecnología termina siendo más importante que los derechos de las personas, y su adquisición un hecho entendido como consumado e irreversible. Una respuesta indefendible ante la exposición de un riesgo inaceptable.

El momento histórico

Sabemos que hay más iniciativas, como también que grandilocuentes anuncios a veces parecen no ser tan reales. La oferta de tecnología de reconocimiento facial en el espacio público, tanto con supuestos fines de seguridad como para combatir la pandemia, mediante la identificación de rostros con cubrebocas y todo. No se trata de un camino inevitable; sin embargo, una y otra vez hemos visto a gobiernos locales y nacionales priorizar la adquisición de una tecnología riesgosa y falible, y luego preocuparse de su regulación. Los gobiernos no han entendido que no es necesario prescindir de la privacidad y la libertad en nombre de la seguridad, y que las garantías fundamentales exigen una regulación estricta que no cree esa clase de riesgos.

Mientras así sea, debemos seguir exigiendo el rechazo y la prohibición del reconocimiento facial.

El regreso de los delatores en el proyecto de ley de delitos informáticos

En las últimas semanas se reactivó en el Congreso chileno la discusión del proyecto de ley sobre delitos informáticos, que implementa en Chile el Convenio de Budapest. Hasta ahora, la mayoría de las criticas se han centrado en tres temas: penalización del hackeo ético, modificación de las normas sobre retención de datos y acceso a comunicaciones, y ampliación de las facultades del Ministerio Público, incluida la eliminación del requisito de autorización judicial previa para determinadas diligencias.

Resumido en una sola gran crítica, el proyecto ha servido como excusa para inyectar de nueva fuerza el poder del Estado para invadir la privacidad y la autonomía de las personas. A pretexto de combatir el ciberdelito, el proyecto modificaría sustancialmente las actuales normas del código procesal penal chileno en materia de técnicas de investigación.

Pero hay otro aspecto de este proyecto que, a pesar de ser igualmente preocupante, no recibió mayor atención por parte de la Comisión: la utilización de agentes encubiertos para investigar a personas individualmente consideradas respecto de la generalidad de los delitos contemplados en el proyecto.

El agente encubierto es la medida investigativa más intrusiva que contempla nuestro ordenamiento jurídico y, por ello, históricamente ha sido limitada a la investigación de bandas delictivas organizadas y delitos de especial gravedad.

La marcha por implementar Budapest

El proyecto de ley Boletín 12192-25 sobre delitos informáticos tiene su origen en la suscripción y ratificación por parte de Chile al Convenio sobre ciberdelincuencia, también conocido como el Convenio de Budapest. En 2017, con la ratificación del convenio, Chile adquirió la obligación de adecuar su normativa interna y, por ello, el proyecto busca modificar distintos cuerpos legales. Si bien el proyecto ingresado al Congreso en 2018 era altamente cuestionable y peligroso, algunos puntos han sido subsanados en la tramitación.

Pero con la reactivación del proyecto, urgencia del Ejecutivo mediante, algunos riesgos para los derechos fundamentales vuelven a la vida. Preocupa que el proyecto pretenda expandir los mandatos generales sobre retención de datos, acceso a comunicaciones privadas de las personas y las facultades investigativas del Ministerio Público, al punto de prescindir de autorización judicial para determinadas diligencias. Argumentando que es necesario para la investigación de los delitos informáticos, se busca modificar las normas sobre medidas investigativas del código procesal penal, ampliando el poder de vigilancia estatal dentro y fuera de la red. Todo lo anterior sin siquiera ofrecer garantías para impedir el abuso de este tipo de medidas, por ejemplo, robustecer la obligación de notificar al afectado por las mismas.

De estas nuevas medidas y facultades investigativas, solo algunas se encuentran, hasta ahora, limitadas al ámbito del ciberespacio: preservación y custodia de los antecedentes de investigación, comiso y agente encubierto en línea. Pero la forma en que este último irrumpirá es extremadamente preocupante, pues podrá interactuar directamente con las personas de manera individual, sin necesidad de sospecha de actuación en organizaciones delictuales, para la investigación de cualquiera de las conductas tipificadas en el proyecto, sin atender a la gravedad de las mismas.

La irrupción cibernética del agente encubierto

La figura del agente encubierto fue introducida en nuestro país el año 1995, mediante la ley 19.366, sobre tráfico ilícito de estupefacientes y sustancias psicotrópicas, exclusivamente para la investigación de este tipo de ilícito. Su ámbito de aplicación en el régimen penal común fue ampliado para la persecución de la pornografía infantil en 2004 y en 2011 para la investigación de los delitos de tráfico ilícito de migrantes y trata de personas.

Recién en 2016 fue incorporada en el código procesal penal chileno, a raíz de la ley 20.931, que “facilita la aplicación efectiva de las penas establecidas para los delitos de robo, hurto y receptación y mejora la persecución penal en dichos delitos”, también conocida como “ley corta antidelincuencia”. Esta fue la primera vez que se contempló la posibilidad de utilizar la figura del agente encubierto para delitos contra la propiedad, pero solo para aquellos cometidos por bandas complejas, imposibles de desbaratar sin hacer uso de este tipo de medidas.

Hoy esta medida se encuentra regulada en el artículo 226 bis del código procesal penal, bajo estrictos estándares de procedencia, exclusivamente para la investigación de los delitos ahí indicados y bajo fundadas sospechas de la participación de personas en una asociación ilícita, o en una agrupación u organización conformada por dos o más personas, requiriendo en todo caso autorización judicial previa.

El artículo 11 del proyecto de ley original sobre delitos informáticos contemplaba esta medida, pero limitada a la persecución de delitos cometidos por bandas organizadas. Hasta el día 8 de marzo de 2019 —plazo originalmente fijado para presentar indicaciones al proyecto de ley— este artículo solo fue objeto de 3 indicaciones, todas por su supresión total o parcial. Pero en enero de 2020 se propuso reemplazar su texto por uno nuevo, mediante una indicación del Ejecutivo que seguía de cerca lo propuesto por el Ministerio Público durante las sesiones de discusión. El nuevo artículo mantuvo la posibilidad de usar esta medida para la persecución de todos los delitos contenidos en el proyecto, pero además amplió radicalmente su ámbito de aplicación autorizando su uso para la persecución de sujetos individualmente considerados.

De la delación a la provocación

La medida del agente encubierto es de las más intrusivas en cualquier sistema de investigación criminal. Por ello, históricamente su aplicación ha estado limitada a la investigación de delitos cuya particular complejidad y gravedad justifique el uso de tales medidas. El proyecto de ley actual cambia ambas reglas: permite el uso de agentes encubiertos para investigar a personas que actúen individualmente y respecto de cualquiera de los delitos contemplados en la ley, ampliando de manera considerable el campo de aplicación de una medida que siempre debiese ser extraordinaria. Con esto, se infringen los requisitos de necesidad, proporcionalidad y legalidad que deben respetar las medidas intrusivas de investigación.

Además, este tipo de agentes difícilmente serán meros espectadores de los hechos que investigan. La realidad en la que se introduce siempre estará intervenida por su interacción con aquellos entre quienes busca permanecer encubierto. Por lo anterior, aun cuando se trate de una organización criminal, los casos en que estos agentes intervendrán en calidad de meros espectadores sin colaborar en la comisión de los delitos, serán excepcionales. De autorizarse el uso de agentes encubiertos para la investigación de personas individuales, podríamos pasar fácilmente de la investigación a la provocación, tal como sucedió con esta institución en sus orígenes. El agente encubierto nace de las actividades de espionaje político francés durante los años del absolutismo, derivando rápidamente en la provocación mediante el uso de “agentes provocadores” que promovían desordenes públicos para justificar el uso de medidas de persecución en contra de opositores. No obstante, la propuesta también los exime de responsabilidad de manera amplísima, favoreciendo una acción temeraria y perdonando anticipadamente la delincuencia de agentes estatales

Si, además, cómo pretendió originalmente el Ministerio Público, estos agentes pudieran ser introducidos en la sociedad sin necesidad de autorización judicial previa, se desdibujaría la división de poderes que debiese caracterizar a toda sociedad democrática. El control de este tipo de medidas sería prácticamente imposible.

Contra nuevos poderes desproporcionados para el Estado

El uso de agentes encubiertos es sin duda una amenaza para la democracia y de ahí que el legislador haya sido, hasta ahora, extremadamente celoso en su autorización. Permitir el uso de esta figura para vigilar a personas individualmente e investigar delitos comunes es absolutamente desproporcionado. Ello sería la normalización de una institución inquietantemente parecida a los delatores del período más oscuro de nuestra historia. Bajo esas condiciones la posibilidad real de ejercer determinados derechos como la libertad de expresión, es sencillamente imposible.

Ni aun las particulares características del ciberespacio, argumento recurrente para defender este tipo de medidas, justifican poner en peligro derechos tan esenciales como la privacidad, libertad personal y la seguridad individual (artículo 19 nº7 de la Constitución Política). De la misma manera que la persecución de los delitos informáticos no justifica la modificación de las reglas de investigación contenidas en el código procesal penal chileno para la persecución de delitos cometidos fuera del ciberespacio.

Vigilando la velocidad de conexión a internet y a sus usuarias

Asegurar la velocidad de internet es un deber en Chile. Así lo establece la ley desde noviembre de 2017, pero esta obligación no ha sido exigible por años, a falta de la emisión de normas adicionales por parte de la Subsecretaría de Telecomunicaciones de Chile (Subtel), según ordenaba la misma ley. Esto cambió a fines de julio de 2020. Después de un largo período de consideración, consultas públicas y pandemia, la Subtel finalmente emitió el reglamento que regula al organismo técnico independiente (OTI) encargado del cumplimiento de la ley, y la norma técnica con las condiciones de operación.

Sin embargo, con la emisión de las nuevas reglas se busca consolidar un esquema donde, a cambio de medir las condiciones de conectividad, se pide a cambio información personal de las usuarias de internet.

La propuesta de mediciones de calidad de la red

Para medir el cumplimiento de la oferta de velocidad por parte de los proveedores de servicios de internet, las reglas fijan la necesidad de monitorear esa velocidad. Con ese fin, el reglamento y la norma técnica piden que el OTI registre distintos datos y, en algunos casos, autoriza a Subtel a acceder a esa información. Pero el detalle de los datos que serán recolectados ha sido objeto de cuestionamiento.

Para la medición, el reglamento y la norma técnica definen tres elementos de monitoreo (art. 2 de la norma técnica):

- Los ISP deben permitir al OTI el “acceso a sus sistemas de medición de tráfico en línea, a las capacidades instaladas y a las relaciones de interconexión entre sus nodos de redes de acceso, agregación y core” (art 13 de la norma técnica).

- Realización de mediciones a través de sondas:

- Desde una sonda hasta un servidor nacional en la red del mismo ISP.

- Desde una sonda hasta un servidor nacional en la red de otro ISP.

- Desde una sonda hasta un servidor ubicado fuera del territorio nacional.

- Accesibilidad a sitios web nacionales e internacionales.

- Realización de mediciones a través de un aplicación en el equipo del usuario:

- Desde la aplicación hasta un servidor nacional en la red del mismo ISP.

- Desde la aplicación hasta un servidor nacional en la red de otro ISP.

- Desde la aplicación hasta un servidor ubicado fuera del territorio nacional.

- Accesibilidad a sitios web nacionales e internacionales.

Pero no solamente se establecen esos registros. Se establece además que el OTI tendrá acceso a una serie de datos del cliente que instale la aplicación (art. 12 de la norma técnica), que incluyen:

- IMEI, número telefónico, número de IP, IMSI, SimCard del equipo del usuario.

- Identificador del ISP y nombre del operador de red de ser el caso.

- Marca y modelo de equipo del usuario.

- Fecha y hora de la medición.

- Identificador de nodo de acceso.

- Coordenadas de ubicación geográficas del equipo del usuario.

- Porcentaje de uso de CPU y memoria del equipo del usuario al momento de la medición.

- Niveles de potencia de señal y relación señal a ruido.

Si bien se puede argumentar que estos datos son necesarios para que la OTI realice el monitoreo respectivo y verifique si el proveedor de internet está cumpliendo con la velocidad promedio comprometida, el artículo 24 de la norma técnica establece que la Subtel tendrá acceso a toda esta información de manera agregada, desagregada, en tiempo real y georreferenciada.

Esto es complejo, ya que —como hemos señalado en el pasado— datos tales como el número de teléfono constituyen datos personales, capaces de identificar a la titular. Por otro lado, se incluye en la lista información que da cuenta de las actividades y los hábitos personales del usuario, como también su geolocalización y dirección IP. Es decir, información sensible. Subtel exige acceso a esta información de manera nominada, es decir, siendo capaz de vincular la información con la identidad de cada usuario.

Estas exigencias de datos por la Subtel no solo carece de sentido operativo, sino que van abiertamente en contra de las garantías constitucionales y legales sobre la información personal. Además, se trata de información que no le corresponde obtener a una entidad gubernamental sin una justificación de la legitimidad del fin perseguido, y sin consentimiento explícito de las personas titulares de los datos.

Si la finalidad es la publicación de informes estadísticos, entonces no es necesario que Subtel acceda a esta información de manera nominada, por lo que la medida resulta desproporcionada. En caso contrario, con el el fin de monitorear la velocidad de la conexión a internet, se está creando un riesgo innecesario de que la información sea mal utilizada, que se filtre o se abuse de ella.

Vinculado con lo anterior, y también preocupante, es el hecho de que no se establezca una finalidad específica y exclusiva para esta información recolectada. La norma técnica (art. 25) se limita a decir que esta información será utilizada con el objetivo de elaborar informes comparativos para difundir los resultados a las usuarias, “entre otros fines”. Con esta fórmula, el documento deja la puerta abierta para que estos datos sensibles sean utilizados para fines distintos, lo que contradice los principios de la legislación de protección de datos personales, dejando a los ciudadanos en una situación de indefensión frente al potencial de explotación no autorizada.

La recolección desproporcionada de datos, desde la perspectiva técnica

¿Es necesario hacer mediciones individuales de la velocidad de conexión a internet?

No. Si tomamos en cuenta que el OTI tendrá acceso a los sistemas de monitoreo y a las capacidades instaladas de todos los nodos (equipos de comunicación, ya sean routers o switches) de los ISP, asimismo tendrá la posibilidad de monitorear la saturación de tráfico por cada nodo, pudiendo de esta forma levantar la alerta o generar la notificación al ISP correspondiente. Este punto no es menor, pues al tener los datos de funcionamiento y calidad de red de cada nodo están accediendo al mismo nivel de información de quienes administran la red, a excepción de las configuraciones de los dispositivos. En otras palabras, este conglomerado de datos es bastante valioso para fiscalizar el correcto funcionamiento de las redes.

Cuando un ISP implementa un plan de internet a un cliente, básicamente, lo que hace es un Traffic Shaping (limitación de tráfico), lo que permite controlar la velocidad de transferencia máxima de la conexión contratada. En ese sentido, cabe la posibilidad de que el ISP, al ver que algún segmento de la red pueda llegar a la saturación, aplique un limitante de tráfico a los usuarios hasta una velocidad de transferencia máxima menor a lo contratado, para evitar la saturación de uno o más nodos. En este escenario, el OTI no podría evaluar la calidad del servicio a través de lo expresado en el párrafo anterior.

Acá es donde entran en juego las mediciones a través de sondas. Se trata de una suerte de “prueba de caja gris” en la cual se ejecutan pruebas de tráfico desde una sonda y hacia un servidor o sitios web, ambos con ubicación conocida a través de sus direcciones IP. Esta prueba, si bien aporta información periódica del comportamiento de la red, resulta susceptible de “engaño” a través de una liberación de Traffic Shaping, o con una instrucción de prioridad al tráfico entre ambos dispositivos (sonda-servidor).

En este punto es donde se podría justificar la realización de mediciones a través de la aplicación propuesta, cuyo objetivo es generar pruebas desde los distintos dispositivos (teléfonos, tablets, computadores, etcétera) y hacia servidores en distintos puntos (nacionales e internacionales). En principio parece una buena idea, pero tal como vimos en el caso anterior) también es susceptible de “engaño”, dado que los equipos de comunicación pueden aplicar criterios de prioridad de tráfico hacia las ubicaciones de los servidores contra los que se harán las mediciones. El inconveniente que se genera a través de esta perspectiva de prueba es que en su afán de generar mayor certeza se requiere de información más detallada sobre quién, cuándo, dónde y desde qué dispositivo se realiza la prueba. Esto implica que dichos datos permitirían la identificación de sus actividades georreferenciadas o en redes digitales en el pasado y en el futuro.

Como corolario de lo anterior, está la posible necesidad del manejo de miles de (posibles) pruebas, y que cada una deba ser gestionada a través de reportes, para luego dar paso a rectificaciones, reparaciones o adecuación del plan, lo cual genera un esfuerzo logístico y humano innecesario.

Considerando lo anterior cabe hacerse la pregunta: ¿Existe otra perspectiva o acercamiento para poder verificar el correcto funcionamiento de la red o planes de internet que no conlleve la exposición de datos de los usuarios?

Lo primero que podemos ver es que, del listado de datos que definen como “datos ambientales” (art. 12), se podía prescindir de algunos datos de identificación para resguardar la privacidad del usuario. Por ejemplo, solo registrar el nodo de entrada desde el dispositivo que ejecutó la prueba, el plan contratado, el ISP correspondiente y, quizás, un par más de datos como intensidad de la señal. En este caso, la evidencia no permitiría un reclamo o reparación basada en un hallazgo individual, pero sí permitiría generar la solicitud de corrección del problema hacia el ISP en una zona en particular.

En otro sentido, también se podría generar un muestreo de tráfico por zonas que permitiera generar una estadística de uso y proyectar la demanda futura a modo de ir realizando los cambios necesarios en la red para que pueda soportar el aumento de tráfico en relación a la venta de planes. Para esto, es necesaria la estadística y que esta a su vez implique una política en la tasa de agregación, es decir, para una zona en particular con un comportamiento de tráfico específico y crecimiento estimado se debería generar una limitante a la tasa de agregación o, en palabras simples, a la cantidad de sobre-venta de un canal.

Banda Ancha: definición local para una red global

Uno de los encargos de la ley de velocidad mínima garantizada, era que la reglamentación describiera las características de lo que se ofrece como “banda ancha” por los ISP. La norma técnica fija una regla (art. 23) que es en parte flexible respecto de las velocidades de referencia, pero a la vez establece un parámetro de medición. Si bien es arbitrario el valor mínimo de la velocidad de bajada y la velocidad de subida para ser llamada “banda ancha”, lo importante es la relación entre ellos.

Se debe considerar como elemento técnico que las conexiones alámbricas e inalámbricas poseen un canal de comunicación cuya característica es que su ancho de banda es bidireccional o total. Es decir, un cable cuya velocidad de transferencia es de 100 Mbps puede transmitir 50 Mbps de subida y 50 de bajada o bien en relación 70/30, pero la suma de ambos tráficos no podrá superar la capacidad física del canal.

Al parecer, existe una definición comercial que diferencia a un usuario común de un usuario con requerimientos específicos, dado que las ofertas de varios ISPs corresponden a planes de internet asimétricos bajo demanda, con una relación 5:1 o 20:7 en relación entre las velocidades de bajada y subida, y planes de internet dedicados y simétricos cuya velocidad transferencia de subida y bajada son iguales. Los segundos son más costosos pues aseguran la velocidad de transferencia en cualquier momento, aunque cabe la posibilidad de tener un canal simétrico no dedicado. Esta diferenciación tiene sentido para la oferta de servicios a empresas, en contraste con la oferta para internet en hogares.

En el caso de las conexiones asimétricas (como ocurre con cada conexión casera o común) se podría considerar que la tasa de agregación podría estar limitada en su sobre-venta, de tal manera que permita una relación más baja. Por ejemplo, que el tráfico de subida en una conexión casera o móvil sea al menos la mitad (50%) del tráfico de bajada. Desde un punto de vista comercial, parece tener sentido que los hogares,ya sea con una conexión fija o a través de un dispositivo móvil, tengan una conexión asimétrica donde la red se usa mayormente para recibir contenidos.

Pero esta visión de las necesidades hogareñas es altamente problemática: representa una noción limitada de la utilidad que se le da a la conectividad, no solo para “consumir” contenidos, sino también para producirlo y para comunicarse con otras personas de manera cada vez más sofisticada. Y ese aprovechamiento de las posibilidades de la red solamente aumenta en pandemia. En épocas de una creciente tendencia al teletrabajo, a la educación a distancia, a la telemedicina y a una sociedad obligada a interactar a distancia, es necesario considerar la importancia de que las conexiones permitan un tráfico bidireccional que asegure poder interactuar en la red de forma más igualitaria, donde la velocidad del tráfico de subida resulta tan importante como la de bajada.

Las definiciones de velocidad también resultan problemáticas por lo que implican en relación con la conectividad a nivel global. Por definición, internet representa acceso a contenidos digitales en cualquier parte del mundo y, debido a ello, es que en la mayoría de los países no existe una diferenciación entre tráfico nacional e internacional para la medición. Es decir, la correcta aplicación del término “Banda Ancha” debería aplicarse directamente al tráfico internacional, sin desmedro de que pueda declararse la velocidad de tráfico en territorio nacional. Si bien existen limitaciones técnicas que impiden que pueda asegurarse igual velocidad respecto de conexiones con terminales de distintos lugares del mundo, es importante que existan suficientes condiciones de transparencia que permitan manejar las expectativas de las personas que se conectan a la red. Aun cuando la norma técnica identifica las diferencias entre tráfico nacional e internacional, la oferta comercial de “banda ancha” debe hacerse cargo transparentemente de esa diferencia.

Estas definiciones no son solamente una cuestión comercial o técnica, sino que inciden en la capacidad de crecimiento y de inversión en conectividad. A la vez, su mayor uso no es consecuencia solamente de un contexto global específico, sino que está en juego la forma en que se desarrolla la sociedad en torno a la conectividad digital. Es decir se trata de un servicio estratégico para el desarrollo tecnológico, laboral, económico, educativo y cultural.

La norma técnica en disputa política

La elaboración de la norma técnica por parte de la Subtel ha sido objeto de controversia por las exigencias de datos personales. En contra de la resolución, tanto la industria como la sociedad civil, la autoridad de acceso a información pública y hasta un senador de la República, han reaccionado en oposición a la que ya es una resolución vigente. La actual discusión de una nueva ley de datos personales podría razonablemente limitar riesgos de abuso y permitir la fiscalización del tratamiento no autorizado.

La expectativa desde el interés público es que esas condiciones cambien, pues como hemos dicho, la recolección intensiva de datos resulta desproporcionada frente al propósito de la ley que motiva estas reglas. Pero a la vez, la necesidad de corrección de esas condiciones plantea la oportunidad de mejorar la forma en que se define una internet de velocidad mínima de cara a una sociedad que requiere mejor conectividad.

El futuro del cifrado se define en Brasil

En medio de una pandemia global que releva como nunca antes la importancia de las comunicaciones seguras por medios digitales, el Supremo Tribunal Federal de Brasil (STF) está por decidir dos acciones judiciales sobre los bloqueos de WhatsApp que conmocionaron a usuarias de internet en todo el mundo hace algunos años. Al centro de esa discusión está el debate en torno al valor del cifrado, piedra angular de la seguridad en las tecnologías digitales.

Ese valor, no obstante, es puesto en tela de juicio frente a los requerimientos de los Estados por acceder a comunicaciones e información privadas. Y en esa contraposición de narrativas sobre la tecnología, sobre la seguridad de personas o instituciones, sobre el poder, y sobre derechos fundamentales, la decisión en Brasil puede significar una nueva etapa en la discusión del cifrado en América Latina y el sur global.

Del uso de aplicaciones al derecho al cifrado

La situación de Brasil se remonta a sucesos conocidos en el mundo entero. Entre 2015 y 2016, cuatro órdenes judiciales de distintos juzgados dieron lugar a tres bloqueos de WhatsApp en Brasil. En todos esos casos, el bloqueo era adoptado como una sanción por el incumplimiento de órdenes judiciales relativas a la entrega de información por parte de WhatsApp, información que a su vez no era provista por WhatsApp, por estar cifrada. En todos esos casos, los bloqueos eran mundialmente rechazados como actos contrarios a la libertad de expresión y contrarios al uso de herramientas de comunicación más protectoras de la privacidad.

Dos acciones judiciales ante el STF mantienen viva la discusión en Brasil. La primera es una acción directa de inconstitucionalidad, ADI 5527, que sostiene que el Marco Civil de Internet contiene disposiciones inconstitucionales, en atención al uso de las mismas para el bloqueo de aplicaciones completas, con consecuencias desproporcionadas. Los jueces, al ordenar el bloqueo de aplicaciones (no solamente WhatsApp), estarían dando una interpretación equivocada al Marco Civil de Internet, al ampararse en su articulado para bloquear aplicaciones, basados en causales que no correspondían según la ley. Es decir, una sanción que es parte de las reglas sobre privacidad y protección de datos, usada a propósito del incumplimiento de reglas procesales. A su vez, el impacto del bloqueo se extendió desproporcionadamente a personas dentro y fuera del país, a personas no involucradas en el proceso judicial, en el ejercicio de sus derechos a la libertad de expresión y comunicación.

La segunda acción, la alegación de incumplimiento de precepto fundamental, ADPF 403, apunta asimismo a la defensa de los derechos fundamentales, con el bloqueo judicial de WhatsApp como el acto cuestionado por infringir derechos de libertad de comunicación, libertad de expresión y privacidad. A diferencia de la ADI 5527, que alega la inconstitucionalidad de las disposiciones que autorizan bloqueos en general, la ADPF 403 apunta a los bloqueos de WhatsApp como las medidas infractoras de derechos.

Con ocasión de los bloqueos, se suscitó una enorme preocupación mundial sobre el impacto de decisiones judiciales que impiden la comunicación privada, y la libre elección de las formas en las que se produce, especialmente tratándose de aplicaciones que a la vez son populares y ofrecen mayor seguridad. Pero a nivel judicial, los debates centraban especial atención en los motivos detrás de los bloqueos, como la necesidad de acceder a información como condición para el éxito de investigaciones criminales. Es decir, las disputas entre las narrativas sobre criptografía se movieron también desde el debate político al ámbito jurisdiccional. Y en ese debate, los ministros del STF discuten directamente sobre el valor del cifrado.

Hasta el momento, cuando no hay aún sentencias, los ministros relatores han emitido sus opiniones en ambas causas, con el propósito de informar la posterior votación del STF como cuerpo colegiado. Respecto de la ADPF 403, para la ministra relatora Rosa Weber, no se justifica el uso de Marco Civil de Internet para el bloqueo de WhatsApp, lo que no implica su inconstitucionalidad sino una aplicación errada de la ley. Pero a la vez, agregó expresamente que “sería inadmisible, y a la vez un retroceso, volver ilegal o limitar de ese modo [mediante el bloqueo] el uso de criptografía”. En cuanto a la ADI 5527, el ministro relator Edson Fachin estima que es inconstitucional prohibir a las personas utilizar criptografía de punto a punto, y menciona expresamente el impacto desproporcionado sobre las personas más vulnerables. Para el ministro, el cifrado es “un medio de asegurar la protección de derechos que, en una sociedad democrática, son esenciales para la vida pública”. Lo que la sociedad civil global ha sostenido continuamente, encuentra reconocimiento expreso en las voces de los ministros.

Vacilaciones regionales

La discusión de la temática, tanto en Brasil como en el resto de la región, es también consecuencia de regulaciones mayormente anticuadas o altamente problemáticas. En Colombia, una ley de 1997 con amplísimo lenguaje pone en duda la licitud del cifrado en redes celulares. Leyes de telecomunicaciones en Ecuador (Art. 77) y El Salvador (Art. 42-D) hablan explícitamente de descifrado por empresas en cooperación con investigaciones estatales. Un decreto en Cuba, hoy derogado, mencionaba la encriptación con el propósito de exigir aprobación previa para su uso en redes digitales privadas. Una investigación fraudulenta en Chile esgrimía la supuesta interceptación de comunicaciones cifradas sin ofrecer información fidedigna sobre el modo de obtención.

En todos estos casos, nociones variadas de seguridad defendida por el Estado justifican una visión a menudo anticuada y en todos los casos adversa a la seguridad de las comunicaciones privadas. En otros países, la ausencia de regulación específica en torno a la investigación es parte de características generales de vacíos en la delimitación de los poderes estatales. De este modo, la inteligencia estatal parece depender de su capacidad de infringir la privacidad, aun sin reglas suficientes para asegurar su ajuste a reglas constitucionales vigentes.

La influencia de un fallo en Brasil no se limita a las cuestiones relativas a la presencia o ausencia de cifrado, sino que se inserta en un contexto más amplio de uso de potestades estatales para la investigación, y de los intentos de forzar a una empresa privada a cooperar con las autoridades públicas, además de seguir un patrón de intento de control sobre aplicaciones disruptivas. Es decir, aun cuando pueda haber un buen precedente a seguir tanto en Brasil como en el extranjero en un aspecto de estas herramientas, queda todavía camino por recorrer, especialmente en la legislación, pero también en la discusión pública, en la interacción con las empresas, y a nivel de cooperación entre estados.

La forma en que el debate político se ha producido globalmente en torno a la criptografía a nivel mundial, pone en entredicho la real probabilidad de prevalecer de los derechos individuales y colectivos por sobre los intereses de vigilancia total de los Estados. Sin perjuicio de las decisiones de la judicatura, los ejemplos latinoamericanos demuestran que todavía es el poder político el que tiene la capacidad de regular las potestades estatales de manera contraria a los derechos fundamentales, como demuestra el caso australiano en torno al cifrado, o más ampliamente en torno a la privacidad de comunicaciones en el propio caso brasileño del proyecto de ley de “fake news”.

El futuro de la criptografía

A pesar de la esperanza que otorgan los informes de los ministros relatores del STF, particularmente en la expresa defensa del ejercicio de derechos fundamentales por medio del uso de cifrado de comunicaciones, tampoco existe certeza de que los resultados finales sean favorables. Pero observar de manera más concreta y cercana debates que tan frecuentemente observábamos a distancia entre poderosos gobiernos del norte global y poderosas empresas del norte global, traen a nuestro lado del mundo la posibilidad de discutir cambios necesarios en torno a las formas en que los intereses de seguridad inciden en nuestros derechos fundamentales, y las formas en que los Estados asumen su responsabilidad en ese equilibrio.

La inminente decisión del STF brasileño sirve así como aliciente a seguir persiguiendo un objetivo crucial para el ejercicio de derechos a través de las herramientas tecnológicas: que las tareas investigativas y de inteligencia sean reguladas y ejercidas sin tratar de forzar la mano de la tecnología, sin buscar la expansión del estado vigilante, y sin alterar significativamente la vida privada de las personas. Mientras intentamos reconducir este debate a soluciones democráticas, basadas en evidencia y análisis de riesgos, y respetuosas de los derechos fundamentales, esperamos que el Supremo Tribunal Federal reafirme lo que indicó el ministro Fachin: que los derechos digitales son derechos fundamentales.

Propuesta de regulación de desinformación puede aumentar brechas y exponer las comunicaciones de millones de personas en Brasil

Actualización: Ayer, jueves 25 de junio, se presentó una nueva versión del proyecto de ley. En consecuencia, la votación se aplazo al 30 de junio. En Derechos Digitales estamos estudiando el detalle la propuesta actualizada.

En Brasil, el proyecto de ley conocido como “Ley de Fake News” (PL 2630/2020), destinado en un principio a limitar la circulación de desinformación en internet, se ha transformado en una propuesta de regulación que cede a grupos interesados mayor control sobre la información disponible en línea. ¿Lo peor? El proyecto lo hace en un régimen de urgencia y mientras el Congreso opera de manera remota, con limitadas posibilidades de participación de la sociedad.

Nuevas brechas en contexto ya desigual

Las versiones anteriores de la propuesta ya eran preocupantes, pues ampliaban las obligaciones de retención de datos personales de las usuarias de internet y autorizaban el bloqueo de aplicaciones. Sin embargo, la última versión impone el registro y la identificación de las usuarias de plataformas en línea, por medio de un documento de identidad y de un número de teléfono celular válido. Esta exigencia podría impedir que millones de personas puedan acceder a información y servicios que, en contexto de cuarentena, son más esenciales que nunca. Por ejemplo, una medida de este tipo podría significar que niñas y adolescentes — especialmente de los grupos más marginados de la población— no podrían acceder a aquellas plataformas que hoy son fundamentales para el acceso a la educación.

En un país donde gran parte de la población utiliza internet exclusivamente desde dispositivos móviles y por medio de planes de conexión limitados, las redes sociales y las aplicaciones de mensajería se han tornado esenciales para la comunicación, el acceso a la información y a los servicios esenciales. Durante la pandemia del COVID-19, estos servicios se han utilizado para satisfacer diversas necesidades, como la coordinación de desde redes de apoyo solidario para la distribución de insumos básicos y la denuncia de abusos y violencia doméstica.

La imposición de este registro conlleva la recolección desproporcionada de datos por agentes privados, violando tanto los principios internacionales de derechos humanos como la normativa nacional de protección de datos, y exponiendo a las usuarias de internet a la explotación indebida de su información personal con fines comerciales.

Así también, la obligación de los proveedores de servicios en internet de chequear y suspender aquellas cuentas registradas con números de celular deshabilitados por las compañías telefónicas implica un intercambio innecesario de datos personales entre empresas, afectando también la libertad de expresión, al impedir repentinamente el acceso de las usuarias a toda su red de comunicaciones y contenidos compartidos.

Exponiendo a las más vulnerables

Igualmente preocupante es la imposición de nuevas exigencias a las aplicaciones de mensajería, que se verían obligadas a limitar el número de veces en que un mensaje puede ser reenviado y a almacenar los datos de todas las personas que lo han compartido.

Esta medida busca restringir la capacidad de acción de grupos maliciosos organizados. Sin embargo, junto con ello, pone trabas y límites a la circulación y distribución de contenidos verdaderos y de interés público a través de internet.

La obligación de retención de datos sobre el reenvío de mensajes implica además la asociación directa entre contenidos de una comunicación y las personas involucradas en ella, resultando en una violación al secreto de todas las comunicaciones, y que es fundamental para todas aquellas comunicaciones legítimas que demandan confidencialidad. Si a eso sumamos la ya comentada obligación de registrar a todas las personas que utilizan servicios de redes sociales o mensajería privada, el resultado es un esquema masivo de vigilancia sobre la identidad de las personas y su actividad en redes digitales.

Es previsible que las personas más afectadas por estas medidas serán las defensoras de derechos humanos, ambientalistas, periodistas, participantes en movimientos sociales y activistas en general, principalmente si sus opciones para comunicarse son limitadas. Estas son personas que de manera recurrente sufren amenazas y abusos debido a su trabajo, tanto por parte de agentes del Estado como de los privados, y, por lo tanto, tienen una especial necesidad de comunicarse de manera segura. A la vez, la información que producen a menudo es valiosa, capaz de desafiar a las fuentes de información oficial, asumiendo muchas veces un riesgo a la seguridad personal, por lo que una medida de este tipo puede tener un efecto inhibitorio y conducir a la disminución de la circulación de información.

Fortaleciendo la censura privada

Por medio de una redacción confusa, la propuesta parece obligar la remoción de contenido y cuentas de redes sociales que violen los términos de uso de las aplicaciones de redes sociales, por medio de la apertura de un procedimiento de moderación que incluya el derecho a la defensa. A pesar de que la garantía de debido proceso en la aplicación de normativas privadas respecto a la moderación de contenidos apunta en la dirección correcta, es preocupante que el texto no solo legitime la remoción de contenido, sino que la vuelva obligatoria, sin miramientos por atender adecuadamente estándares internacionales de derechos humanos.

La confusión entre los contenidos que deben ser removidos por violar normas nacionales y aquellos que pueden ser eventualmente removidos por las plataformas —de acuerdo a los estándares establecidos en los Principios Rectores de Empresas y Derechos Humanos de las Naciones Unidas— puede devenir en un ambiente de efectiva censura privada, dado que las plataformas definen sus políticas según intereses comerciales propios.

Un ejemplo de la aplicación desproporcionada de políticas internas es la prohibición de publicar imágenes de personas desnudas en Facebook, que llevó a la remoción de contenidos oficiales del patrimonio cultural brasileño en 2015. En aquella ocasión la imagen fue restituida, pero quizás eso no habría sido legalmente posible si hubiese habido una obligación de remoción como la prevista en el proyecto en discusión. La existencia de un mecanismo de moderación de ningún modo garantiza que este tipo de situaciones dejará de ocurrir, si es que efectivamente existe una limitación a este tipo de contenido en la política de la plataforma.

En el extremo opuesto, la obligatoriedad de moderación podría generar retrasos que comprometan gravemente los derechos de las usuarias que tengan dificultades para acceder a la Justicia, o en aquellos casos en que esta no pueda responder de manera ágil. Ejemplos de este tipo son las amenazas en redes sociales o la exposición de información personal en internet, cuyas víctimas son principalmente mujeres y personas LGBTTTIQ+.

Un debate apresurado

Si bien es fundamental pensar en la implementación de medidas en un marco de responsabilidades, rendición de cuentas y transparencia de las empresas de internet, con el objetivo de mitigar los daños a los derechos humanos que resulten de su actuación, el texto propuesto puede acentuar tales daños, al aumentar su poder de regulación privada en las plataformas de redes sociales. Las problemáticas señaladas en el proyecto de ley reflejan una discusión apresurada sobre el combate a la desinformación, desarrollada en el medio de una grave crisis política y de salud.

El proyecto de ley evidencia un desconocimiento de las recomendaciones internacionales en la materia y una falta de madurez en el debate. La normativa propuesta es desproporcionada para los fines que persigue y va en sentido opuesto a la histórica demanda por universalizar el acceso a internet en Brasil, y disminuir las múltiples brechas digitales que agudizan el problema de la desinformación.

Ni el contexto de pandemia ni la persecución de la desinformación justifican la vulneración de los compromisos asumidos por Brasil con la protección de derechos humanos.

Junto a más de 40 organizaciones internacionales exigimos que el Congreso brasileño rechace la llamada “Ley de Fake News” y convoque un diálogo amplio para discutir cómo responder a los desafíos de la desinformación en línea, acorde a los compromisos del Estado brasileño con el respeto a los derechos humanos.