La Secretaría del Trabajo de México, tras dialogar con más de 30 plataformas digitales, propuso reformar la Ley Federal del Trabajo para incluir un capítulo específico sobre las condiciones laborales en apps como Uber, Didi y Rappi. Esta reforma, inspirada en regulaciones recientes en España y Chile, busca cerrar las brechas digitales y sociales que afectan a millones de personas trabajadoras. Además, luego de que el gobierno español aplicara sucesivas multas a Glovo por el incumplimiento de la Ley Rider, la compañía decidió contratar a los repartidores. Estas iniciativas no son siempre bienvenidas entre las personas que trabajan en estas apps, lo cual lleva a preguntarnos: ¿Podemos imaginar regulaciones del trabajo digital que respeten los derechos laborales y a la vez incluyan las necesidades de las personas trabajadoras?

Un contexto de desigualdad y precariedad

En América Latina, las desigualdades estructurales generan la base de la precariedad en el trabajo digital. Las brechas digitales, caracterizadas por el acceso desigual a tecnología y educación digital, excluyen a los sectores más marginados, creando una división entre quienes pueden beneficiarse de la economía digital y quienes la experimentan desde la vulnerabilidad.

Ante este contexto, las plataformas de trabajo localizado se presentan como una alternativa de generación de ingresos rápida y simple. Sin embargo, operan mayoritariamente sin marcos regulatorios claros, lo que deja a las personas sin acceso a protección social ni prestaciones básicas. Estas personas deben cubrir los costos de operación y mantenimiento de sus herramientas de trabajo, pero esto no siempre es retribuido con ingresos estables. Las plataformas no solo no proveen cobertura ante accidentes y enfermedades, sino que también tienen poder unilateral de suspender o incluso bloquear a estas personas, impidiéndoles trabajar. Estas decisiones pueden estar asociadas a falta de cumplimiento de ciertas métricas, como la aceptación de cierta cantidad de pedidos o viajes. Esto demuestra un claro desbalance que desdibuja el límite entre el servicio autónomo y la subordinación laboral.

Este panorama nos lleva a hacernos la siguiente pregunta: ¿por qué entonces la regulación no es bienvenida entre las propias personas que trabajan con estas apps? La dicotomía entre el trabajo flexible y la relación de dependencia lleva a pensar que una regulación eliminaría los principales atractivos de este trabajo, como la flexibilidad. Es importante destacar que si bien muchas personas utilizan estas apps como forma para generar ingresos extra, muchas dependen de ellas como su única fuente de ingresos, lo cual puede implicar jornadas laborales muy largas debido a que no todo el tiempo de logueo es remunerado. Según los reportes de Fairwork, que evalúan la remuneración horaria por estos trabajos, el índice de pago decente aún es muy bajo, no solo a nivel regional sino también global. Esto es especialmente grave cuando consideramos que en algunos países, por ejemplo en Argentina, se han evidenciado más de un 50% de repartidores y conductores encuestados con carga horaria semanal superior a las 45 horas. Si estos casos no cuentan con prestaciones sociales básicas, estamos hablando de vulnerabilidad laboral.

Estas problemáticas dan cuenta de la necesidad urgente de avanzar hacia marcos regulatorios que protejan a las personas trabajadoras de plataformas y aseguren condiciones laborales dignas. No obstante, algunos países de la región han comenzado a implementar normativas en este sentido. A continuación haremos un breve diagnóstico.

Avances normativos

La región latinoamericana cuenta con distintas iniciativas y abordajes respecto a la regulación. En Argentina, Brasil y Uruguay, el debate se centra en el reconocimiento de la relación laboral, mientras que en Costa Rica y Colombia los proyectos de ley buscan establecer contribuciones a la salud y seguridad social. Luego pueden mencionarse algunas iniciativas para las plataformas de transporte de pasajeros, como los casos de Ecuador y Bolivia, donde estas funcionan bajo un modelo de licencias de operación que permite cierta supervisión gubernamental. De todas formas, aún la mayoría de los países de la región se caracterizan por la ausencia de normativas o iniciativas vigentes en la temática. Buena parte de esta información se puede encontrar en WageIndicator, un portal que centraliza las novedades regulatorias de este tipo a nivel global.

Frente a tal escenario, sumada la presión social por mejores condiciones de trabajo, Chile ha dado un paso significativo con la Ley Nº 21.431. Implementada en 2022, esta ley reconoce derechos como la sindicalización, seguro de accidentes y el acceso a seguridad social, preservando la flexibilidad horaria. Sin embargo, según la última evaluación realizada por Fairwork en Chile, la regulación no siempre resulta efectiva. En muchos casos, las propias personas trabajadoras desconocen los derechos que les corresponden bajo estas nuevas leyes, lo que limita su capacidad para exigirlos. Asimismo, un relevamiento realizado por la OIT en Chile demuestra que el 60% de los trabajadores de plataforma continúan ejerciendo sus tareas en condiciones de informalidad.

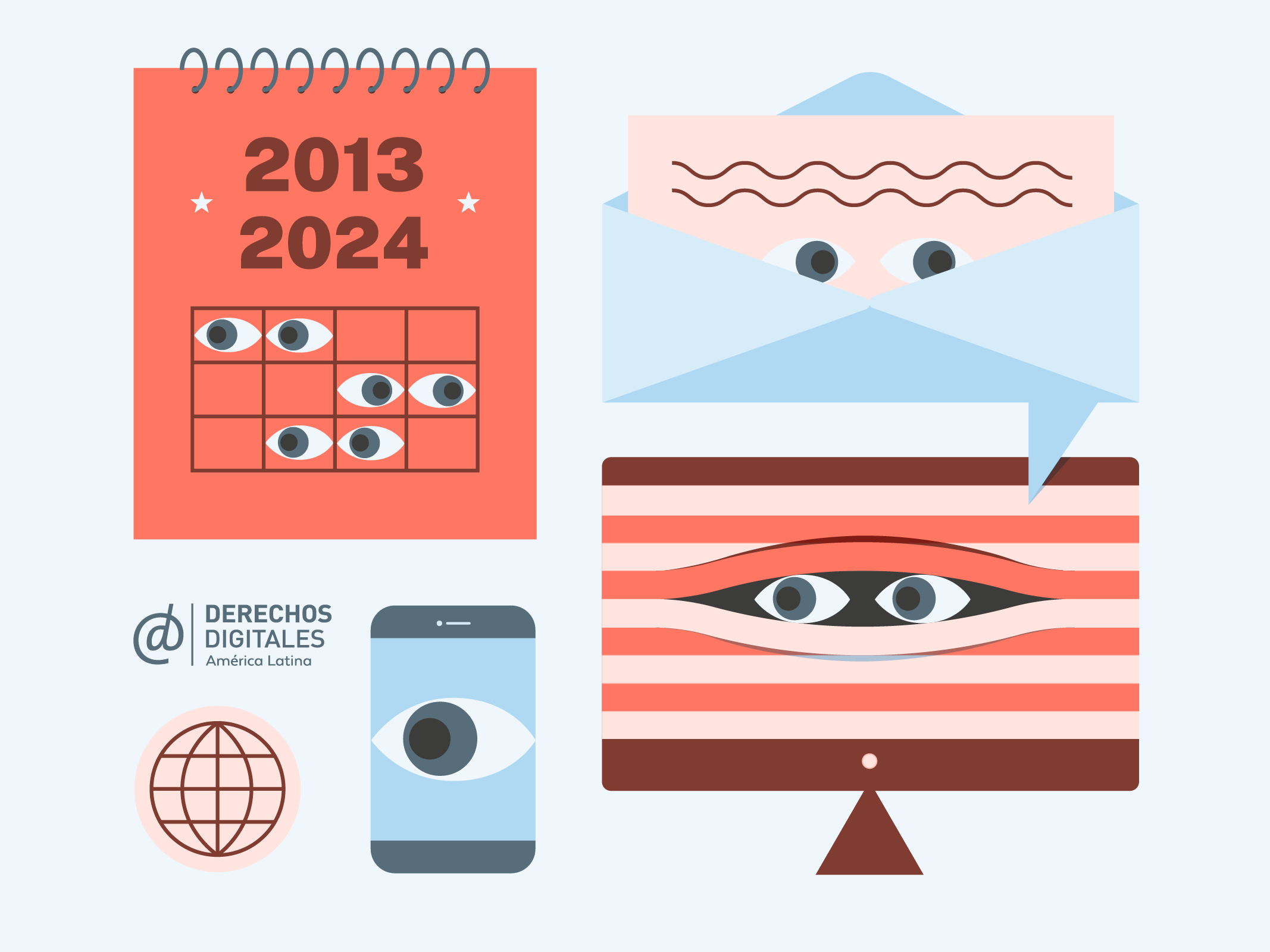

La combinación entre el vacío normativo y la falta de información sobre los derechos fundamentales en el ámbito laboral genera que las plataformas impongan sus propias condiciones. Fue así como en España las plataformas de reparto no respetaban las condiciones establecidas por la Ley Rider, pero luego de que el gobierno aplicara múltiples sanciones, las compañías decidieron acatar la iniciativa adoptando un modelo de contrato laboral.

Las regulaciones buscan establecer límites y protecciones mínimas, que permitan a los trabajadores acceder a derechos esenciales, sin necesariamente eliminar la flexibilidad que caracteriza a estos empleos. El caso mexicano presenta una propuesta interesante debido al reconocimiento de la subordinación discontinua, permitiendo a los trabajadores conservar la flexibilidad en sus horarios, pero asegurando que el tiempo efectivamente trabajado sea respaldado mediante el otorgamiento del derecho a prestaciones sociales y la desconexión laboral. Asimismo, pretende implementar mecanismos de transparencia en los algoritmos que asignan tareas, y una perspectiva de género que aborda casos de acoso y hostigamiento.

Sin embargo, la regulación no debería entenderse como punto de llegada sino como punto de partida. Resulta indispensable que estos esfuerzos incluyan campañas de concientización a nivel regional, que informen a las personas trabajadoras sobre sus derechos, los puntos donde son vulnerados y las herramientas para hacer frente. Estas iniciativas deben asegurar que los algoritmos utilizados por las plataformas respeten la dignidad y los derechos laborales, y que existan mecanismos para supervisar, auditar y regular el uso de los datos.

El camino hacia un entorno digital más equitativo en la región requerirá esfuerzos coordinados y sostenidos que involucren a gobiernos, organizaciones de la sociedad civil, sindicatos y empresas, con el fin de garantizar que la digitalización sea una herramienta para la justicia y la inclusión, y no un reproductor de desigualdades.