Día a día utilizamos y convivimos con tecnologías que no comprendemos. Sabemos operarlas y obtener ciertos resultados, pero desconocemos el modo en que estos resultados se logran. Entre más invisibles sean las técnicas utilizadas y el conocimiento aplicado, mejor: apenas presiono el interruptor la habitación completa se ilumina; cuando giro la llave, cae el agua. Y aunque para algunos esta idea parezca herética o paradójica, supongo que es normal dado el grado de especificidad que ha alcanzado hoy el conocimiento. Simplemente no se puede saber todo. No es necesario.

Esto no significa que nuestra ignorancia respecto al modo como la tecnología opera esté exenta de problemas. En la medida que la tecnología se complejiza y se vulgariza, empieza a tener connotaciones mágicas y pareciera ser que no hay problema que no se pueda resolver mediante un algoritmo, lo que sea que eso signifique. Y cuando esta idea respecto a la tecnología es promovida por tomadores de decisiones -ya sea por honesta ignorancia o de forma maliciosa- las consecuencias pueden ser gravísimas.

Esto es lo que está pasando hoy en Europa, a propósito de la discusión del polémico artículo 13 de la propuesta de directiva del Parlamento Europeo y del Consejo sobre los derechos de autor en el mercado único digital. Básicamente, el artículo busca que los intermediarios de internet implementen medidas tecnológicas capaces de detectar contenido infractor de derecho de autor antes de que este sea publicado en línea, impidiendo así cualquier daño a los titulares. Estas medidas deben ser adecuadas, proporcionadas, y los intermediarios deben implementar un sistema de apelación al que los afectados puedan recurrir en caso de que su contenido hubiese sido incorrectamente bloqueado.

A primeras no se ve mal. Sin embargo, en la práctica esto significa implementar filtros que analicen todo el contenido de todos los usuarios de internet en Europa, y lo compare con una base de datos de contenidos protegidos, proporcionada por los representantes de los titulares de derecho de autor. Y visto así, se trata de una idea terrible.

Las razones son múltiples, desde el hecho de que contraviene el régimen imperante en donde los intermediarios no son responsables de los actos realizados por sus usuarios en internet, hasta la carga que implica el desarrollo e implementación de dichos filtros, particularmente para intermediarios pequeños y medianos. Pero el principal argumento en contra del artículo 13 es que, si ponemos a un algoritmo a cargo de decidir qué constituye infracción de derecho de autor, las máquinas la van a cagar. Y la van a cagar feo.

Como hemos mencionado innumerables veces en el pasado, el derecho de autor se trata, esencialmente, del justo balance entre los derechos de explotación económica que posee el titular de una obra, y los derechos de todo el resto de la comunidad para acceder al conocimiento y la cultura, expresarse y ser parte de la vida cultural de una región.

Se entiende así que existe un valor mayor, en torno a la proliferación de un ecosistema creativo, que se está nutriendo constantemente de los aportes y desarrollos realizados por los distintos miembros de la comunidad. En ese sentido, el derecho de autor constituye un incentivo a la producción de obras, pero no puede significar un impedimento o un freno para el desarrollo del conjunto, del bien común. Es por eso, por ejemplo, que las legislaciones de derecho de autor siempre reconocen la posibilidad de realizar algunos usos de ciertas obras sin necesidad de pedir autorización.

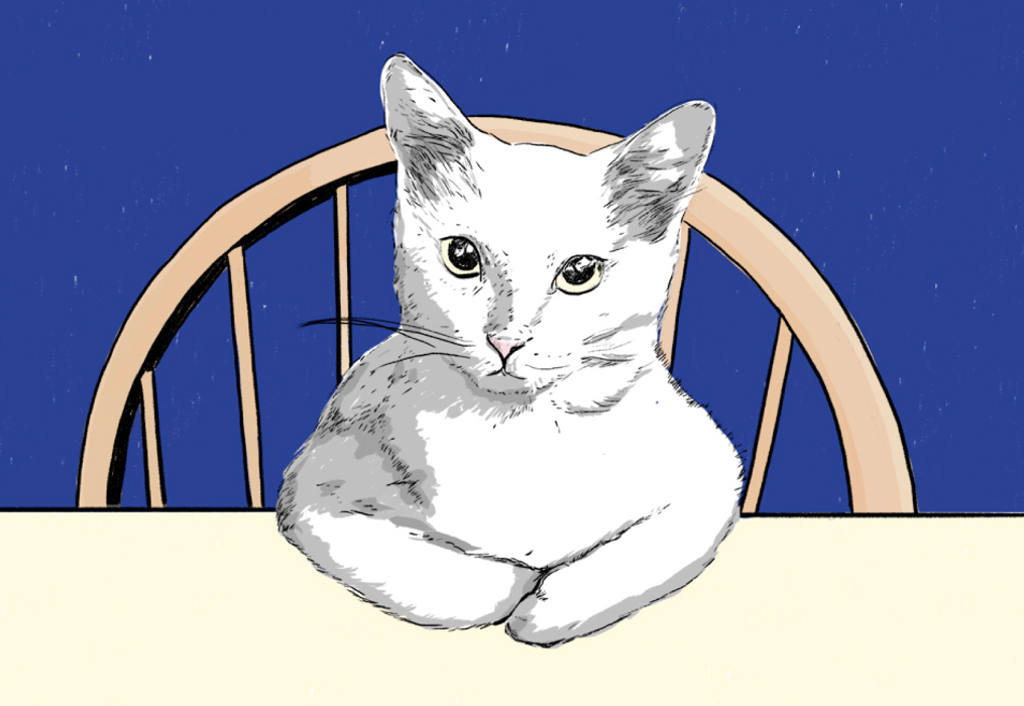

El problema es que si ponemos a una máquina a decidir qué constituye una excepción y cómo se diferencia de una infracción al derecho de autor, es muy probable que, en un número importante de casos, la máquina no sea capaz de responder fehacientemente. Es por ello que una de las principales banderas de lucha en contra del artículo 13 es que impedirá la proliferación de memes, pieza fundamental del actual internet. Normalmente el meme es creado como un uso transformativo de una obra previa, ya sea a modo de cita o parodia, que resignifica a la obra, dotándola de un nuevo significado, un sentido diferente, un valor de uso distinto, en el contexto de una comunicación carente de una explotación comercial directa. Todo esto, que es evidente cuando se analiza un meme, puede no serlo para una máquina, sobre todo en aquellos casos en que la lógica del meme requiere que la intervención de la imagen no sea extensiva. Las probabilidades de marcar usos justos, excepcionales o inocuos como infracción son altísimas, y lo que se arriesga es precisamente afectar la fertilidad creativa del ecosistema digital, el derecho a la libertad de expresión y a la participación en la vida cultural.

Más todavía, cuando la comparación debe ser hecha a partir de una lista de obras provista por los representantes de los titulares de derecho, las posibilidades de abusar el sistema son amplias. Basta que solamente una obra sea -genuina o maliciosamente- incluida por error en un listado de obras protegidas. Cosa que ya ha pasado en otras partes del mundo.

¿Pero el sistema estipula que deben existir criterios de proporcionalidad y mecanismos de protesta para reclamar decisiones incorrectas? Es cierto, pero, no se detalla cuáles deben ser esos criterios; y respecto a la posibilidad de apelar a una decisión, es muy probable que los reclamos sean relegados a un limbo del cual salir puede ser difícil, incluso perdiendo la ventana de relevancia que puede tener la publicación de algún contenido, por ejemplo en un contexto de protesta.

Todas estas aprehensiones vienen de casos de la vida real. Los abusos al filtro de derecho de autor de Google han sido ampliamente documentados; en América Latina, sabemos de al menos un caso en el cual el desbalanceado procedimiento de la plataforma de video fue utilizado para remover contenido con el fin de censurar contenido desfavorable al ex-presidente ecuatoriano, Rafael Correa, y, más recientemente, una publicación de la eurodiputada Julia Reda donde explicaba el peligro que encierra el artículo 13 fue (y sigue) sospechosamente bloqueado, a pesar de la reclamación de contenido legítimo. Lo ridícula de esta última situación debería ser suficiente para poner freno a una idea nefasta.

Pero luego la pregunta perdura: ¿se propone esta solución pues no se entiende cómo funciona la tecnología y se tiene la esperanza de que de verdad estos problemas puedan ser solucionados (lo que probablemente no va a ocurrir) o se confía en que el resto de la gente desconoce cómo funciona la tecnología para poder implementar un sistema que -se sabe- puede ser abusado en favor de quienes proponen una concepción maximalista del derecho de autor?

Como sea, lo cierto es que la sociedad civil se está movilizando. El próximo domingo 26 de agosto, distintas organizaciones basadas en Europa están llamando a una serie de manifestaciones públicas en todo el continente en contra del artículo 13 y la #CensorshipMachine. Les deseamos éxito y seguiremos pendientes de los siguientes pasos.