A mediados de septiembre de 2019, la prensa internacional reportaba “la mayor filtración en línea de información personal en la historia de Ecuador”, con los datos de la casi totalidad de la ciudadanía expuestos. Se trataba de 18 GB de datos distribuidos en múltiples archivos, que incluían nombres, información financiera y otra información personal de 20 millones de personas.

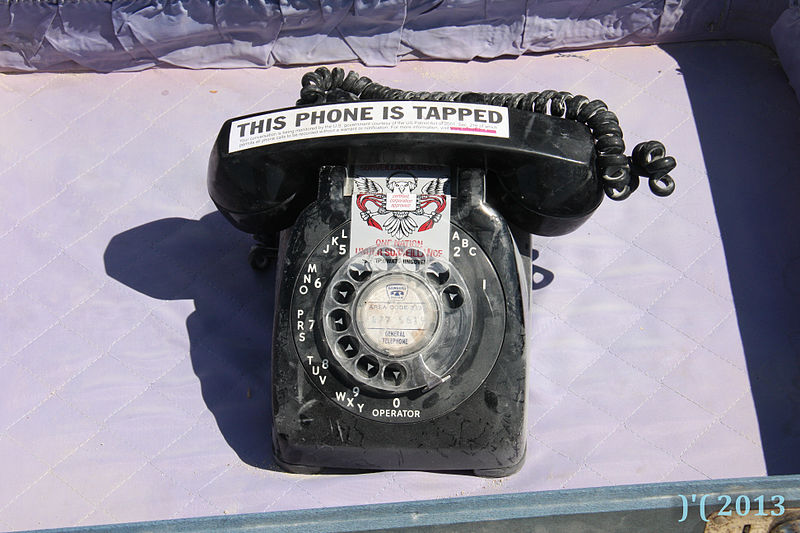

Al comienzo de la pandemia, la declaración de Estado de Emergencia en Ecuador dispuso que “[p]ara el cumplimiento de las restricciones del presente Decreto se podrán utilizar plataformas satelitales y de telefonía móvil para monitorear la ubicación de personas en estado de cuarentena sanitaria y/o aislamiento obligatorio, que incumplan las restricciones dispuestas, a fin de ponerlas a disposición de las autoridades judiciales y administrativas competentes”. La sociedad civil de la región reaccionó con preocupación a este anuncio, planteando que esta medida revistía gravedad en un contexto en que, a pesar de la garantía de la privacidad consagrada en la Constitución, el Ecuador carece de una normativa legal y de una autoridad técnica e independiente que permita una adecuada protección de datos personales conforme a estándares internacionales de derechos humanos.

Como vemos, Ecuador sufre de una paradoja: reconoce la protección de datos personales como derecho fundamental, basado en su Constitución, así como en tratados internacionales de derechos humanos que protegen la privacidad, pero carece de una estructura legal interna para garantizar dicha protección, lo que deja a ecuatorianas y ecuatorianos en la práctica en la indefensión, ante situaciones y medidas como las descritas.

En efecto, Ecuador es uno de los pocos países de América Latina que no cuenta con una Ley de Protección de Datos Personales, mientras otros países de la región lo hacen desde más de 20 años, o la han aprobado recientemente. Para remediarlo, el 19 de septiembre de 2019 el presidente de la República presentó ante la Asamblea Nacional el Proyecto de Ley Orgánica de Protección de Datos Personales.

La iniciativa ha concluido su primera revisión por la Comisión de Soberanía, Integración, Relaciones Internacionales y Seguridad Integral, la cual ha presentado un texto consolidado a consideración del pleno de la Asamblea Nacional.

El proyecto está actualmente en tabla para su discusión y es crucial que las ecuatorianas y ecuatorianos se mantengan atentos a este desarrollo legislativo y movilicen a sus representantes de todo el espectro político para asegurar que esta ley —esencial para la efectividad del ejercicio de los derechos fundamentales de la ciudadanía en el siglo XXI— sea aprobada.

Para entender la relevancia de esta moción para el Ecuador hoy, y por qué no puede seguir siendo postergada su discusión, es necesario comprender la transversalidad del objeto regulado por la ley de protección de datos personales. Este derecho no solo garantiza la autodeterminación informativa y la privacidad, si no que posibilita el libre ejercicio de otros derechos como la libertad de expresión, la no discriminación, la participación ciudadana, el derecho a reunión pacífica, el acceso al empleo, la salud, la educación, entre otros.

El objetivo de la ley general de protección de datos personales es establecer reglas para el desarrollo de actividades que involucren la recolección y procesamiento de datos, por parte de agentes públicos y privados. Así como prevenir injerencias arbitrarias en el normal desarrollo de la vida de los ciudadanos y ciudadanas, de donde sea que tales injerencias vengan.

En un mundo cada vez más tecnologizado, la protección de los datos personales es indispensable, en especial para grupos vulnerables o históricamente marginalizados, para prever que la utilización de tecnología basada en el uso de esos datos pueda amplificar y replicar la dicriminación tradicionalmente sufrida. Esto aplica a la hora de postular a un crédito bancario comercial, recibir beneficios sociales del Estado o entrar en relación con una aseguradora de salud.

Hoy, los datos personales —cualquier información referida a una persona identificada o identificable— se entregan en todas las interacciones sociales, ya sea con el aparato público o entes privados que operan en todos los ámbitos de la economía, el quehacer social y cultural.

Sin embargo, por esa misma frecuencia y cotidianidad con que los datos personales se tranzan, muchas veces se pierde de vista que son una puerta a nuestra vida y nuestra posibilidad de interacción social. Una regulación de protección de datos personales permite que como ciudadanas y ciudadanos podamos contar con herramientas concretas para exigir límites en el uso de la información. Ese control es esencial para garantizar nuestra libertad, autonomía y dignidad como personas, frente al Estado y las empresas, donde las desproporciones de poder y potenciales impactos en ejercicio de derechos resultan más evidentes.

Actividades tales como tomar una cita médica, comprar alimentos, visitar sitios web, realizar búsquedas en internet, monitorear nuestros hábitos de sueño con dispositivos inteligentes, entregar información para acceder de una wifi pública y caminar por calles que cuentan con cámaras de seguridad, se traducen en un rastro de datos personales que puede ser recolectado en forma constante y que permite analizar nuestros hábitos, nuestras relaciones personales, nuestros gustos y necesidades, nuestras preferencias personales o políticas. Conocer esa información otorga un poder único para tomar decisiones sobre nuestra vida: ya sea ocupar un determinado puesto de trabajo, acceder a una oportunidad de educación, ser atendido preferentemente o no en la sala de urgencias, obtener un crédito bancario, recibir un beneficio social, ser cuestionado o no por participar en una manifestación pública, etc.

Una ley de protección de datos personales es precisamente el instrumento a través del cual las sociedades democráticas, comprometidas con la protección y promoción de los derechos humanos, establecen un marco que permite delimitar aquello que puede ser legítimamente conocido, analizado y utilizado para tomar decisiones a través nuestro.

La digitalización y automatización del tratamiento de datos personales propia del siglo XXI solo vuelve más evidente el problema y la necesidad urgente de su regulación, por la mayor capacidad técnica de recoger, almacenar y analizar datos personales. Pero una ley de protección de datos personales permite proteger a las personas de todo tipo de uso de sus datos —automatizados, o no, digitales o físicos— y de donde sea que provengan las amenazas entes públicos o privados.

Es indispensable que la ley de protección de datos personales que actualmente se discute en el Ecuador contemple los derechos que componen el núcleo esencial del derecho a la autodeterminación informativa, de lo contrario tal protección será ilusoria. Para eso la ley debe referirse a qué información personal puede recogerse, cómo se autoriza esa recogida, para qué puede usarse, por cuánto tiempo, cómo se resguarda, etc. En materia de protección de datos personales estas preguntas se traducen en determinados derechos que componen el núcleo esencial del derecho a la autodeterminación informativa, los famosos derechos ARCO: acceso, rectificación, cancelación y oposición. También, en principios tales como el de juridicidad, lealtad, transparencia, finalidad, pertinencia y minimización de datos personales, proporcionalidad del tratamiento, confidencialidad, calidad y exactitud, conservación, seguridad de datos personales, responsabilidad proactiva y demostrada, aplicación favorable al titular, e independencia del control.

Aquellas personas interesadas en proteger la habilidad de empresas o del Estado de tener control sobre la vida de las y los ciudadanos, intentarán decirles que este debate excede la sofisticación tecnológica, o la realidad económica y social del Ecuador. Algunos de esos puntos fueron levantados durante el debate registrado en algunas de las mesas de trabajo abiertas por la Comisión de Soberanía, Integración, Relaciones Internacionales y Seguridad Integral.

Sin embargo, afirmaciones de ese tipo no se avienen a la realidad, en la cual las y los ecuatorianos a diario experimentan los impactos del uso de sus datos personales (Sí, estamos pensando en ese llamado que recibiste el otro día de una empresa que ni conocías, ni eres cliente, pero que de forma misteriosa sabía lo que necesitabas).

Aquí no se trata de copiar modelos foráneos o adoptar instituciones que son de naturaleza controversial en el sistema interamericano de derechos humanos —como puede ser el derecho al olvido—. Se trata de no perder la oportunidad de dotar al Ecuador de una regulación moderna, para que se actualice en cuanto a las necesidades de una economía digital al servicio de la ciudadanía y, de paso, acorte su rezago respecto de otras naciones de la región que cuentan con este tipo de regulación hace dos décadas. Como compartió la Unidad de Flujos Internacionales y Protección de Datos de la Comisión Europea en sus contribuciones durante la tramitación de la Ley Orgánica de Protección de Datos, esta debe ser concebida “para establecer un sistema moderno de protección con características propias de un régimen moderno de protección de datos”.

Al inicio del debate legislativo de Ley Orgánica de Protección de Datos, en conjunto con la Asociación para el Progreso de las Comunicaciones presentamos a la Comisión de Soberanía, Integración, Relaciones Internacionales y Seguridad Integral un documento que ahonda en aspectos que consideramos indispensables para una buena política de protección de datos personales en el Ecuador. No se trata de estándares inalcanzables, ni de quedar entrampados en tecnicismos. Ecuador necesita definiciones claras respecto a lo que constituye un dato personal y un dato sensible (de manera no taxativa) y establecer niveles de protección acorde; principios vinculantes que hagan eco de la experiencia internacional —porque está demostrado que funcionan— y permitan orientar el régimen de protección de datos personales; una lista de derechos vinculantes de los titulares de los datos para garantizar que tengan control sobre su información personal; establecer obligaciones de los responsables de bases de datos, señalando con precisión a los sujetos obligados y los estándares de cumplimiento, en particular la seguridad; establecer un régimen sancionatorio de multas que sean disuasivas. Además, la creación de una autoridad de control que tenga la independencia necesaria y los mecanismos apropiados para garantizar la aplicación de la ley a todo ente público o privado.

Las excepciones al ámbito de aplicación de la ley y al consentimiento deben ser limitadas a casos excepcionales y establecidos con claridad. Para fortalecer las oportunidades de comercio del Ecuador con el exterior, la ley debe considerar la protección a los flujos transfronterizos de los datos, mediante mecanismos sometidos a una supervisión estricta y transparente, e incluir medidas de reparación para garantizar que los derechos de los usuarios viajen junto con sus datos. Los aspectos descritos en estos últimos dos párrafos son esenciales si se quiere garantizar la protección de los datos personales y, con ello, cumplir el estándar exigido por la Unión Europea para declarar a Ecuador un país adecuado en materia de protección de datos personales, cuya protección se ha transformado en el estándar global y cuyo cumplimiento es cuestión indispensable para el comercio digital.

Limitar la aplicación de la ley al flujo transfronterizo de datos o solo al contexto de relaciones comerciales y de consumo, o flexibilizar las normas sobre intercambio de datos personales bajo la excusa de que una ley proteccionista de los derechos de las personas significaría una traba para el desarrollo comercial del país, son falsos dilemas con los que algunos participantes del debate legislativo han intentado convencer a la Asamblea Nacional. Sin embargo, retrasar la discusión no deja ni los intereses económicos del Ecuador, ni el ejercicio de los derechos de su ciudadanía en mejor posición: solo mantiene en el rezago de alcanzar los beneficios de hacer exigibles sus derechos.

La atención de la ciudadanía al debate de la Ley Orgánica de Protección de Datos que se estará produciendo en la Asamblea Nacional en las próximas semanas es esencial para que sus representantes entiendan la necesidad de que se apruebe una legislación adecuada, que permita la plena protección de los derechos de las y los ecuatorianos: el momento es ahora.