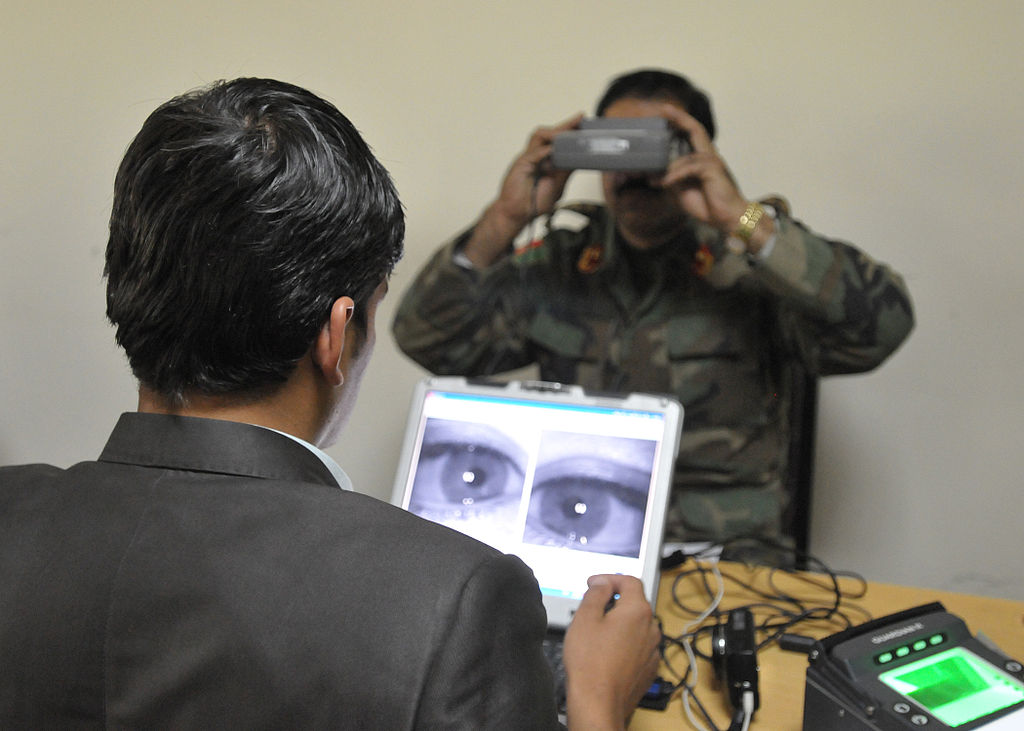

En el Grupo de Trabajo de Ingeniería de Internet (o IETF por sus siglas en inglés) actualmente se discuten asuntos tan relevantes para los derechos humanos como la privacidad en el sistema de nombres de dominio (DNS) o la asignación aleatoria y cambiante de direcciones MAC (Media Access Control) de los dispositivos conectados, para proteger la identidad de las personas usuarias, entre otros.

Hace unos años empezamos a conocer y participar de este espacio, contribuyendo primero en el desarrollo de un documento sobre libertad de asociación en internet, y luego en otro sobre feminismo y protocolos. Y como señalábamos desde un comienzo, a pesar de ser una organización abierta, que funciona de manera horizontal y colaborativa, donde la participación es libre y se hace a título personal, y donde se busca alcanzar consensos manteniendo un ambiente de trabajo respetuoso e inclusivo, todavía encontramos muchas dificultades para compartir nuestras preocupaciones y necesidades, e incluso para vincularnos a los debates y procesos.

Sin embargo insistimos en participar, pues consideramos necesario fortalecer la gobernanza de la infraestructura, contribuyendo en espacios donde se toman decisiones técnicas. Y es que en la IETF se están buscando soluciones para problemas técnicos inmediatos, pero también se busca analizar cómo evolucionan los protocolos técnicos, para pensar las posibilidades del futuro de internet. Las discusiones allí son técnicas pero también son profundamente políticas; por ejemplo, cómo el fortalecimiento de la privacidad en ciertas tecnologías puede redundar en mayor centralización del mercado o cómo sistemas más complejos de cifrado pueden debilitar el anonimato de las personas usuarias.

Durante este tiempo nos hemos interesado en conocer y entender las distintas barreras de participación en este espacio, con el fin de buscar estrategias para reducirlas. Existe un borrador sobre diversidad e inclusión que ofrece una lista, pero aquí intentaremos señalar algunas. La primera y más evidente es el costo de participación, pues la IETF acostumbra reunirse tres veces al año, en Norteamérica, Europa y Asia respectivamente, y porque la inscripción al evento tiene un costo que puede ser alto incluso en dichas regiones. Aunque desde antes existía la posibilidad de participar de manera remota y sin costo, durante la pandemia por COVID-19 se mejoraron enormemente las posibilidades técnicas de participación remota, y se han venido estableciendo reglas para garantizar que las reuniones totalmente en línea sean no solo funcionales sino accesibles y satisfactorias.

Pero aún participando remotamente y sin costo, resulta muy complicado vincularse a las discusiones que tienen lugar en las listas de correo y en los distintos grupos de trabajo. Para quienes trabajamos en la intersección entre derechos humanos y tecnología, por ejemplo, puede ser útil conocer “Cómo funciona realmente internet” y que si bien ante cualquier conflicto IETF busca “favorecer a las personas usuarias finales”, en términos generales “los usuarios” de las tecnologías desarrolladas aquí son los operadores de redes y las empresas proveedoras de internet. También es útil conocer el “Tao. Guía para principiantes”, un documento explicativo sobre la estructura y procesos dentro de IETF que está traducido en siete lenguas, incluyendo el español.

La lengua es una barrera que se extiende a todo el campo de las tecnologías de internet, pues las computadoras y la industria funcionan principalmente en inglés. Y específicamente en IETF, cualquier persona que quiera participar activamente de las discusiones abiertas debe no solo entender sino desenvolverse cómodamente en inglés. Por suerte hay personas dentro de la comunidad técnica en América Latina interesadas en traducir y contextualizar algunos asuntos relevantes, por ejemplo “Cómo leer un RFC” o el “Estado actual de los protocolos de seguridad de la IoT”. Pero falta mucho por analizar, discutir y contribuir desde nuestra región.

Hace un tiempo estuvimos en el programa IT-Women de Lacnic conversando al respecto y señalamos que, gracias a los datos existentes, es posible establecer que la participación desde regiones como América Latina o África, así como la participación general de mujeres, es muy marginal. Esto se evidencia en el reporte de la coordinación de IETF presentado en su más reciente plenaria, donde mostró que la participación sigue siendo predominantemente de Estados Unidos (38,9%), seguida de China (9,7%), Alemania (7,2%), Reino Unido (4,8%), Japón (3,9%), Canadá (3,6%), India (3,4%) y Francia (2,9%), y no se conocen datos desagregados por género, por ejemplo.

Estos datos no contradicen, sino que confirman, la brecha estructural de participación en entornos tecnológicos. Sin embargo, consideramos importante preguntarnos cuáles son los datos disponibles para construir estas estadísticas, ¿son suficientes? Frente a esta pregunta, desde hace tiempo hay una comunidad involucrada en los debates sobre protocolos y derechos humanos, trabajando en Big-Bang, una herramienta para el análisis de comunidades que desarrollan estándares y participan de la gobernanza de internet, a través del análisis estadístico, discursivo y de redes en las listas de correo. Este tipo de herramientas pueden servir para entender mejor quiénes y cómo están participando de las discusiones en IETF.

Pero, ¿de qué depende que esta situación cambie? Sabemos que en los entornos de diseño, producción y consumo de tecnologías digitales se manifiestan y re actualizan los problemas sociales estructurales, y que no es suficiente con transformar las tecnologías para transformar la sociedad. Sin embargo, también consideramos que traer otros casos de uso a la discusión, así como otras maneras de discutir y otros intereses (más allá de la estabilidad del mercado o la seguridad nacional, por ejemplo), es necesario para encaminarnos hacia una internet centrada en las personas y en nuestros derechos individuales y colectivos.

Incluso en América Latina, hace falta mucha reflexión sobre derechos humanos dentro las comunidades técnicas y entre las empresas operadoras y proveedoras de internet, como comentamos hace poco en el marco del Workshop PreIETF organizado por la Sociedad Brasilera de Computación. Creemos, sin embargo, que hay varios espacios donde se puede conocer e incidir en estos temas: el Public Interest Technology Group publica mensualmente un boletín (en inglés) con temas relevantes en materia de derechos humanos y protocolos; Lacnic cuenta con un programa cíclico de mentoreo IT Women (cuya inscripción cierra hoy 12 de novimebre); y está la lista de interés IETF-Lac donde es posible conversar sobre diversos temas de IETF, tanto en español como respecto a sus implicaciones en América Latina. Además, dentro de IETF está el Education, Mentoring and Outreach Directorate, que busca promover la diversidad e inclusión en la organización, y también está Systers, una lista de interés para mujeres que participan de IETF.

Desde Derechos Digitales seguiremos publicando al respecto, y estamos abiertas a contribuir con otras personas y organizaciones en la región interesadas en vincularse a esta discusión.