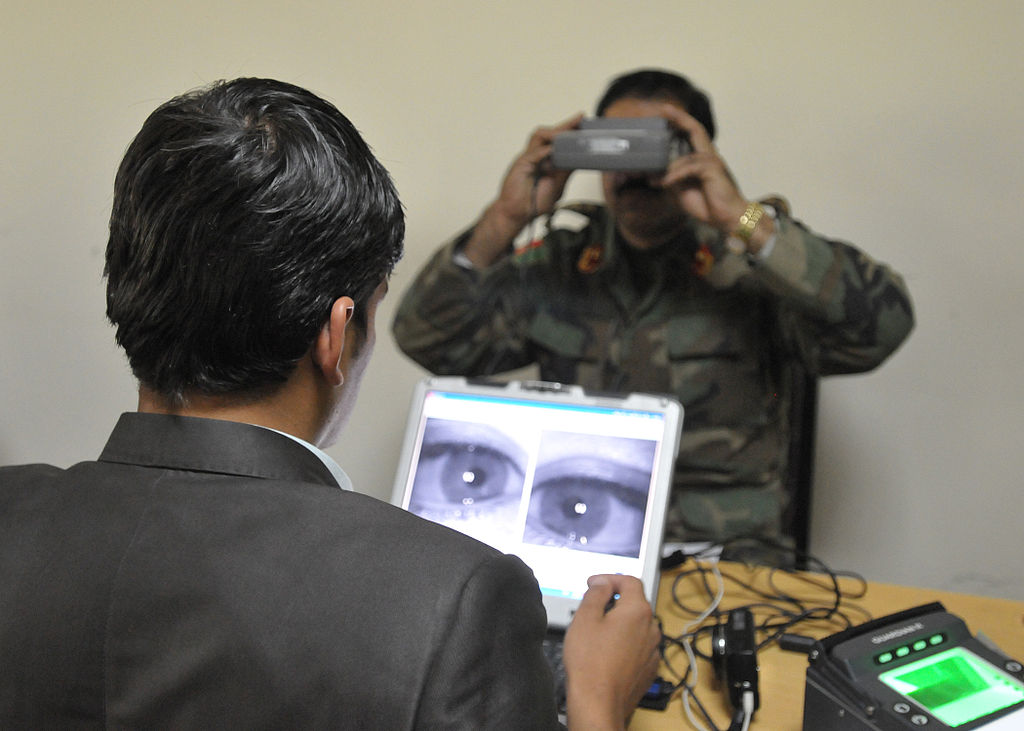

No hay dudas de que estamos ante un crecimiento exponencial en el uso de tecnologías automatizadas de reconocimiento facial en América Latina. El abaratamiento de la tecnología, junto con la expansión de los fines utilizados ha incrementado los casos de su uso por parte de Estados y empresas.

Sin embargo, la tecnología ha sido ampliamente cuestionada por organismos internacionales y por la sociedad, ya sea a través de manifiestos, protestas e incluso demandas. Por ejemplo, en algunas ciudades de los Estados Unidos se decidió prohibir el uso de reconocimiento facial, ya que no existen garantías para el respeto de derechos humanos.

En el caso de los Estados, ciudades como Salvador, São Paulo, Río de Janeiro, Lima, Nueva York, Londres y Buenos Aires han adoptado este tipo de sistemas para monitorear la población en diferentes lugares, alegando fines de seguridad pública.

Esta semana surgió un prometedor avance regulatorio en la ciudad de Buenos Aires, Argentina.

Críticas y acciones contra el sistema de reconocimiento Facial en la Ciudad de Buenos Aires

El “Sistema de Reconocimiento Facial de Prófugos” (SRFP) consiste en 300 cámaras de vigilancia en las calles y estaciones de metro, siempre siguiendo la línea que más tecnología aumentaría la seguridad y cuidaría a las personas. A pesar de las severas críticas, tomó 22 días la implementación del sistema.

El relator especial de Naciones Unidas sobre el Derecho a la Privacidad, criticó la falta de evaluación previa a su implementación y proporcionalidad de las medidas. Además, mostró preocupación respecto a la base de datos que alimenta la SRFP (Sistema de Consulta de Rebeldías y Capturas-CONARC), ya que fue realizada una inserción desproporcionada en la base de datos, divulgación indebida de datos, falta de información sobre qué delitos se imputan, errores y fallas y falta de actualización.

Respecto al caso específico, la ONG Human Rights Watch fue enfática sobre la existencia de graves daños a los derechos de la niñez y la adolescencia, ya que al analizar la base de datos se encontraron al menos 166 menores, incluidos niños sospechosos de haber cometido delitos de menor potencial ofensivo.

Acciones jurídicas impulsadas desde sociedad civil

Como si las críticas no fueran suficientes, el sistema fue impugnado por al menos dos juicios. Una demanda, presentada por la organización Asociación por los Derechos Civiles (ADC), solicita ante el Tribunal Superior de Justicia porteño que declare inconstitucionales los cambios legales. El otro, propuesto por el Observatorio de Derecho Informático Argentino (ODIA) pide un juicio de amparo en primer grado de competencia, que requiere el análisis del sistema a través de la constitucionalidad y convencionalidad, además de las medidas cautelares para suspender su uso.

El pasado 13 de octubre, Derechos Digitales fue admitida como amicus curiae en la demanda propuesta por ODIA. Se amplió la participación social en el caso, recibiendo también aportes de otras organizaciones, como Access Now y Asociación Trabajadores del Estado (ATE), además de la adhesión y participación de los ciudadanos como autores de la demanda.

Reflexiones sobre el caso Ciudad de Buenos Aires

Este proceso muestra claramente tres cuestiones centrales, que se reproducen de la misma manera otros países. El primero, es un tema técnico con implicancias sociales relevantes en cuanto al uso de la inteligencia artificial y lo que esto significa para la ciudadanía. El segundo tema, se relaciona con la democracia en sí y la transparencia del sistema. El tercer tema es el respeto a los derechos humanos.

Al principio, la cuestión de la velocidad con la que se desarrolló y entregó el proyecto es impresionante. Solo pasaron 22 días desde el lanzamiento del proyecto hasta su implementación, una velocidad que sería “envidiable e incluso sospechosa”, según ODIA.

1. Implicancias sociales: falsos positivos y la discriminación

Sin embargo, la cuestión técnica que tiene las mayores implicaciones sociales se refiere a la precisión y calidad de la base de datos utilizada. Los estudios más variados demuestran una menor tasa de aciertos en personas de piel oscura y mujeres.

El estudio “Gender Shades”, por ejemplo, demuestra que las tasas de error son diferentes según el grupo analizado, alcanzando más del 90% de identificación incorrecta para personas de piel oscura. Y menos del 1% de error para personas de piel más clara. Si bien puede ser un fallo en la calibración de los datos, ya sea por el uso de bases de datos sesgadas o por otros motivos, lo cierto es que hay que analizar si este tipo de tecnología incide desproporcionadamente en la garantía de igualdad a las personas tradicionalmente discriminadas y más vulnerables, como pueblos originarios, mujeres, niños, ancianos y personas trans.

2. Democracia y transparencia

En cuanto al tema de la democracia y la transparencia, parece que hay poco o ningún debate en el legislativo sobre la implementación de este tipo de sistema. Asimismo, en muchos casos existe una gran opacidad en cuanto al uso de la tecnología, bajo el argumento que el tema no debe ser debatido, que “es demasiado técnico” para una amplia participación social y que la transparencia no sería necesaria.

En el caso de Buenos Aires, tanto la ADC como el ODIA, plantearon importantes y extensas preguntas sobre la creación, contratación, uso y salvaguardas del sistema de reconocimiento facial. Obtuvieron poca o ninguna respuesta. Si bien las investigaciones muestran que la tecnología “generalmente se crea en el exterior y se utiliza en casa”, existe una falta de transparencia sobre cuáles son las empresas responsables de la implementación de la tecnología, especialmente, en los procesos de definición de la contratación.

3. Vigilancia y derechos humanos

Finalmente, el tema de los derechos humanos involucrado en la aplicación de tecnología de vigilancia masiva. Desde 2013, luego del caso Snowden, Brasil y Alemania propusieron una resolución a la Asamblea General de la ONU, sobre “El derecho a la privacidad en la era digital”.

Con la actualización de la citada resolución en octubre de 2021, se dio mayor robustez a las cuestiones sobre el uso de datos biométricos, con el reconocimiento expreso que los usos de la inteligencia artificial (IA) pueden suponer graves riesgos para el derecho a la privacidad, citando como ejemplo, el empleo de IA para identificación, reconocimiento facial, seguimiento, elaboración de perfiles, predicción de comportamiento y puntuación de personas.

La conclusión de la asamblea de la ONU es que los Estados deben garantizar que las tecnologías de identificación y reconocimiento biométrico —incluidas las tecnologías de reconocimiento facial por parte de actores públicos y privados— no permitan la vigilancia arbitraria o ilegal, incluidos quienes ejercen su derecho a la libertad de reunión pacífica.