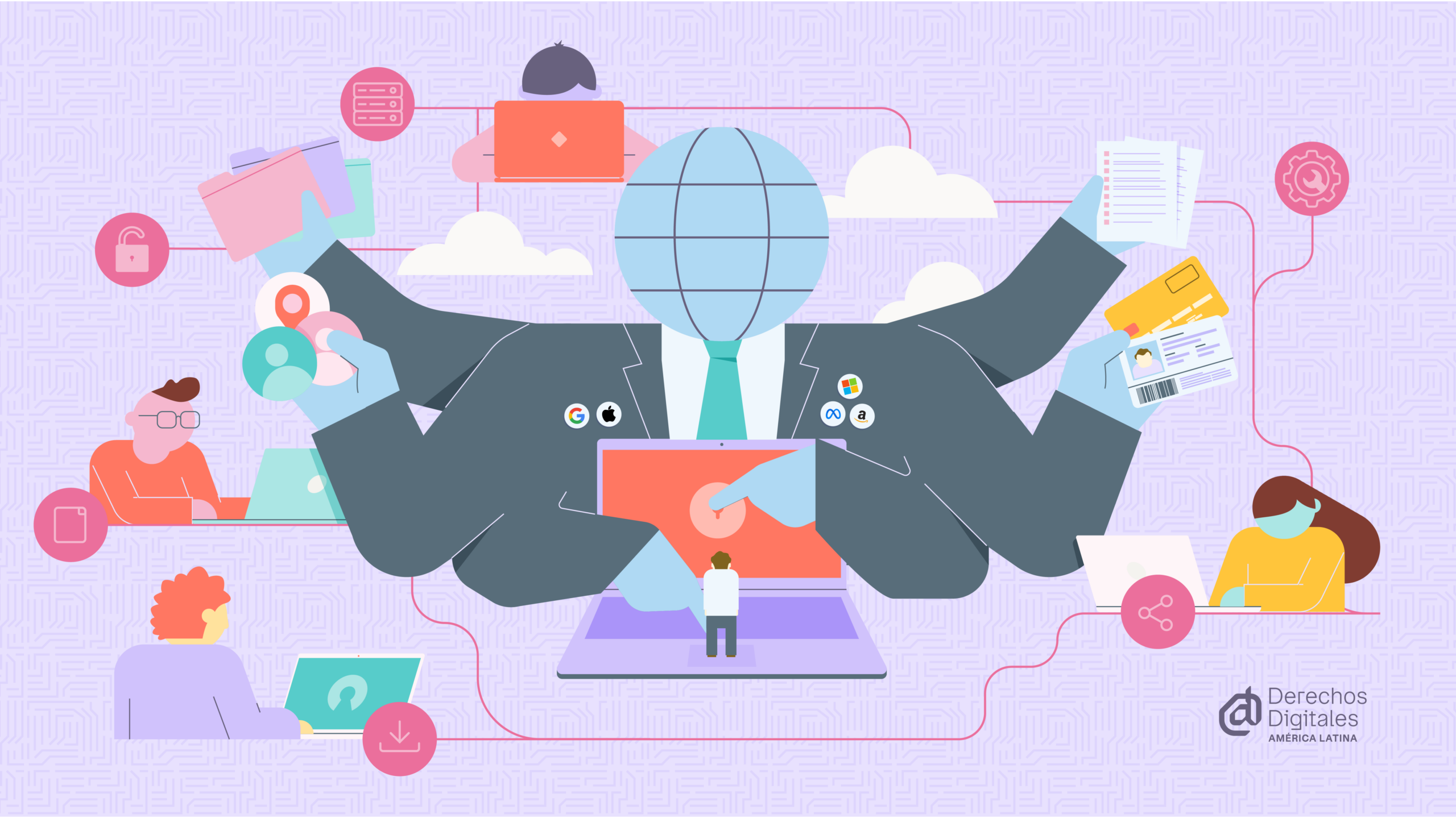

Durante el último tiempo, Palantir se empezó a escuchar más fuerte en nuestra región. Su nombre está inspirado en las piedras palantíri, presentes en “El Señor de los Anillos”, que permitían ver aquello que sucedía en otros reinos. Los orígenes se remontan al año 2004, cuando la empresa fue creada en medio de la paranoia tras los ataques del 11 de septiembre de 2001. Su objetivo era analizar datos de distintas fuentes para generar inteligencia que permita identificar posibles atentados terroristas antes de que sucedan, mediante el cruce de información de distintas fuentes de datos.

Desde sus inicios, Palantir fue cercana al gobierno de EE. UU. y sus agencias de inteligencia. Uno de sus primeros financistas fue In-Q-Tel, fondo creado por la CIA para el desarrollo de tecnología de seguridad, que aportó dos millones de dólares para la compañía. El FBI, ICE y la NSA son algunos de los organismos norteamericanos más importantes que vienen siendo clientes de la compañía. En el caso de la NSA, Palantir ayudó a mejorar el sistema secreto de análisis de información XKEYSCORE, conocido públicamente gracias a las revelaciones de Snowden.

Palantir también fue utilizada por ICE como herramienta para deportar migrantes como lo documentamos recientemente en una columna. La herramienta ELITE es un sistema que funciona como un “Google Maps de personas deportables”: muestra en un mapa la ubicación probable de cada objetivo con una puntuación de probabilidad para deportación. Esta puntuación se calcula cruzando datos como direcciones en Medicaid, registros de GPS y capturas de cámaras de videovigilancia. Además, genera expedientes automáticos con antecedentes penales y órdenes judiciales. En 2025, el ICE invirtió USD 30 millones para expandir ELITE y crear ImmigrationOS, una plataforma que rastrea a las personas desde su entrada al país hasta su deportación, en tiempo real. El sistema reduce a las personas a casos con fechas estimadas de salida, sin posibilidad de réplica o defensa.

Como si fuera poco, esta compañía también viene teniendo una participación importante en escenarios de guerras. Entre sus productos se encuentran Gotham y Maven. Maven permite tomar decisiones con la ayuda de inteligencia artificial para definir blancos en una guerra de manera rápida y precisa. Se sabe que fue utilizado en el conflicto bélico de Medio Oriente y ayudó a identificar objetivos en el primer día de ataque de EE. UU. a Irán. Dentro de los posibles objetivos estuvo una escuela donde murieron 168 personas que incluyen a 110 niños y niñas. Un error en un sistema informático de banca puede dejar a gente sin dinero, un error en un sistema para la guerra puede terminar con la vida de personas civiles.

¿Quién está detrás de Palantir?

Vale la pena preguntarse quién está detrás de esta empresa, y quién se beneficia de un mercado tan expandido para sus capacidades. Dos de sus fundadores son personajes polémicos que también forman parte de las noticias del último tiempo en nuestra región: Peter Thiel y Alex Karp. El primero es presidente de la junta directiva de Palantir y el segundo es su CEO.

Peter Thiel es uno de los fundadores de Paypal junto a figuras como Elon Musk. En el año 2002 la empresa fue vendida a Ebay por USD 1500 millones, y con estos recursos empezó a financiar startups tecnológicos como LinkedIn y Yelp, entre otros. Thiel fue uno de los primeros inversores de Facebook y Mark Zuckerberg lo consideró su mentor.

Más allá de ser un empresario exitoso, también tiene posiciones políticas controvertidas. El Washington Post accedió a audios filtrados de un seminario que Thiel dictó en San Francisco titulado “El Anticristo: Una serie de conferencias en cuatro partes”, entre septiembre y octubre de 2025. Las charlas fueron organizadas por ACTS 17 Collective, una organización dedicada a predicar el cristianismo dentro de la industria de la tecnología. En sus charlas, Thiel afirma que el Anticristo aparecerá en forma de gente que se oponga al avance de la tecnología o defienda al medio ambiente. Llegó a mencionar a Greta Thunberg, defensora ambientalista, y a Eliezer Yudkowsky, investigador sobre IA y seguridad, como posibles personificaciones del Anticristo.

En 2009, Thiel publicó el ensayo “La Educación de un Libertario”, en el que argumenta que la libertad individual y la democracia son incompatibles, ya que esta última tiende a limitar derechos a través de la voluntad de la mayoría. Propone que los libertarios prioricen la innovación tecnológica y el mercado sobre la política tradicional, que considera ineficiente. Señala que la expansión del voto femenino y el Estado de bienestar en el siglo XX contribuyeron al crecimiento de formas de gobierno que erosionaron la autonomía individual. Destacó a Facebook como ejemplo de cómo la tecnología puede crear nuevas comunidades y formas de disidencia más allá de los Estados-Nación. Adicionalmente, en el ensayo afirma que el ciberespacio, las colonias marinas flotantes o el espacio exterior son lugares donde se podría recuperar la libertad individual sin depender de la política democrática.

Por otro lado está Karp, que en 2025 publicó el libro “La república tecnológica: Poder duro, pensamiento débil y el futuro de Occidente” junto a su compañero de Palantir Nicholas W. Zamiska. En abril de 2026 la cuenta de Palantir en X publicó un manifiesto de 22 puntos que resume el contenido del libro. Un análisis de este manifiesto podría ocupar una columna completa, pero se destacan algunos puntos: el uso del software como herramientas para la guerra y la supremacía de los EE. UU. sobre otros países; el deber de apoyo de las empresas de tecnología al ejército norteamericano (“si el Ejército necesita un rifle, debemos crear el mejor”); la visión positiva del uso de armas potenciadas por IA para la guerra, entre otros.

Pero Karp no es polémico solamente por este libro y el manifiesto. En una entrevista con CNBC afirmó: “A mis amigos en la comunidad tecnológica: nadie en el mundo nos toleraría a nosotros y todo lo que hacemos si América [Estados Unidos] no tuviera el ejército más poderoso del mundo. Por lo tanto, apoyar al ejército no es solo una opción, es una obligación para aquellos que se benefician de nuestro sistema.” En una junta con financistas sostuvo: “Palantir está aquí para perturbar y hacer que las instituciones con las que trabajamos sean las mejores del mundo. Y, cuando sea necesario, asustar a nuestros enemigos y, en ocasiones, matarlos.”

Su expansión en América Latina

En enero de 2025, el presidente de Ecuador anunció su plan de transformación digital con la colaboración de empresas como Google, Healthbird y Palantir. En mayo de ese año, el gobierno formalizó la colaboración con Palantir para combatir el fraude aduanero. En ese momento, el presidente expresó: “La seguridad no se defiende solo con fuerza, también se defiende con inteligencia y el desarrollo de nuevas tecnologías”.

Karp y Noboa se reunieron en el foro de Davos en enero de 2026 donde anunciaron que la empresa abrirá oficinas en Ecuador, las primeras en América Latina. La colaboración con el gobierno ahora se extiende al combate a la minería y pesca ilegal y a la prevención de fraudes en préstamos del sector público. Si bien es pública la colaboración entre el gobierno y Palantir, no se conoce el contenido de los contratos que formalizan las mismas.

El pasado abril, Peter Thiel llegó a Argentina, donde compró una mansión histórica en el exclusivo barrio de Palermo Chico por aproximadamente USD 12 millones. Al momento de redactar esta columna, Thiel sigue en el país. Durante la visita se reunió a puerta cerrada con el presidente Javier Milei en la Casa Rosada y con otros integrantes del gabinete, entre los que se incluye a Santiago Caputo, quien conserva el control de la Secretaría de Inteligencia del Estado (SIDE).

Thiel hizo de Buenos Aires su centro de operaciones para el Cono Sur. El 13 de mayo viajó a Asunción donde se reunió con el presidente de Paraguay Santiago Peña. También viajó a Santiago de Chile a fines de abril y principios de mayo, donde sostuvo encuentros con figuras libertarias y neoliberales como Johannes Kaiser y José Piñera.

No se sabe cuánto Thiel viene hablando de Palantir y el uso de sus herramientas en los Estados del Cono Sur, sus intereses van más allá y está entusiasmado en invertir en actividades como minería y energía. Se especula que Thiel encuentra en la Argentina de Milei ese lugar donde pueda crear su “utopía” tecnológica, sin la necesidad de viajar al espacio o fundar colonias marinas.

La soberanía digital latinoamericana en riesgo

Palantir es una de las empresas con capacidad de análisis de datos e inteligencia artificial más poderosas del mundo. Sin controles democráticos, institucionales y técnicos adecuados, tanto sobre los gobiernos como sobre la propia empresa, existe el riesgo de que esta tecnología se convierta en una herramienta de vigilancia masiva que derive en regímenes autoritarios. Cabe preguntarse ¿qué habrían hecho dictadores como Videla o Pinochet con una capacidad de vigilancia y análisis predictivo como la que ofrece Palantir hoy?

En este contexto, preocupa que el gobierno de Ecuador haya aprobado una Ley Orgánica de Inteligencia en 2025, varios de cuyos artículos clave fueron suspendidos provisionalmente por la Corte Constitucional por posibles inconstitucionalidades. De igual forma y preocupante, Argentina modificó recientemente, vía decreto, su Ley de Inteligencia, ampliando los poderes de la SIDE.

Que los Estados de América Latina adopten nuevas tecnologías de vigilancia masiva es alarmante, sobre todo si recordamos las sangrientas dictaduras que vivió nuestra región. Hacerlo de la mano de una empresa como Palantir, con esta visión del mundo de sus fundadores, implica un riesgo adicional: que los países terminen siendo vigilados directamente por la empresa, perdiendo así su soberanía. Volviendo a Tolkien, Palantir actuaría como la “Piedra de Osgiliath”, la piedra palantíri que era capaz de espiar a las demás.

En “La República Tecnológica”, Alex Karp enfatiza en la importancia de defender los valores de Occidente mediante el ejercicio de la fuerza y la superioridad tecnológica y militar, con EE. UU. a la cabeza. Para Karp, Palantir y las empresas de tecnología son herramientas de poder que permiten fortalecer la supremacía norteamericana sobre otros países. Esperemos que nuestros gobiernos respeten la autodeterminación de sus pueblos y no sigan entregando nuestra soberanía para profundizar, cada vez más, la famosa idea del patio trasero de EE. UU.