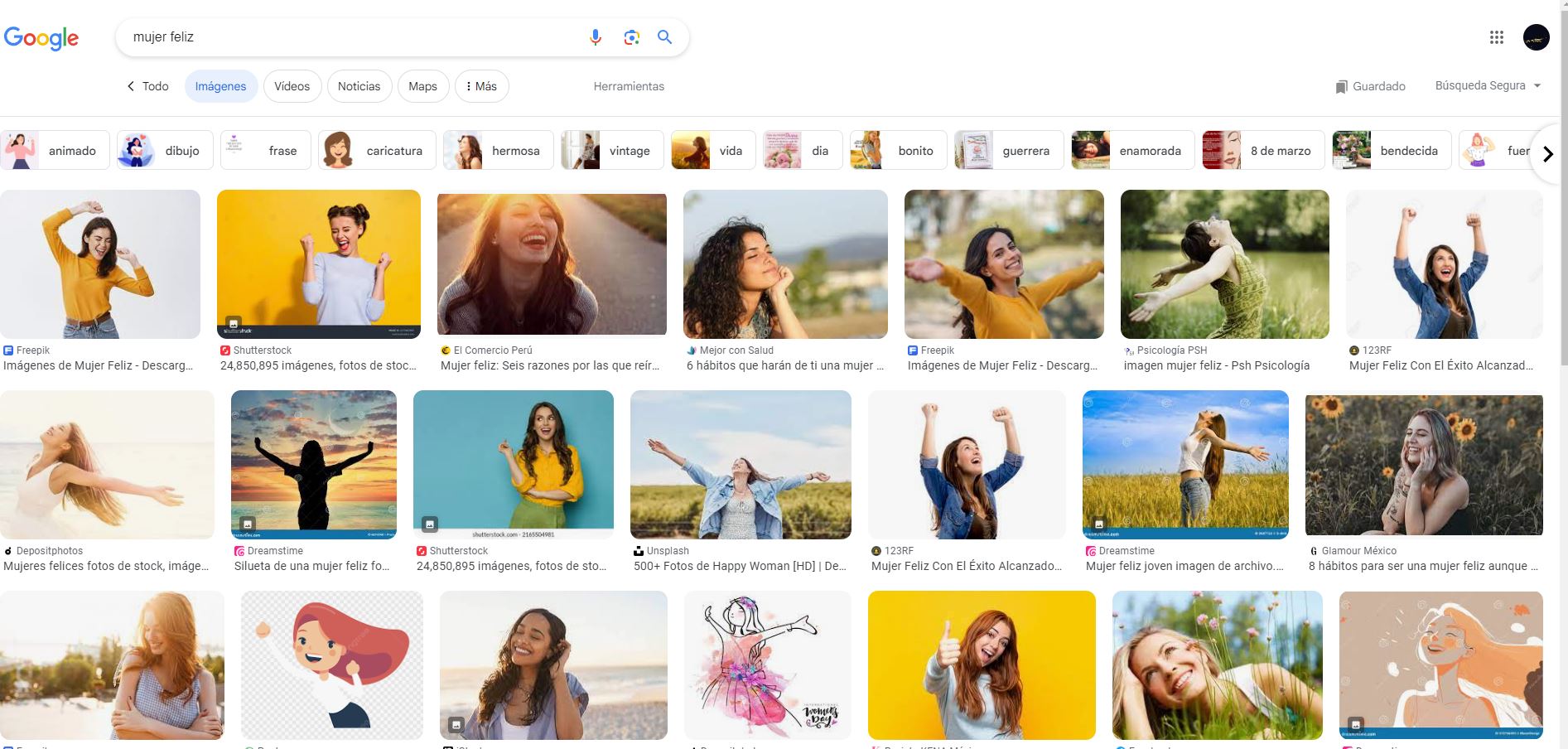

Nos acercamos al 8M, Día Internacional de la Mujer, cuando conmemoramos la lucha por nuestros derechos desde diversos frentes. Nuestro activismo se ha construido de la mano de las madres buscadoras de personas desaparecidas, de las mujeres trans que pelean por sus derechos, de la lucha de las mujeres indígenas por sus territorios, de la defensa de las mujeres negras por el reconocimiento de sus derechos, de los esfuerzos de organizaciones feministas para promover el aborto legal, entre muchas otras. A lo largo de la historia, estos procesos han logrado ganar garantías para los derechos de las mujeres, pero aún queda mucho por hacer, especialmente en países donde los discursos y las acciones de los gobiernos van en contra de cualquier avance en materia de igualdad de derechos.

Contextos políticos amenazantes, activismos vivos

La justicia en los países latinoamericanos está lejos de ser dignificadora para las mujeres, pues el camino para acceder a ella es más que complejo y la mayoría de las veces nunca llega. Esta histórica falta de justicia se refleja también en el entorno digital, donde la tecnología facilita otras formas de violencia de género. A fines del 2024, México nos recordó la incapacidad de un sistema para comprender de forma integral la violencia de género facilitada por las tecnologías (TFGBV, por sus siglas en inglés), al absolver al estudiante que realizó deepfakes de sus compañeras con inteligencia artificial, caso que comentamos previamente. Esto sucedió incluso teniendo un marco jurídico como la Ley Olimpia, que poco importó cuando el tribunal tomó la decisión.

Situaciones como esta evidencian la fragilidad de los marcos jurídicos en países donde existen normativas específicas, además de generar desesperanza en otros países donde no se cuenta con legislaciones para atender la TFGBV. El panorama se agrava allí donde los gobiernos se han tornado más agresivos ante las narrativas de igualdad y perspectiva de género. Sin embargo, cuando los entornos políticos se han vuelto tan amenazantes, violentos y opacos, la respuesta social ha sido el activismo, la protesta y la generación de información. Existen varios ejemplos de ello en América Latina, pero decidimos abordar tres casos principales en donde los conflictos internos en los países han tenido impactos graves en el ejercicio de los derechos de las mujeres: Venezuela, El Salvador y Nicaragua.

Ciudadanas, periodistas, activistas, personas de la comunidad LGBTIQA+, entre muchas otras mujeres, son afectadas por las acciones de quienes deberían trabajar por garantizar su bienestar: sus propios gobiernos. La persecución y la criminalización del disenso se han convertido en herramientas de opresión estatal, con un impacto diferenciado en mujeres atravesadas por distintas interseccionalidades.

En el marco de las elecciones presidenciales de Venezuela en 2024, la ciudadanía vivió graves represiones por parte del Estado, que encarceló a aproximadamente 2000 personas por protestar, algunas de ellas por criticar al gobierno a través de redes sociales, por difundir fotografías sobre las manifestaciones en plataformas digitales o por compartir información a través de servicios de mensajería. La activista venezolana Martha Tineo reconoció que si bien la persecución política no está direccionada en contra de las mujeres, sí existen efectos diferenciados para ellas. Las mujeres encarceladas viven en hacinamiento y en centros de detención no adecuados a sus necesidades, incluso sin recursos básicos como el agua, lo que ha conllevado a una situación precaria de salud e higiene menstrual. Asimismo, la defensora de derechos humanos declaró que hay efectos psicológicos en las mujeres por la separación de sus hijos e hijas, y que de igual manera reciben amenazas de persecución a otros integrantes de sus familias.

Mientras tanto, en El Salvador las mujeres han tenido protagonismo en la defensa de derechos, lo que las ha puesto en riesgo de persecución, acoso y estigmatización. Encontramos así que se han sumado cada vez más mujeres activistas que buscan hacer justicia por sus familiares detenidos de forma arbitraria en el régimen de excepción, que además de asumir riesgos para ellas, implica una carga de trabajo adicional a las ya establecidas socialmente por los roles de género. Recordemos que entre marzo de 2022 y septiembre de 2023, organizaciones locales contabilizaron 5775 víctimas de violaciones de derechos humanos (mayormente detenciones arbitrarias), de las cuales 908 eran mujeres, entre ellas 21 mujeres trans, 19 lesbianas y 43 bisexuales. Con ello, las cárceles también se vuelven un entorno con condiciones sanitarias muy precarias, especialmente para las mujeres detenidas en estado de gestación, quienes no cuentan con atención ginecológica durante esta etapa y tampoco en el postparto, viéndose también gravemente afectadas las infancias.

Por otro lado, en el país centroamericano se registran en promedio 40 insultos diarios en contra de periodistas solo a través de la plataforma X. Aquellos ataques dirigidos a mujeres tienen la particularidad de contar con una carga de violencia sexual y lesbofóbica, reforzando patrones de discriminación y exclusión. Sumado a la preocupante situación de derechos humanos en El Salvador, esta realidad ha llevado a las mujeres periodistas, defensoras, e incluso a servidoras públicas (con una postura crítica del gobierno actual) al exilio y la autocensura.

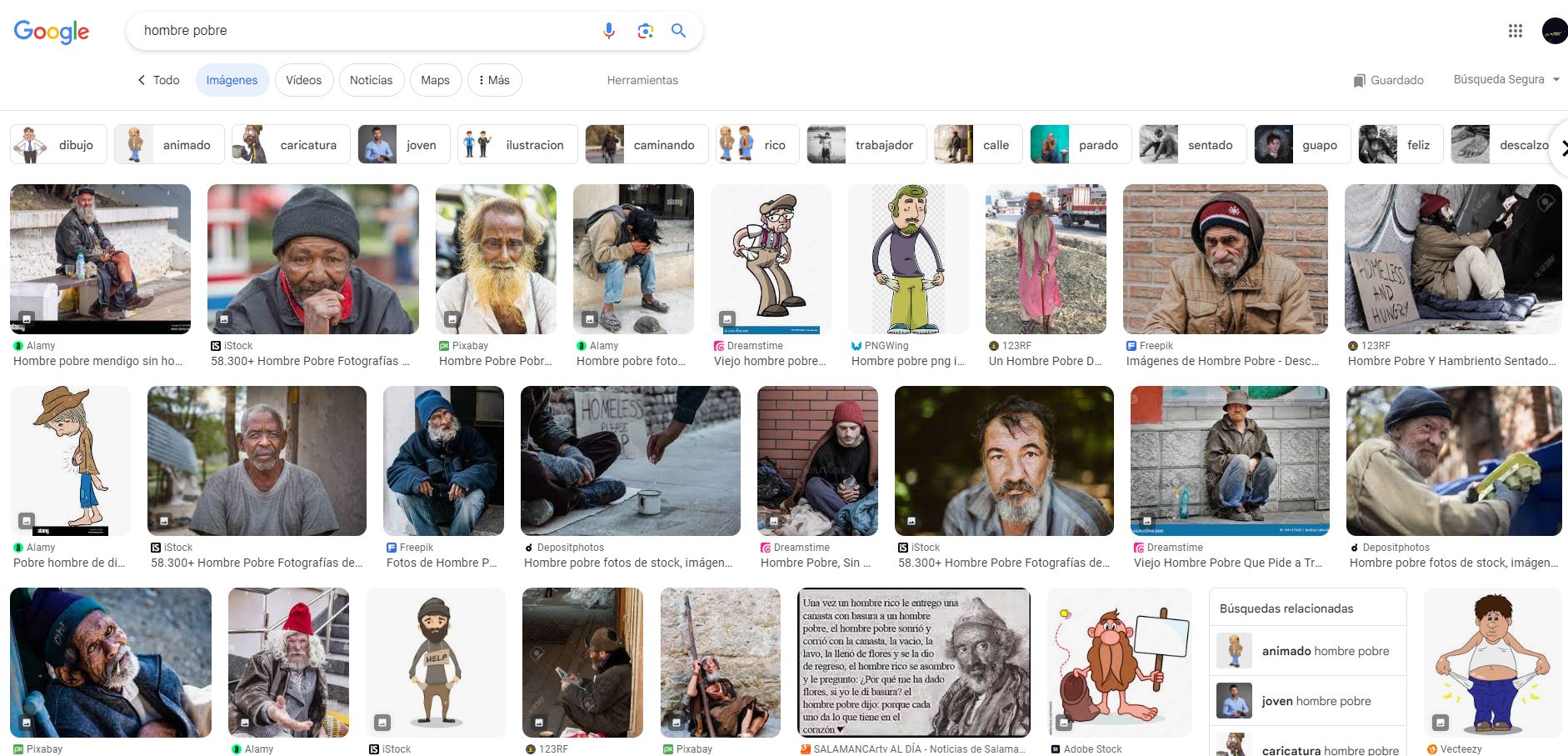

Por su parte, organizaciones locales han constatado que en Nicaragua la violencia digital contra las mujeres defensoras de derechos humanos ha escalado de manera alarmante desde el 2018, año en que se desataron importantes protestas públicas en el país. El uso de la tecnología como herramienta de represión ha facilitado nuevas formas de violencia, exacerbando los riesgos para quienes denuncian violaciones de derechos humanos. Las defensoras que enfrentan estos ataques reciben constantes amenazas, insultos, y sus agresores difunden información falsa sobre ellas para descalificarlas. De acuerdo con las mujeres entrevistadas en un estudio de FUNIDES, el 32.5% de las agresiones han trascendido al espacio físico, poniendo en evidencia el vínculo directo entre la violencia digital y el hostigamiento fuera de los espacios virtuales.

Las prioridades son claras, pero deciden ignorarlas

Finalizar con la violencia en nuestros países desde una perspectiva de género es una prioridad clara que los gobiernos siguen optando por ignorar. En Nicaragua, Venezuela y El Salvador, la persecución contra defensoras de derechos humanos y periodistas, el uso del hostigamiento judicial, las detenciones arbitrarias y la militarización del espacio público han reforzado un modelo de represión que restringe aún más los derechos de quienes cuestionan el poder. En estos marcos, la violencia de género se recrudece con cada nueva política pública, con cada acción gubernamental o con cada momento electoral, convirtiéndose en una expresión de control.

Las mujeres, desde diversas trincheras, han alzado la voz para nombrar las graves consecuencias que tienen las violaciones a los derechos humanos en estos regímenes no solo a nivel individual, sino también colectivo. Si bien estas vulneraciones afectan a la toda la población, sus efectos son diferenciados cuando se analizan con un enfoque de género, reconociendo desigualdades y estructuras de opresión. A pesar de la larga historia de violencia de género que se vive en estos países, como en toda la región, las mujeres siguen resistiendo y luchando por los derechos de todas.

En este 8M algunas saldremos a las calles a marchar, tomando el espacio público para canalizar nuestras demandas, o tal vez algunas de nosotras nos manifestaremos en la individualidad de nuestros espacios. Sea en lo público o lo privado, sea cual sea la forma de nuestra protesta, lo hacemos por todas las mujeres y niñas, por las diversidades de género, por la igualdad y por la garantía efectiva de nuestros derechos. Nuestro esfuerzo es colectivo y continuaremos hasta que la dignidad se haga costumbre para todas las mujeres y en todos los territorios.