Revisión comparada a la manera en que las legislaciones de México, Brasil, Colombia, Perú, Argentina y Chile abordan la retención de datos y el registro de teléfonos móviles

Temática: Privacidad

Por la libertad del acceso, la privacidad y el anonimato

El pasado 6 de Abril Dmitry Bogatov fue detenido en Moscú tras ser acusado de publicar mensajes extremistas en un sitio web ruso bajo los cargos de “incitar actividades terroristas o justificar terrorismo a través de Internet”. De acuerdo al dictamen, Bogatov debía permanecer en prisión al menos hasta el 8 de Junio a la espera del juicio en su contra. Hace un par de días se extendió dicho plazo hasta el 30 de Junio, rechazando la opción de cumplir arresto domiciliario. De ser encontrado culpable, Bogatov podría ser condenado a siete años de cárcel.

Lo cierto es que los mensajes en cuestión fueron publicados bajo un seudónimo a través de Tor. Como contexto, la red Tor está compuesta por miles de servidores distribuidos alrededor del mundo, y es mantenida principalmente por voluntarias y voluntarios que abogan por la privacidad, el anonimato y la evasión de la censura en línea. Al utilizar Tor para navegar, el tráfico pasa por tres nodos de la red antes de llegar a su destino, lo que permite ocultar la ubicación de origen de la usuaria. Estos nodos son elegidos de manera aleatoria y cada uno tiene un rol: entrada, intermedio y salida. El nodo de salida es el último punto en el circuito y está a cargo de acceder a internet como intermediario entre la red Tor y el sitio web de destino. Es decir, es un nodo puente entre la red Tor e internet.

Dada la naturaleza de Tor, quien mantiene un nodo de salida no posee control ni responsabilidad del contenido que pasa a través del mismo (aunque no se recomienda realizarlo desde casa). Probablemente cientos o miles de personas usaron el nodo de Bogatov para permanecer anónimas y anónimos, o para evadir la censura en sus países. En este caso, a Bogatov no se le está exigiendo responsabilidad como intermediario (y, de hecho, no la tiene); peor aún, se le atribuye autoría del contenido que pasó a través de su nodo de salida. Esto refleja un malentendido grotesco sobre cómo funciona la red Tor. Si también se considera que existen grabaciones de cámaras de seguridad confirmando que Bogatov no estaba en su hogar cuando los mensajes fueron publicados, y que la cuenta anónima continuó publicando mensajes después que Bogatov fuera detenido, se tiene un caso sin pies ni cabeza. Así y todo las autoridades decidieron que Dmitry debía permanecer tras las rejas por casi dos meses, como mínimo.

Esto presenta un grave atentado en contra de quienes luchan por el derecho a la privacidad y el anonimato en Internet. El caso de Bogatov sin duda puede producir efectos negativos sobre la percepción de la red Tor y amedrentar a quienes en defensa del acceso al conocimiento y el derecho a la privacidad y el anonimato en línea deciden contribuir con su tiempo, ancho de banda y hardware para mantener nodos de salida. Si bien son una excepción, existen casos de individuos que en el pasado se han visto en problemas por mantener un nodo de salida, pero nunca ha involucrado tiempo en prisión como en este caso. El proyecto Tor y otras organizaciones como Torservers, Debian, Access Now y la Electronic Frontier Foundation se han pronunciado al respecto y han condenado el hecho, pero sin duda es necesario un mayor esfuerzo y acciones por parte de la comunidad para revertir este tipo de situaciones, de lo contrario las voluntarias y voluntarios que mantienen nodos de salida podrían no encontrar el respaldo suficiente para seguir colaborando en pos de una Internet libre.

En Derechos Digitales creemos que no solo es importante denunciar este tipo de persecuciones sino que también abogamos por potenciar las herramientas que ayudan a proteger la privacidad y anonimato en línea. En este sentido nos parece de suma importancia masificar herramientas como Tor, ya sea fomentando el uso de Tor Browser entre las usuarias y usuarios que necesitan navegar de manera anónima, o aportando al crecimiento de la red con la instalación de más nodos de salida Tor en instituciones públicas, bibliotecas, universidades, colectivos u otro tipo de organizaciones que tengan los recursos para ello. Es por esto que en colaboración con organizaciones de la región buscamos promover el aumento de nodos de salida en América Latina como una manera más de expresar compromiso y aporte técnico a la defensa de los derechos humanos en Internet y como una forma de proporcionar diversidad e infraestructura desde el Sur. Desde principios de 2017 aportamos nuestro pequeño grano de arena a la red, y esperamos en breve comenzar con la documentación para reflexionar y compartir lo aprendido, con la esperanza de sumar a más organizaciones en la región y juntos generar conciencia en la comunidad y en las autoridades, sobre las implicaciones legales y técnicas asociadas a la mantención de nodos Tor, y sobre cómo el apoyo a esta red significa también un apoyo a los principios fundamentales de una Internet libre.

El ransomware que paralizó al mundo

El pasado viernes 12 de mayo, más de 200 mil computadoras en 150 países alrededor del mundo fueron afectadas por una agresiva campaña de ransomware llamada WannaCry, WannaCrypt0r o WCry. Se le llama «ransomware» porque cifra los documentos de una computadora y exige el pago de una suma de dinero para devolver los archivos a su estado original. Es decir, los archivos quedan inaccesibles hasta que se paga el rescate. Lo que ha hecho famoso al ransomware WannaCry es la capacidad y métodos utilizados para propagarse: fue demasiado rápido, desatando una crisis cibernética. Cuando empresas como Deutsche Bhan, Telefónica España y el Sistema Nacional de Salud (NHS) de Inglaterra recibieron el virus, los trenes se detuvieron, las líneas telefónicas dejaron de funcionar y los hospitales no pudieron tomar rayos X.

¿Qué pasó? ¿Se podía prevenir? ¿Y qué rol juega Estados Unidos en esta crisis?

Como contexto, el año pasado un grupo llamado “Shadow Brokers” hackeó a la National Security Agency (NSA) e hizo públicas todas sus “ciberarmas”. Se les dice “armas” porque, mediante ellas, la agencia más poderosa de espionaje del gobierno estadounidense explota vulnerabilidades y errores en plataformas comerciales de Apple, Microsoft o Android -comúnmente utilizados- para saber todo lo que sucede en sus sistemas. No es necesario dar clic: es un defecto de fábrica que nadie conoce, y que permite a la NSA entrar a teléfonos o computadoras.

WannaCry aprovechó una de las vulnerabilidades hechas pública por Shadow Brokers para atacar Windows. Técnicamente, se trataba de un fallo en SMBv1, que se utiliza para acceder de manera remota a un computador e intenta infectar a más computadores, generando una cantidad de direcciones IP públicas aleatorias y escaneando los computadores vulnerables de la red local en que se encuentra (de la oficina o de la casa donde está conectado el computador infectado).

En su momento, las preguntas más importantes fueron: ¿se puede prevenir infección? ¿conviene pagar para recuperar la información? Sin embargo, lo primero era corregir las vulnerabilidades. En Marzo de 2017 Microsoft hizo pública una actualización que corrige la vulnerabilidad utilizada por WannaCry para infectar nuevos computadores, por lo que la medida básica para prevenir cualquier infección del ransomware es mantener actualizado Windows. Esta es una responsabilidad que tenemos los usuarios y usuarias en el mundo: es importante actualizar.

Otras medidas para prevenir el ataque son deshabilitar SMBv1, y aplicar reglas de firewall para bloquear el acceso por defecto al puerto 445, pero si el computador ya está infectado con el ransomware, lo más importante es revisar si existen respaldos de la información. En general, WannaCry infectó redes institucionales o corporativas que debiesen tener respaldos de la información de las estaciones de trabajo, en cuyo caso los encargados deben volver a instalar el sistema operativo y restaurar los respaldos previos a la infección. De cualquier manera, no era recomendable pagar, dado que de ningún modo garantizaba la devolución de la información en su estado original.

Es importante resaltar que la NSA jugó un rol crucial en esta crisis. Como agencia de inteligencia no solo se ha encontrado con estos fallos sino que los ha buscado activamente para obtener ventajas competitivas ante conflictos que se desarrollan en el espacio virtual, además de utilizarlos en contra de los usuarios. Es decir, que además de violar la privacidad, ha dispuesto dichas vulnerabilidades para su uso arbitrario e indiscriminado. Si la NSA hubiera hecho públicas las vulnerabilidades en lugar de intentar tener una ventaja a partir de ellas, la crisis de WannaCry nunca se hubiera desatado. Su deber como organismo estatal es proteger y respetar derechos humanos, pero en este caso lograron todo lo contrario.

Las vulnerabilidades en sistemas operativos y programas siempre van a existir, y quien las explote tiene una ventaja competitiva en términos de poder de coacción sobre otros [así como tener una pistola o una bomba nuclear] o de inteligencia [recolección de información]. Los países no renuncian nunca a tener ese poder, por eso es urgente y necesario regularlo mediante políticas de control de «armas digitales» para que los gobiernos más poderosos estén obligados a hacerlas públicas, en vez de usarlas en contra de las personas. Además, las políticas de prevención y mitigación de ataques a infraestructura «básica» (estaciones de trabajo de instituciones públicas, sistemas de manejo y control de información, sistemas financieros o de salud, etc) son vitales.

Con respecto a las empresas, es obvio que deben «parchar» o «arreglar» las vulnerabilidades de sus productos. Sin embargo, parte del problema en este caso fue la dificultad para actualizar los sistemas, ya sea porque no son originales, porque no se les da la importancia necesaria o simplemente por falta de personal capacitado. En última instancia, los y las usuarias también jugamos un papel importante en la prevención y respuesta ante situaciones como esta. En el caso de América Latina -como ocurre en muchas otras regiones del mundo-, el uso extendido de software privativo sin licencia resulta, más que un problema de legalidad, una barrera en el acceso a una internet segura. Ante casos como estos, vale la pena invitar una vez mas a la reflexión sobre la importancia de utilizar sistemas libres, que permitan la actualización periódica, a la vez que son sistemas auditables.

La crisis de WannaCry deja algo claro: a medida en que la tecnología permea nuestra vida un problema similar se puede volver a presentar en cualquier momento. Lo importante es que existan políticas y medidas para prevenir el daño que puedan causar, además de presionar para que los estados se hagan responsables por las «armas digitales» que desarrollan: no pueden invadir nuestra privacidad arbitrariamente, y no pueden desatar crisis en infraestructura básica para la sociedad.

¿Quién defiende tus datos? (2017)

Evaluación del modo en que las compañías que proveen servicios de internet en Chile defienden la privacidad de sus clientes, al momento de responder las solicitudes de la autoridad para acceder a su información personal.

Protección de datos: una buena noticia a medias, en un Chile a medias

El anuncio sobre el ingreso de un proyecto para reemplazar la normativa de datos personales en Chile ha sido recibida con entusiasmo por parte de la industria, la sociedad civil y los organismos públicos. Se trata de un anuncio que los distintos actores llevan años esperando, y que organismos como la OCDE han exigido al gobierno con insistencia.

Si bien el articulado de la iniciativa legal requiere de un estudio más acabado y profundo, vale la pena comenzar reflexionando sobre el proceso que ha desembocado en la presentación de este proyecto y sobre su ingreso al Congreso en el último año del actual gobierno. Es necesario preguntarse qué espacio real tiene este proyecto en la agenda legislativa del Ejecutivo y si este se condice con otros proyectos empujados por el mismo gobierno en su último año.

El proceso

El proceso de elaboración del proyecto de ley de datos personales, con participación de distintos actores, ha sido complejo y contradictorio. En su inicio, el Ministerio de Economía estrenó el anteproyecto mediante la apertura de una consulta pública para recabar la participación y aportes de los distintos actores. A ello se sumó la formación de un Consejo de la Sociedad Civil de Protección de Datos Personales, con participación de distintos especialistas, representantes de la industria y de la sociedad civil. Pero paralelamente, un proceso distinto fue iniciado liderado por el Ministerio de Hacienda, para la elaboración del proyecto del gobierno, esta vez a puerta cerrada y sin oportunidades de participación abiertas y transparentes para la sociedad civil y otros actores relevantes.

El resultado es el proyecto que hoy conocemos, que dista en varios aspectos del sometido a consulta pública. Así, la propuesta presentada no recoge los resultados del proceso participativo y avanza en un sentido contrario a la tendencia mundial de acoger la participación multisectorial en regulaciones de esta naturaleza.

¿Compromiso real del gobierno?

En otras ocasiones manifestamos nuestras dudas sobre el nivel de compromiso del gobierno para avanzar en una agenda sobre protección de datos personales. Si bien la presentación del proyecto de ley debiera disipar estas dudas, lo cierto es que el momento en que ha sido ingresado al parlamento, acompañado con el historial de tramitación de proyectos anteriores, nos invita a guardar cautela con el entusiasmo inicial.

El último año de cada administración no suele caracterizarse por grandes reformas legislativas, dada la falta tiempo y espacio para empujarlas adecuadamente, y para desarrollar la discusión seria y profunda que requiere una materia compleja, como es la protección de datos personales. Es de esperarse que, durante 2017, gran parte de la agenda pública se concentre en las elecciones presidenciales y parlamentarias que se aproximan. En este sentido, que el presente proyecto se haya presentado ahora hace temer que falle el empuje para lograr la aprobación de la iniciativa antes del fin de esta administración.

Nuestras aprensiones se fundan por lo demás en que, tanto el primer gobierno de Michelle Bachelet como el de Sebastián Piñera presentaron iniciativas legales para modernizar la legislación de protección de datos personales, pero a pesar de su necesidad urgente, ambos proyectos quedaron en completo abandono al momento de asumir la administración posterior.

Otras iniciativas legislativas del gobierno

Además, llama la atención que esta iniciativa contradiga algunas de las iniciativas que el gobierno ha presentado públicamente como de alta prioridad para su último año. Este es un proyecto cuyo objetivo es proteger a las personas del tratamiento de sus datos personales por parte de entidades privadas y públicas, y se centra en el respeto a los derechos fundamentales y la dignidad de la ciudadanía. Exactamente en una vereda opuesta se encuentran iniciativas como el proyecto de crear un registro abierto de evasores del Transantiago. Que dicho registro sea público quiere decir que cualquier persona podrá realizar un tratamiento de esos datos personales, incluso generando bases de datos paralelas, que seguirán existiendo luego de que el infractor pague su multa y sea eliminado del registro. Más grave aun resulta que representantes del Ministerio de Transportes hayan reconocido públicamente que el objetivo de este registro es que los infractores sean discriminados al momento de postular a fuentes de trabajo. Por otro lado, esta misma iniciativa deja abierta la puerta para vincular la tarjeta BIP con los datos personales de la persona que la adquiere. Esto resulta problemático porque, como mostramos en un informe reciente, la tarjeta BIP no cuenta con elementos mínimos de seguridad, y permite a cualquiera acceder al historial de navegación de la persona que la utiliza, a través de su página web.

Otro ejemplo es el proyecto que busca regular plataformas tecnológicas como Uber, en el cual se establece la obligación de las plataformas de compartir la información sobre kilómetros recorridos, vehículos, conductores, lugares de recogida y bajada de pasajeros, hora y duración de los viajes, hora de reserva, precio cobrado y evaluación del viaje con ciertos organismos públicos, sin consideración de un régimen de consentimiento de los titulares de los datos ni el adecuado establecimiento de derechos para ells y obligaciones para los titulares de tales bases, como contrapartida. Si bien esta información puede resultar útil para el Ministerio a la hora de elaborar políticas públicas, debieran resguardarse los derechos fundamentales de los titulares de los datos, estableciendo que la información sea entregada en términos estadísticos, cumpliendo con criterios de anonimización, y bajo ninguna circunstancia de forma nominativa.

Espacio para enmendar el rumbo

Recibimos la presentación del nuevo proyecto de ley de protección de datos con un cauteloso optimismo, en cuanto representa una oportunidad importante para enmendar el rumbo en materia de protección de derechos fundamentales. Estamos ansiosos por ver que el debate legislativo considere y recoja la participación de la sociedad civil y otros actores relevantes, lo cual en su correcta ejecución podría mitigar la falta de participación previa. Una señal imprescindible del compromiso del gobierno no solo con su agenda de probidad y transparencia, sino con hacer realidad los derechos fundamentales de la ciudadanía, es que se conceda a este proyecto de ley la urgencia necesaria para su tramitación expedita, para corregir la desidia y el abandono del pasado.

Vigilancia y control sobre nuestros cuerpos (2017)

Las aplicaciones para controlar el ciclo menstrual, hoy tan populares, no son ideológicamente neutras. ¿Qué tal si les hacemos algunas preguntas sobre nuestra privacidad y libertad?

El estado de la protección de datos personales en Chile (2017)

¿Quién está utilizando malware en México?

Lo que pasa en México nos comprueba que a pesar de esta retórica, los invasivos programas de vigilancia se usan contra periodistas, opositores políticos y activistas. A la fecha, no hemos sabido de un solo caso en el que dichas herramientas hayan ayudado a la captura de algún miembro de los carteles de droga. Y en cambio, los ejemplos contrarios abundan.

Hae pocos días, el New York Times y Citizen Lab publicaron una investigación, que revela cómo un investigador del Instituto Nacional de Salud Pública y dos directores de organizaciones no gubernamentales recibieron mensajes SMS con hipervínculos a un malware específico: Pegasus, de la empresa israelí NSO Group. Estas tres personas tienen en común su oposición pública a las compañías de refresco y desde 2014 han promovido grandes campañas para subir el impuesto a las bebidas azucaradas, por los problemas de salud y obesidad que estas generan.

Los mensajes utilizados para infectar los dispositivos de ellos tenían un alto grado de ingeniería social: sabían cómo hablarles y de qué forma llegar a ellos para hacerlos dar click a los hipervínculos maliciosos. Desde notas periodísticas con sus nombres hasta falsas infidelidades de sus parejas y supuestos accidentes de hijos.

Según Citizen Lab, aunque no es seguro que el gobierno mexicano esté involucrado en esta labor de espionaje, sí hay una alta probabilidad. Primero, porque según NSO Group solo venden este tipo de tecnología a gobiernos; segundo, porque ya en 2012 se confirmó que el estado mexicano le había pagado a la empresa 20 millones de dólares por sus productos; y tercero, porque no es la primera vez que pasa.

En este nuevo caso, llama la atención que el programa de vigilancia se haya querido utilizar para vigilar, o simplemente para amedrentar, a activistas cuya labor podría afectar intereses comerciales de las compañías refresqueras. Sin embargo, ya en agosto de 2016 supimos que el mismo malware había sido enviado a Rafael Cabrera, un periodista líder en la investigación sobre la Casa Blanca: uno de los más grandes casos de corrupción que se han denunciado en el periodo de presidencia de Enrique Peña Nieto, actual presidente de México.

Para R3D y Social TIC, las dos organizaciones mexicanas que alertaron sobre los casos de los activistas anti-refrescos e iniciaron la documentación de los mismos, esto demuestra que el espionaje en México “está fuera de control”.

Desde de 2015 supimos que el gobierno mexicano era el cliente más importante de Hacking Team, la empresa italiana que vende Galileo, otro invasivo programa que tiene la capacidad de activar micrófonos y cámaras de forma remota, acceder a correos electrónicos, historiales de navegación y otra información sensible. Además, es sabido que en este país el malware fue utilizado en contra de opositores políticos durante las campañas electorales.

Igual de grave resulta el hecho de que, según un reciente informe de R3D, el 99% de actos de vigilancia a las comunicaciones se realizan de forma ilegal, ya sea porque no cuentan con el respaldo de una orden judicial o porque las autoridades que compran este tipo de programas no tienen la autorización para usarlos.

No es una cosa de ciencia ficción: el espionaje es algo real, utilizado de forma desproporcionada en un país que atraviesa una grave crisis de derechos humanos. Sin controles democráticos adecuados, estas prácticas violan no solo el derecho a la privacidad, sino también a la libertad de expresión de la ciudadanía.

Privacidad al estilo Trump

El celular se ha convertido en una extensión de nuestro cuerpo y nuestras ideas. Dormimos y vamos al baño con él, lo revisamos permanentemente. Las diferentes apps y redes sociales encierran nuestros pensamientos, dudas e intereses. Rara vez lo soltamos. Siempre está a nuestro lado. Por eso, no sorprende que los gobiernos –además de las empresas- quieran todos esos datos. Son una mina de oro para conocer las “verdades” de una persona. O mejor, de un grupo de personas.

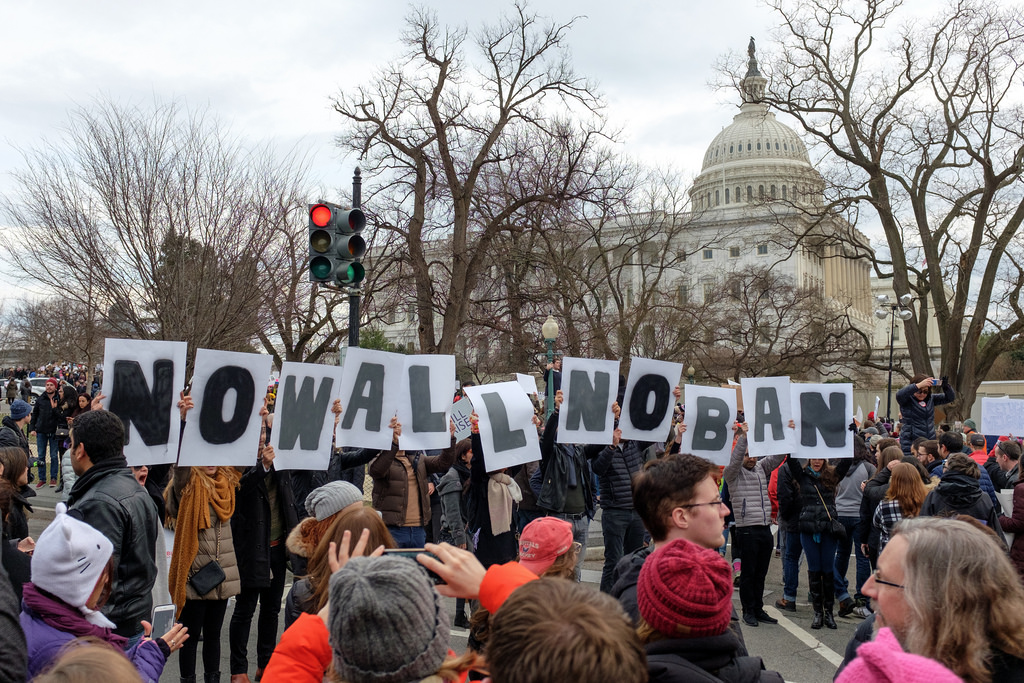

En Estados Unidos, la era Trump recién comienza y ya vaticina una lógica perversa: acciones gubernamentales para apoderarse de los datos personales y privados de las personas, que aunque entren en el campo de la legalidad no dejan de ser contrarias a los derechos humanos. Para comenzar, la prohibición, durante 90 días, de la entrada a personas de países mayoritariamente musulmanes, y durante 120 días, a refugiados. En la sección 14 de dicha acción –que en teoría fortalecería las leyes migratorias de Estados Unidos- el presidente ordenó que las autoridades “excluyeran a personas que no fueran ciudadanas del país o residentes legales de las protecciones de la Privacy Act, al tratarse de información personal identificable”. Y así, de un plumazo, despojó a los extranjeros en ese país, de su derecho a la privacidad.

Días después de la acción ejecutiva, una mujer mexicana iba de compras a ese país, pero al cruzar la frontera le quitaron su celular, lo revisaron y encontraron memes y mensajes de burla a Trump. Eso fue suficiente para quitarle la visa y confiscarle el teléfono. Nunca le dijeron por qué no la estaban dejando pasar, ni qué “falta” había cometido. Poco importó el paraguas protector de la Primera Enmienda, uno de los estándares más amplios para la libertad de expresión en el mundo.

Pero burlarse de Trump con memes es un ejercicio expresivo válido, legal y además merece extra protección por ser parte del discurso político. Además, los memes que una persona tenga guardados en su celular hacen parte de su información privada y por tanto, deben estar sujetos al derecho a la privacidad. Sin embargo, la acción ya se ha ejecutado.

Por otra parte, algunos medios estadounidenses han dicho que el Departamento de Seguridad Nacional “podría” pedir contraseñas a quien ingrese en su territorio, algo que ya está pasando y es una realidad. En febrero, un periodista tuiteó que a un compañero suyo le pidieron entregar la llave maestra de su administrador de contraseñas para revisar sus redes sociales, correos y mensajes. Los peligros que esto implica en términos de confidencialidad y protección de fuentes, no tienen comparación.

Sobre la legalidad, o no, de revisar los celulares en la frontera no hay claridad, pues la técnica hasta ahora ha sido pedir las contraseñas “de forma voluntaria” cuando exista “sospecha razonable” de una persona (lo que sea que signifique eso). Bajo este supuesto, la entrega de dichos datos podría interpretarse como consentimiento por parte de quien los posea. Pero al no entregarlos, ea persona se somete a no poder ingresar, lo cual supone claramente un acto arbitrario.

Ya desde 2014 el gobierno de Obama permitía la búsqueda de información en celulares de personas en “listas negras” de terrorismo. Ahora, la retórica de un gobierno de derecha que considera como enemigos a prácticamente todos los extranjeros, lleva esta práctica mucho más allá.

Pero no solo los extranjeros son blanco de violaciones a su derecho a la privacidad. En estos días, el departamento de policía de Washington D.C. ordenó judicialmente a Facebook que entregara información de quienes protestaron y fueron arrestados durante la toma de posesión del presidente Trump. Entre ellos estaban dos periodistas que cubrían las marchas ese día. El mensaje que se manda es aterrador: si protestas, no solo podrían arrestarte, sino que además habría bases para revisar tus redes sociales, ¿acaso para vincularte con un comportamiento específico, con alguien más, con un lugar?

En este caso, Facebook entrega información sin rechistar (según sus propios términos y condiciones): se requiere una orden legal, vinculada a una investigación criminal para obligarlos a entregar información básica de sus usuarios como nombre, duración de la cuenta, tarjeta de crédito, correo electrónico, último login e inclusive direcciones IP. Quizás nadie previó que inclusive esto podría ser usado de forma arbitraria cuando las instituciones democráticas están en aprietos.

En ambos casos estamos hablando de un esquema de censura indirecta: sin importar de donde seamos, el miedo a que nos revisen hace que borremos cosas y nos de pavor expresarnos con libertad en nuestros celulares. Y así, el disenso y la crítica están en peligro. Por eso es que ahora más que nunca, debemos ingeniar nuevas y creativas formas de aplicar los estándares universales de derechos humanos, que están por encima de cualquier legislación nacional: no importa lo que diga Trump, tenemos derecho a expresarnos y a que nuestra privacidad se respete.

La vulnerabilidad de Whatsapp está en sus políticas

Desde que Whatsapp fue comprado por Facebook hace tres años, han surgido muchas dudas respecto a cómo esto afecta la privacidad de sus usuarios. A comienzos de 2016 la empresa comenzó a cifrar por defecto todas las conversaciones, lo cual fue celebrado en todo el mundo; pero en agosto informó que compartiría los datos de sus usuarios con Facebook, decisión que tuvo una respuesta menos favorable, que incluso fue llevada a la corte y finalmente fue rechazada en territorio europeo.

La semana pasada el diario The Guardian declaró que Whatsapp tiene una vulnerabilidad que podría ser utilizada por gobiernos como puerta trasera para espiar los mensajes de sus usuarios, de acuerdo con la investigación realizada por el criptógrafo Tobías Boelter. Tal vulnerabilidad consiste en que la aplicación puede generar una nueva clave de encriptación mientras el usuario está desconectado, por ejemplo cuando se reinstala la aplicación en un dispositivo nuevo, sin necesidad de notificarlo pero guardando los mensajes que se hayan enviado, encriptándolos nuevamente y re enviándolos con la nueva llave.

Open Whisper Systems, empresa creadora de la aplicación de mensajería Signal y del protocolo de encriptación que es utilizado también en Whatsapp, respondió que no hay tal falla sino una limitación propia de los sistemas de encriptación, y que en ningún caso se trata de una puerta trasera. Por eso la app ofrece la opción de notificación cuando se haya cambiado la clave de encriptación, lo que fortalece la seguridad en las comunicaciones.

Pero, ¿por qué no notifica siempre a sus usuarios? Porque frente a la seguridad, para Whatsapp es más importante que la experiencia de usuario sea cómoda y sencilla. Por eso no tomó medidas luego de que, en abril de 2016, Boelter les notificara la falla. Y si bien se ha dicho que la solución es tan sencilla como activar manualmente las notificaciones o que esta vulnerabilidad es pequeña aún si la persona usuaria teme ser interceptada por agencias gubernamentales, es problemático que el código de Whatsapp no sea auditable, lo que hace más difícil saber si esta limitación puede o no ser utilizada para analizar y espiar las comunicaciones.

La falla encontrada en WhatsApp es un recordatorio crítico de que las comunicaciones seguras no dependen solo de un buen protocolo, sino de la confianza en las empresas y personas que diseñan y mantienen las herramientas que utilizamos. Y en el caso de Whatsapp y su propietaria Facebook, aunque han declarado su compromiso con la seguridad de las comunicaciones frente a la solicitud por parte de gobiernos, como pasó por ejemplo en Brasil, parece cada vez más difícil confiar.

Al respecto, es necesario recordar que hace poco, Facebook comenzó a estudiar detenidamente la manera de ingresar al mercado chino, aceptando las políticas de censura en ese país, y también que ha optado por colaborar con Israel en censurar contenidos a nombre de la lucha contra los mensajes de odio, pero a costas del derecho a la libertad de expresión, principalmente de los palestinos.

Si bien es cierto que la seguridad responde a un modelo de amenazas particular para cada usuario, y que Whatsapp es una herramienta que ofrece grandes facilidades y beneficios, hoy día hay otras aplicaciones que ofrecen servicios similares pero se preocupan más por proteger las comunicaciones y menos por capitalizar al máximo los datos de sus usuarios. Un ejemplo claro es Signal, que aunque se basa en el mismo protocolo no presenta la misma falla de Whatsapp, o Wire, cuyo «más grande defecto» es que casi nadie la tiene instalada.