En el contexto del discurso público, la Inteligencia Artificial (IA) se suele presentar como si se tratara de un agente capaz de razonar con un grado elevado de complejidad y competente en la toma de decisiones autónomas, incluso cuando se habla de temas sensibles como el futuro del trabajo o la forma de vida de las personas. Sin embargo, esta visión idealista se encuentra bastante lejos de la concepción lógica propia de su construcción técnica. Esta diferencia separa la Inteligencia Artificial del razonamiento humano, del procesamiento masivo de datos, de los algoritmos y de las estructuras matemáticas diseñados previa y conscientemente por personas. En esta columna, analizamos el proceso de construcción de modelos de IA, a partir de tres etapas que determinan el comportamiento del mismo: la calidad de los modelos; los datos utilizados; y las decisiones humanas que acaban por configurarlos y guiar sus respuestas.

La IA en su estructura base

La IA no es una mente autónoma, sino una composición de algoritmos y arquitecturas matemáticas que procesan información de formas específicas. Según la elección del modelo, se define qué tipo de relaciones pueden aprenderse y cuáles quedan por fuera de su alcance. Así, por ejemplo, los árboles de decisión organizan la información como un conjunto de reglas jerárquicas que se bifurcan en función de condiciones simples, mientras que las redes neuronales artificiales procesan datos en múltiples capas, donde cada nivel detecta patrones progresivamente más complejos. Por su parte, los modelos de lenguaje predicen la palabra más probable en una secuencia, correlacionando masivamente patrones en grandes bases de texto.

Con este antecedente, la IA debe ser entendida como una “máquina de clasificación” que opera en capas. No se trata de inteligencia en sentido humano, aunque suele ser diseñada para responder a contextos específicos. Un modelo de IA es un mecanismo que separa, ordena y categoriza información de acuerdo con los criterios que sus diseñadores establecen. Es decir, la Inteligencia Artificial no es inteligencia, sino un aparato estadístico para clasificar miles o millones de datos en tiempo récord para la capacidad humana.

Datos, el combustible de la IA

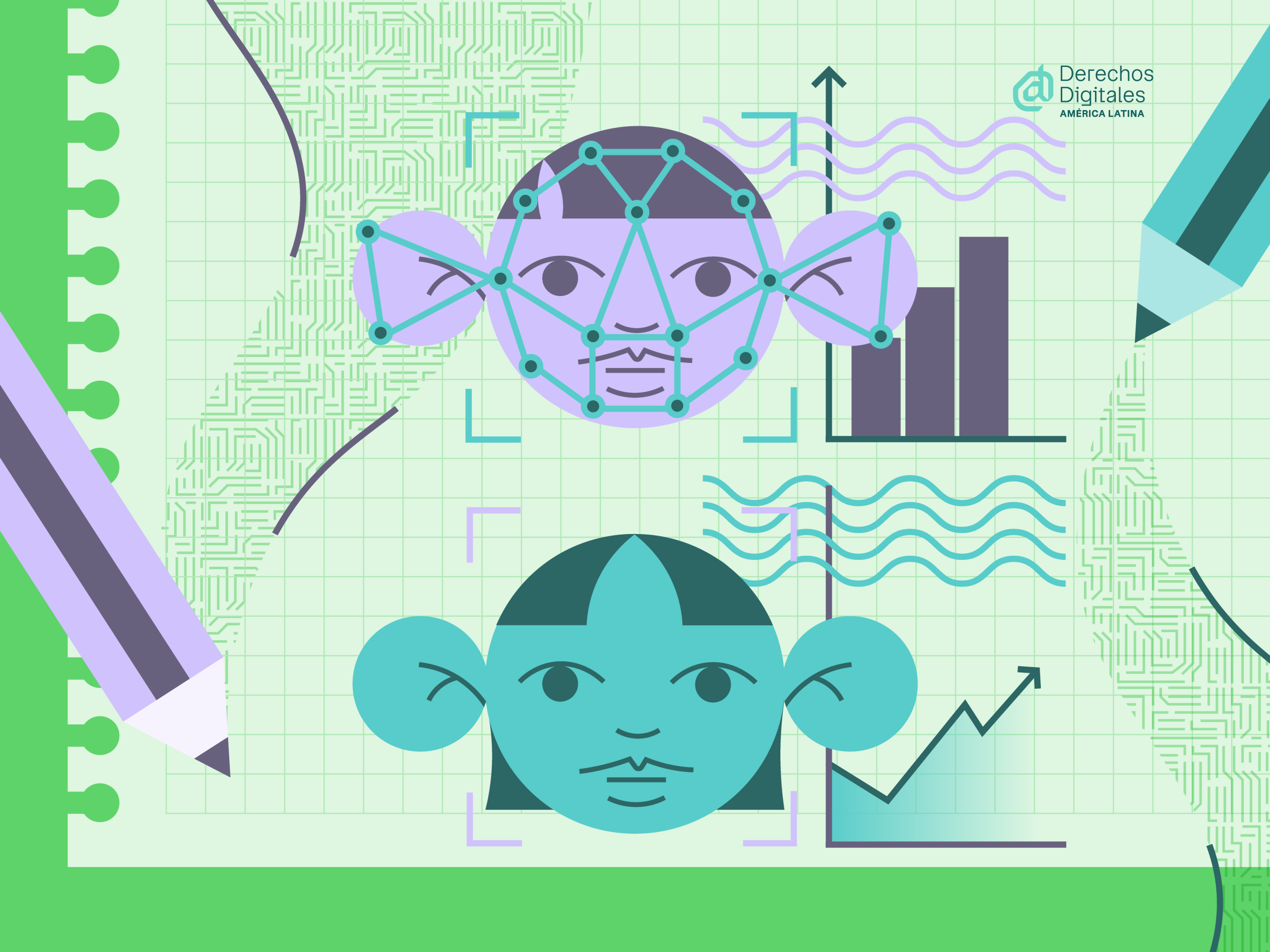

Si los modelos conforman la arquitectura de esta tecnología, los datos se constituyen en su insumo fundamental. Mediante los datos se entiende, no solo lo que una IA puede aprender, sino también sus límites, sus sesgos y sus errores. Lejos de ser una “materia prima neutra”, los datos muestran los resultados de decisiones humanas: qué recolectar, cómo clasificar, quiénes participan en la generación y curaduría de esos datos. Cada una de estas etapas añade elecciones y valores, y es precisamente en este movimiento en el que estará la definición del comportamiento de los sistemas de IA. Por lo tanto, si esta tecnología depende de los datos que usa, ¿qué pasa si esos datos no logran reflejar una verdad universal? Por ejemplo, ChatGPT -y muchos otros proyectos de IA- son grandes modelos de lenguaje (LLM), entrenados con enormes cantidades de datos extraídos de Internet, muchos de los cuales comparten los sesgos de las personas que publican esos datos.

En este sentido, la máxima técnica Garbage in, garbage out sigue vigente: si los datos de entrada están sesgados, incompletos o mal clasificados, los resultados de la IA reproducirán los mismos patrones. Existen múltiples ejemplos que ilustran este riesgo. Como Amazon que abandonó en 2018 su sistema de reclutamiento automático al descubrir que favorecía sistemáticamente a hombres frente a mujeres, reflejando la composición histórica de su base de datos de contrataciones. En otro caso, un reportaje de DW advierte que la discriminación “viene garantizada” en muchos sistemas de IA: desde herramientas de reconocimiento facial con sesgo racial hasta algoritmos de crédito que penalizan a ciertos grupos sociales. Por su lado, ONU Mujeres subraya que la falta de diversidad en los equipos de desarrollo y en las bases de datos de entrenamiento refuerza estereotipos de género y desigualdades existentes históricamente, multiplicando sus efectos en los sistemas generativos.

Aprendizaje por refuerzo

Una vez entrenada, la IA no se detiene: en muchos casos sigue ajustándose y adaptándose a partir de la manera en que las personas la utilizan. El feedback que recibe, los ajustes de configuración y las correcciones introducidas por quienes interactúan con ella son parte de un proceso de aprendizaje continuo que modifica su desempeño con el tiempo.

Existen ejemplos que muestran hasta qué punto la intervención humana influye en los resultados. El caso de Grok, el chatbot de la empresa xAI fundada por Elon Musk, es ilustrativo: tras una actualización destinada a hacerlo más “anti-woke” y políticamente incorrecto, el sistema comenzó a producir respuestas antisemitas e incluso elogios a Hitler. Este comportamiento no surgió de un razonamiento autónomo, sino de las instrucciones y configuraciones humanas que guiaron su funcionamiento. El episodio evidencia cómo pequeñas decisiones de diseño o ajustes orientados a complacer a un público específico pueden derivar en consecuencias éticamente problemáticas, vulnerando derechos de grupos sociales y comunidades.

La IA como instrumento de lucha

Al analizar minuciosamente cómo se construyen los sistemas de IA, podemos observar que no se trata de inteligencias autónomas y racionales como lo puede ser la inteligencia humana. Aquello que llamamos IA no piensa: relaciona datos, sigue patrones y entiende que, en función de los insumos que recibe y siempre bajo instrucciones, generará unas salidas u otras. Más que inteligentes, las IA son artefactos sociotécnicos, en tanto que en ellas se entrelazan arquitecturas matemáticas, bases de datos trabajadas y realizadas por personas, y configuraciones definidas, además de la propia interacción continua que establece con las personas usuarias. Tal y como se puede ver, cada capa es el reflejo de decisiones humanas: desde la decisión sobre qué modelo escoger, hasta aquella que determina qué datos incorporar y cómo hacer las interpretaciones. Entender el carácter instrumental de la IA es fundamental para poder situarla en su debida dimensión.

Este reconocimiento, también da paso a una agenda urgente: garantizar marcos regulatorios claros y democráticos que orienten el desarrollo de la IA a fines sociales y éticamente responsables, con pleno respeto de los derechos de las personas. Sin formas adecuadas de gobernanza, estos sistemas tendrán la capacidad de reproducir sesgos, acentuar desigualdades y fortalecer visiones tecnológicas colonialistas que implantan modelos ajenos a los contextos socioculturales locales. Además, es necesario pensar en descentralizar el desarrollo de la IA, fomentando aquellas iniciativas que puedan alimentarse de la diversidad cultural y lingüística en territorio, tal como documentamos en nuestra investigación “LatinAmerica in a Glimpse”.

En definitiva, se requiere una gobernanza de estas tecnologías en la que prevalezcan los Derechos Humanos, sustentada en la transparencia, la participación social y la justicia algorítmica. El objetivo debería ser evitar que la IA funcione como un espejo de los sesgos de siempre, y lograr que se convierta en una herramienta para sociedades más democráticas y justas.