En el pasado ya hemos mencionado cómo, al proteger desproporcionadamente los intereses de los titulares sobre los del público, el sistema de derechos de autor no cumple con su objetivo de entregar acceso al conocimiento y a la participación en la actividad cultural, o a promover la libertad de expresión. Bajo ciertas circunstancias, la institución de las “obras huérfanas” busca remediar este desbalance pero lamentablemente, ningún país de Latinoamérica ha legislado al respecto.

El sistema internacional de derechos de autor se basa en el principio de que cualquier uso que un tercero desee realizar sobre una obra requiere la autorización expresa del titular de los derechos sobre la mismo (quien puede o no ser su autor). Esto es lo que Lawrence Lessig denominó la “cultura del permiso”, en contraposición con una “cultura libre”. Sin duda que exigir autorización del titular para cada uso que se quiera hacer de una obra limita el acceso al conocimiento y la creatividad pero existen casos donde, sin justificación alguna, la impiden por completo.

Por ejemplo cuando, a pesar de que el tercero que desea utilizar la obra está dispuesto a conseguir la autorización del titular y pagar por dicha utilización, conseguirla no es posible, ya sea porque es imposible identificar al titular o porque es imposible ubicarlo.

Por tanto, las obras huérfanas son aquellas en que ninguno de los titulares de los derechos de autor sobre la obra está identificado o, de estarlo, no es posible localizarlo para obtener la autorización para utilizar la obra. Así, las obras huérfanas se encuentran en un limbo que no beneficia a nadie: no generan un beneficio económico para su titular, en tanto no es posible conseguir su autorización, pero no pueden ser utilizadas aunque exista la voluntad de pagar por su uso. Es un caso de total pérdida social a raíz de la irracionalidad del sistema de derecho de autor.

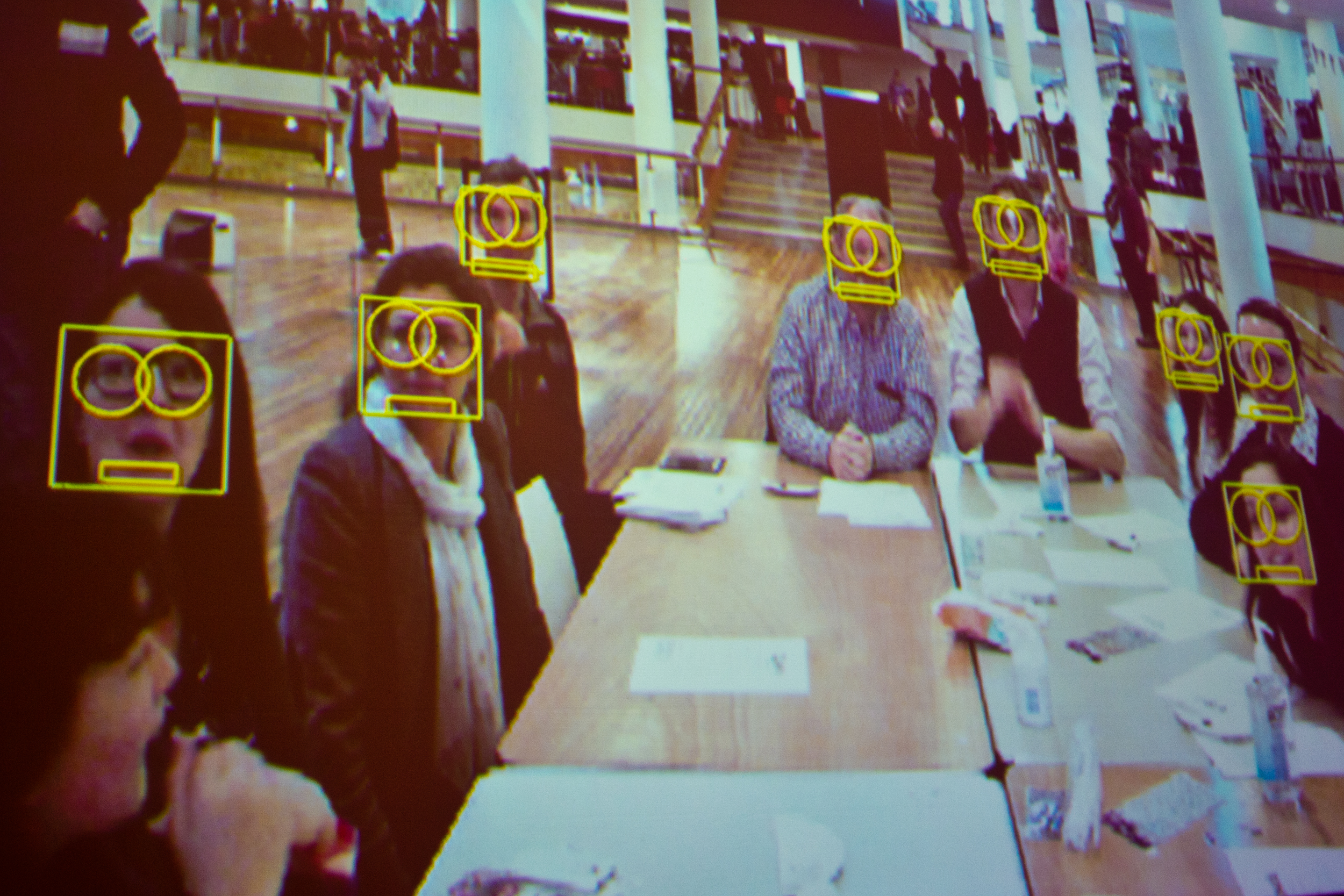

Esta situación es particularmente delicada para instituciones cuya misión es el rescate patrimonial, como son los museos, los archivos, las bibliotecas y las galerías, ya que la existencia de obras huérfanas genera un hoyo negro cuando se desea digitalizar obras del siglo XX. Ante la imposibilidad de hallar a los titulares de las obras que buscan rescatar y preservar, estas instituciones se ven obligadas a tomar una decisión injusta: o no exhibir la obra por ser imposible cumplir con la legislación o exhibirla de todas formas y exponerse a las sanciones establecidas en la ley. En otras palabras, la legislación de propiedad intelectual trata como delincuentes a instituciones como archivos, bibliotecas y museos, por cumplir con su mandato de rescate patrimonial

Ante esta situación, países como Australia, Inglaterra y la Unión Europea han legislado sobre la materia, a fin de permitir la utilización de obras huérfanas en aquellos casos en que es imposible ubicar al titular de la obra, y así permitir el florecimiento de iniciativas de digitalización y promoción cultural.

Hasta el momento, han sido dos los sistemas utilizados en legislaciones extranjeras para regular esta institución. Un sistema consiste en permitir la utilización de obras huérfanas a todo tipo de personas, naturales o jurídicas, tanto para fines comerciales como no comerciales, pero mediando una autorización administrativa previa. El segundo no requiere una autorización previa pero está reservado solo a cierto tipo de instituciones como galerías, museos, archivos y bibliotecas, o solo respecto de usos no comerciales.

La ausencia de legislación respecto de la institución de las obras huérfanas en Latinoamérica puede ser utilizado como una oportunidad. De esta forma, un esfuerzo conjunto por idear un sistema más flexible que el de la legislación comparada puede permitir dar pasos en la dirección correcta para recuperar un sistema de derechos de autor cuyo objetivo sea incentivar el acceso al conocimiento, a la participación en la actividad cultural y a la libertad de expresión.