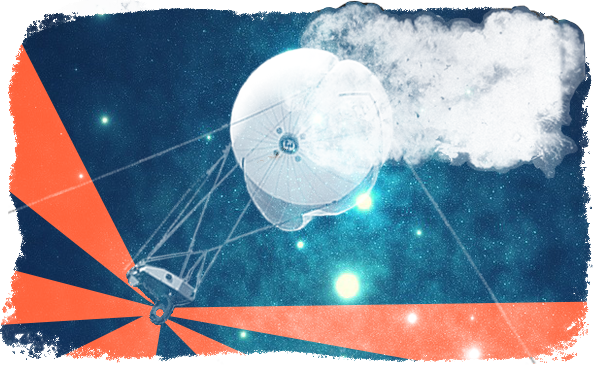

El gobierno de la ciudad de Buenos Aires presentó la semana pasada un nuevo sistema de globos aerostáticos de vigilancia que será implementado en el marco de un “Sistema Integral de Seguridad”. Los globos complementarán la iniciativa “Anillo Digital” que consiste en un cinturón ubicado en las entradas y salidas de la ciudad, a lo largo de las autopistas La Plata-Buenos Aires y General Paz, donde hoy se encuentran puestos que monitorean la entrada y salida de vehículos a través de pórticos con cámaras lectoras de patentes que permiten identificar cuántos autos entran y salen, quiénes son sus propietarios y si tienen orden de captura o patentes apócrifas.

A 30 metros de altura, en los globos aerostáticos se instalarán cámaras con capacidad de grabar en 360° y que contarán con visión diurna y nocturna, energía propia y transmisión de video en tiempo real. Además, tendrán la capacidad de identificar y seguir objetivos en distancias mayores a dos kilómetros y de realizar reconocimiento en un radio de hasta 4 km.

Las autoridades de vigilancia anunciaron que utilizarán este sistema para “monitorear todas las entradas y salidas de la ciudad a lo largo del Riachuelo [y también] en eventos masivos, cuando haya una manifestación grande, una maratón, algo que haya que cubrir en una amplia área”. Respecto a la manera como este tipo de sistemas de vigilancia pueden afectar el derecho a la privacidad, de acuerdo con un medio local las autoridades consideran que los “globos filman en espacios públicos, no se meten en las casas, salvo que haya un proceso de flagrancia”, ante lo cual no podemos más que estar en desacuerdo respecto a los límites del derecho a la privacidad.

Esta idea no es nueva en nuestra región. El 16 de agosto de 2015 dos municipios de la región metropolitana de Santiago de Chile implementaron el uso de globos de vigilancia con similares características, los cuales han operado desde entonces las 24 horas del día, registrando toda clase de sucesos en un radio de filmación que alcanza 2 km. En los dos municipios, la instalación de estos globos se justifica en la necesidad de nuevas tecnologías para apoyar en el resguardo de la seguridad pública.

En su momento, desde Derechos Digitales y junto con vecinos de dichos municipios, participamos del litigio en contra del uso de los globos de vigilancia por atentar contra los derechos a la privacidad, a la libertad de expresión y a la libre reunión. En esa ocasión los tribunales chilenos, si bien terminaron por admitir el funcionamiento de los globos bajo estricto cumplimiento de una serie de condiciones que permitieran mitigar las afectaciones a la privacidad, reconocieron que:

“… atendidas las particularidades del sistema de televigilancia que ha sido instalado en zonas preeminentemente residenciales, no cabe sino aceptar que quienes habitan en su radio de acción puedan sentirse observados y controlados, induciéndolos a cambiar ciertos hábitos o de inhibirse de determinados comportamientos dentro de un ámbito de privacidad como es la vida doméstica”.

La privacidad incluye tanto el derecho a no ser molestado, como el derecho de una persona a controlar la información disponible sobre ella. La protección de la vida privada se trata de sujetos y no de espacios, como erróneamente se ha afirmado en Chile y ahora se repite en Argentina, a través de las declaraciones de las autoridades que señalan que los globos “filmarán solo espacios públicos”.

El derecho a la privacidad existe y puede ser ejercido tanto en espacios privados como en espacios públicos, donde muchas veces se desarrollan actividades íntimamente conectadas con la dignidad de las personas, respecto de las cuales sí existe expectativa de privacidad: conversaciones, encuentros, visitas a diferentes lugares, entre otros. Aunque se desarrollen en espacios públicos, las personas no tienen por qué esperar que dichas actividades sean observadas y registradas por parte de instituciones o particulares, pues podrían develar sus más íntimas conductas.

Desde hace podo menos de dos años, en Chile los globos de video vigilancia están registrando 24×7 todo lo que cae en el radio de la cámara, cuyo alcance abarca necesariamente espacios privados como patios y terrazas, además de los púbicos como ya hemos dicho. A través de estos globos se vigila sin orden judicial de por medio y sin la existencia de la más mínima sospecha sobre la comisión de un delito. Se vigilan todos los eventos, todas las personas, día y noche, y no sabemos qué pasar luego con el material recopilado.

Por último, el sistema de globos de video vigilancia en Chile no ha resultado en mayor seguridad pública para los municipios donde ha sido implementado. Su uso no compensa en forma alguna el extremo nivel de afectación de la privacidad de las personas que habitan o visitan estos lugares y en cambio, de acuerdo con información proporcionada por los mismos municipios, no existe a la fecha ninguna causa judicial iniciada con base en las imágenes capturadas por los globos.