Asegurar la velocidad de internet es un deber en Chile. Así lo establece la ley desde noviembre de 2017, pero esta obligación no ha sido exigible por años, a falta de la emisión de normas adicionales por parte de la Subsecretaría de Telecomunicaciones de Chile (Subtel), según ordenaba la misma ley. Esto cambió a fines de julio de 2020. Después de un largo período de consideración, consultas públicas y pandemia, la Subtel finalmente emitió el reglamento que regula al organismo técnico independiente (OTI) encargado del cumplimiento de la ley, y la norma técnica con las condiciones de operación.

Sin embargo, con la emisión de las nuevas reglas se busca consolidar un esquema donde, a cambio de medir las condiciones de conectividad, se pide a cambio información personal de las usuarias de internet.

La propuesta de mediciones de calidad de la red

Para medir el cumplimiento de la oferta de velocidad por parte de los proveedores de servicios de internet, las reglas fijan la necesidad de monitorear esa velocidad. Con ese fin, el reglamento y la norma técnica piden que el OTI registre distintos datos y, en algunos casos, autoriza a Subtel a acceder a esa información. Pero el detalle de los datos que serán recolectados ha sido objeto de cuestionamiento.

Para la medición, el reglamento y la norma técnica definen tres elementos de monitoreo (art. 2 de la norma técnica):

- Los ISP deben permitir al OTI el “acceso a sus sistemas de medición de tráfico en línea, a las capacidades instaladas y a las relaciones de interconexión entre sus nodos de redes de acceso, agregación y core” (art 13 de la norma técnica).

- Realización de mediciones a través de sondas:

- Desde una sonda hasta un servidor nacional en la red del mismo ISP.

- Desde una sonda hasta un servidor nacional en la red de otro ISP.

- Desde una sonda hasta un servidor ubicado fuera del territorio nacional.

- Accesibilidad a sitios web nacionales e internacionales.

- Realización de mediciones a través de un aplicación en el equipo del usuario:

- Desde la aplicación hasta un servidor nacional en la red del mismo ISP.

- Desde la aplicación hasta un servidor nacional en la red de otro ISP.

- Desde la aplicación hasta un servidor ubicado fuera del territorio nacional.

- Accesibilidad a sitios web nacionales e internacionales.

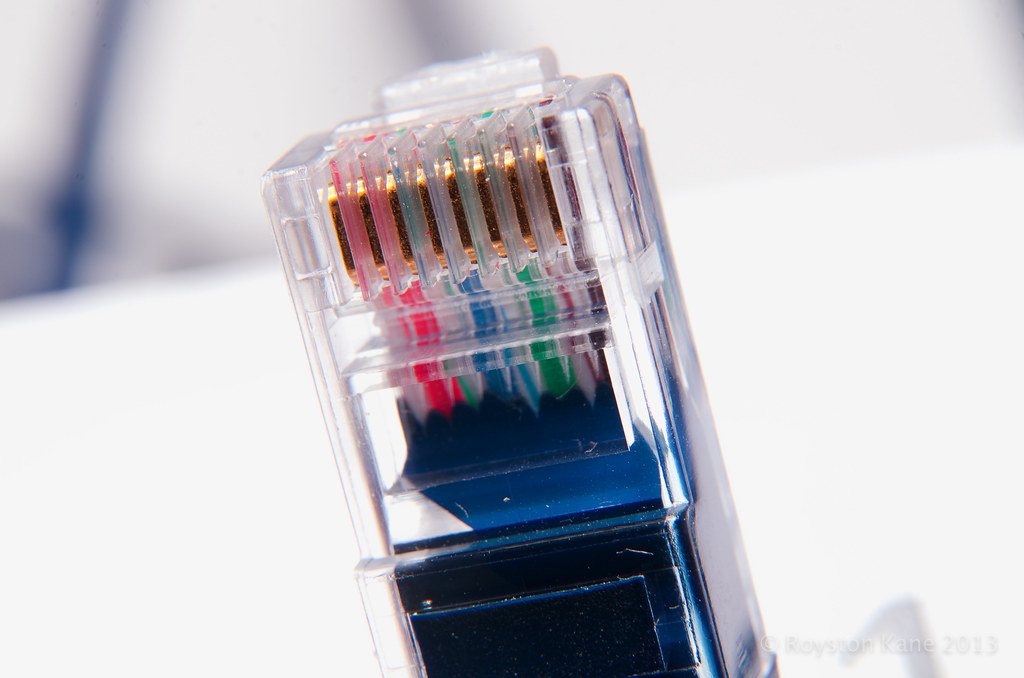

Pero no solamente se establecen esos registros. Se establece además que el OTI tendrá acceso a una serie de datos del cliente que instale la aplicación (art. 12 de la norma técnica), que incluyen:

- IMEI, número telefónico, número de IP, IMSI, SimCard del equipo del usuario.

- Identificador del ISP y nombre del operador de red de ser el caso.

- Marca y modelo de equipo del usuario.

- Fecha y hora de la medición.

- Identificador de nodo de acceso.

- Coordenadas de ubicación geográficas del equipo del usuario.

- Porcentaje de uso de CPU y memoria del equipo del usuario al momento de la medición.

- Niveles de potencia de señal y relación señal a ruido.

Si bien se puede argumentar que estos datos son necesarios para que la OTI realice el monitoreo respectivo y verifique si el proveedor de internet está cumpliendo con la velocidad promedio comprometida, el artículo 24 de la norma técnica establece que la Subtel tendrá acceso a toda esta información de manera agregada, desagregada, en tiempo real y georreferenciada.

Esto es complejo, ya que —como hemos señalado en el pasado— datos tales como el número de teléfono constituyen datos personales, capaces de identificar a la titular. Por otro lado, se incluye en la lista información que da cuenta de las actividades y los hábitos personales del usuario, como también su geolocalización y dirección IP. Es decir, información sensible. Subtel exige acceso a esta información de manera nominada, es decir, siendo capaz de vincular la información con la identidad de cada usuario.

Estas exigencias de datos por la Subtel no solo carece de sentido operativo, sino que van abiertamente en contra de las garantías constitucionales y legales sobre la información personal. Además, se trata de información que no le corresponde obtener a una entidad gubernamental sin una justificación de la legitimidad del fin perseguido, y sin consentimiento explícito de las personas titulares de los datos.

Si la finalidad es la publicación de informes estadísticos, entonces no es necesario que Subtel acceda a esta información de manera nominada, por lo que la medida resulta desproporcionada. En caso contrario, con el el fin de monitorear la velocidad de la conexión a internet, se está creando un riesgo innecesario de que la información sea mal utilizada, que se filtre o se abuse de ella.

Vinculado con lo anterior, y también preocupante, es el hecho de que no se establezca una finalidad específica y exclusiva para esta información recolectada. La norma técnica (art. 25) se limita a decir que esta información será utilizada con el objetivo de elaborar informes comparativos para difundir los resultados a las usuarias, “entre otros fines”. Con esta fórmula, el documento deja la puerta abierta para que estos datos sensibles sean utilizados para fines distintos, lo que contradice los principios de la legislación de protección de datos personales, dejando a los ciudadanos en una situación de indefensión frente al potencial de explotación no autorizada.

La recolección desproporcionada de datos, desde la perspectiva técnica

¿Es necesario hacer mediciones individuales de la velocidad de conexión a internet?

No. Si tomamos en cuenta que el OTI tendrá acceso a los sistemas de monitoreo y a las capacidades instaladas de todos los nodos (equipos de comunicación, ya sean routers o switches) de los ISP, asimismo tendrá la posibilidad de monitorear la saturación de tráfico por cada nodo, pudiendo de esta forma levantar la alerta o generar la notificación al ISP correspondiente. Este punto no es menor, pues al tener los datos de funcionamiento y calidad de red de cada nodo están accediendo al mismo nivel de información de quienes administran la red, a excepción de las configuraciones de los dispositivos. En otras palabras, este conglomerado de datos es bastante valioso para fiscalizar el correcto funcionamiento de las redes.

Cuando un ISP implementa un plan de internet a un cliente, básicamente, lo que hace es un Traffic Shaping (limitación de tráfico), lo que permite controlar la velocidad de transferencia máxima de la conexión contratada. En ese sentido, cabe la posibilidad de que el ISP, al ver que algún segmento de la red pueda llegar a la saturación, aplique un limitante de tráfico a los usuarios hasta una velocidad de transferencia máxima menor a lo contratado, para evitar la saturación de uno o más nodos. En este escenario, el OTI no podría evaluar la calidad del servicio a través de lo expresado en el párrafo anterior.

Acá es donde entran en juego las mediciones a través de sondas. Se trata de una suerte de “prueba de caja gris” en la cual se ejecutan pruebas de tráfico desde una sonda y hacia un servidor o sitios web, ambos con ubicación conocida a través de sus direcciones IP. Esta prueba, si bien aporta información periódica del comportamiento de la red, resulta susceptible de “engaño” a través de una liberación de Traffic Shaping, o con una instrucción de prioridad al tráfico entre ambos dispositivos (sonda-servidor).

En este punto es donde se podría justificar la realización de mediciones a través de la aplicación propuesta, cuyo objetivo es generar pruebas desde los distintos dispositivos (teléfonos, tablets, computadores, etcétera) y hacia servidores en distintos puntos (nacionales e internacionales). En principio parece una buena idea, pero tal como vimos en el caso anterior) también es susceptible de “engaño”, dado que los equipos de comunicación pueden aplicar criterios de prioridad de tráfico hacia las ubicaciones de los servidores contra los que se harán las mediciones. El inconveniente que se genera a través de esta perspectiva de prueba es que en su afán de generar mayor certeza se requiere de información más detallada sobre quién, cuándo, dónde y desde qué dispositivo se realiza la prueba. Esto implica que dichos datos permitirían la identificación de sus actividades georreferenciadas o en redes digitales en el pasado y en el futuro.

Como corolario de lo anterior, está la posible necesidad del manejo de miles de (posibles) pruebas, y que cada una deba ser gestionada a través de reportes, para luego dar paso a rectificaciones, reparaciones o adecuación del plan, lo cual genera un esfuerzo logístico y humano innecesario.

Considerando lo anterior cabe hacerse la pregunta: ¿Existe otra perspectiva o acercamiento para poder verificar el correcto funcionamiento de la red o planes de internet que no conlleve la exposición de datos de los usuarios?

Lo primero que podemos ver es que, del listado de datos que definen como “datos ambientales” (art. 12), se podía prescindir de algunos datos de identificación para resguardar la privacidad del usuario. Por ejemplo, solo registrar el nodo de entrada desde el dispositivo que ejecutó la prueba, el plan contratado, el ISP correspondiente y, quizás, un par más de datos como intensidad de la señal. En este caso, la evidencia no permitiría un reclamo o reparación basada en un hallazgo individual, pero sí permitiría generar la solicitud de corrección del problema hacia el ISP en una zona en particular.

En otro sentido, también se podría generar un muestreo de tráfico por zonas que permitiera generar una estadística de uso y proyectar la demanda futura a modo de ir realizando los cambios necesarios en la red para que pueda soportar el aumento de tráfico en relación a la venta de planes. Para esto, es necesaria la estadística y que esta a su vez implique una política en la tasa de agregación, es decir, para una zona en particular con un comportamiento de tráfico específico y crecimiento estimado se debería generar una limitante a la tasa de agregación o, en palabras simples, a la cantidad de sobre-venta de un canal.

Banda Ancha: definición local para una red global

Uno de los encargos de la ley de velocidad mínima garantizada, era que la reglamentación describiera las características de lo que se ofrece como “banda ancha” por los ISP. La norma técnica fija una regla (art. 23) que es en parte flexible respecto de las velocidades de referencia, pero a la vez establece un parámetro de medición. Si bien es arbitrario el valor mínimo de la velocidad de bajada y la velocidad de subida para ser llamada “banda ancha”, lo importante es la relación entre ellos.

Se debe considerar como elemento técnico que las conexiones alámbricas e inalámbricas poseen un canal de comunicación cuya característica es que su ancho de banda es bidireccional o total. Es decir, un cable cuya velocidad de transferencia es de 100 Mbps puede transmitir 50 Mbps de subida y 50 de bajada o bien en relación 70/30, pero la suma de ambos tráficos no podrá superar la capacidad física del canal.

Al parecer, existe una definición comercial que diferencia a un usuario común de un usuario con requerimientos específicos, dado que las ofertas de varios ISPs corresponden a planes de internet asimétricos bajo demanda, con una relación 5:1 o 20:7 en relación entre las velocidades de bajada y subida, y planes de internet dedicados y simétricos cuya velocidad transferencia de subida y bajada son iguales. Los segundos son más costosos pues aseguran la velocidad de transferencia en cualquier momento, aunque cabe la posibilidad de tener un canal simétrico no dedicado. Esta diferenciación tiene sentido para la oferta de servicios a empresas, en contraste con la oferta para internet en hogares.

En el caso de las conexiones asimétricas (como ocurre con cada conexión casera o común) se podría considerar que la tasa de agregación podría estar limitada en su sobre-venta, de tal manera que permita una relación más baja. Por ejemplo, que el tráfico de subida en una conexión casera o móvil sea al menos la mitad (50%) del tráfico de bajada. Desde un punto de vista comercial, parece tener sentido que los hogares,ya sea con una conexión fija o a través de un dispositivo móvil, tengan una conexión asimétrica donde la red se usa mayormente para recibir contenidos.

Pero esta visión de las necesidades hogareñas es altamente problemática: representa una noción limitada de la utilidad que se le da a la conectividad, no solo para “consumir” contenidos, sino también para producirlo y para comunicarse con otras personas de manera cada vez más sofisticada. Y ese aprovechamiento de las posibilidades de la red solamente aumenta en pandemia. En épocas de una creciente tendencia al teletrabajo, a la educación a distancia, a la telemedicina y a una sociedad obligada a interactar a distancia, es necesario considerar la importancia de que las conexiones permitan un tráfico bidireccional que asegure poder interactuar en la red de forma más igualitaria, donde la velocidad del tráfico de subida resulta tan importante como la de bajada.

Las definiciones de velocidad también resultan problemáticas por lo que implican en relación con la conectividad a nivel global. Por definición, internet representa acceso a contenidos digitales en cualquier parte del mundo y, debido a ello, es que en la mayoría de los países no existe una diferenciación entre tráfico nacional e internacional para la medición. Es decir, la correcta aplicación del término “Banda Ancha” debería aplicarse directamente al tráfico internacional, sin desmedro de que pueda declararse la velocidad de tráfico en territorio nacional. Si bien existen limitaciones técnicas que impiden que pueda asegurarse igual velocidad respecto de conexiones con terminales de distintos lugares del mundo, es importante que existan suficientes condiciones de transparencia que permitan manejar las expectativas de las personas que se conectan a la red. Aun cuando la norma técnica identifica las diferencias entre tráfico nacional e internacional, la oferta comercial de “banda ancha” debe hacerse cargo transparentemente de esa diferencia.

Estas definiciones no son solamente una cuestión comercial o técnica, sino que inciden en la capacidad de crecimiento y de inversión en conectividad. A la vez, su mayor uso no es consecuencia solamente de un contexto global específico, sino que está en juego la forma en que se desarrolla la sociedad en torno a la conectividad digital. Es decir se trata de un servicio estratégico para el desarrollo tecnológico, laboral, económico, educativo y cultural.

La norma técnica en disputa política

La elaboración de la norma técnica por parte de la Subtel ha sido objeto de controversia por las exigencias de datos personales. En contra de la resolución, tanto la industria como la sociedad civil, la autoridad de acceso a información pública y hasta un senador de la República, han reaccionado en oposición a la que ya es una resolución vigente. La actual discusión de una nueva ley de datos personales podría razonablemente limitar riesgos de abuso y permitir la fiscalización del tratamiento no autorizado.

La expectativa desde el interés público es que esas condiciones cambien, pues como hemos dicho, la recolección intensiva de datos resulta desproporcionada frente al propósito de la ley que motiva estas reglas. Pero a la vez, la necesidad de corrección de esas condiciones plantea la oportunidad de mejorar la forma en que se define una internet de velocidad mínima de cara a una sociedad que requiere mejor conectividad.